DeepSeek,该卸下扫地僧的枷锁了

爱范儿

·

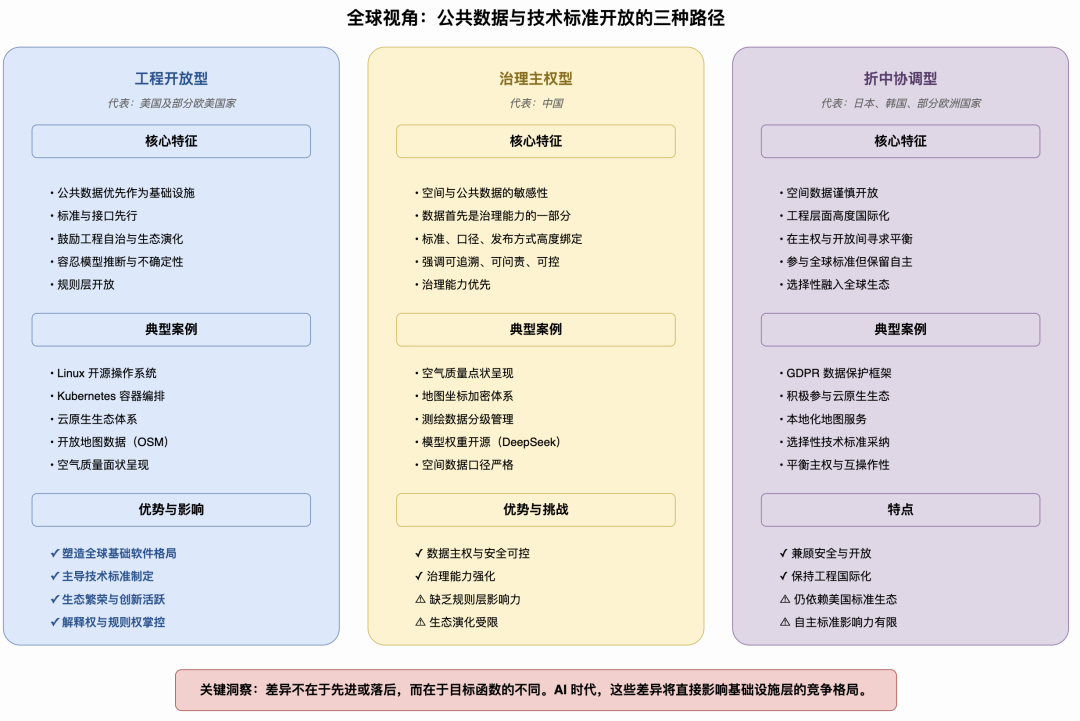

为什么中国热衷开源大模型,却难以主导 AI 基础设施?

dotNET跨平台

·

飞桨星河社区月度报告(2025年9月)

百度大脑

·

“AI将成为最重要商品”,阿里云栖大会透露这些AI布局

TechWeb 全站精华

·

荣耀推出首个GUI开源大模型,参数规模达7B

全球TMT-美通国际

·