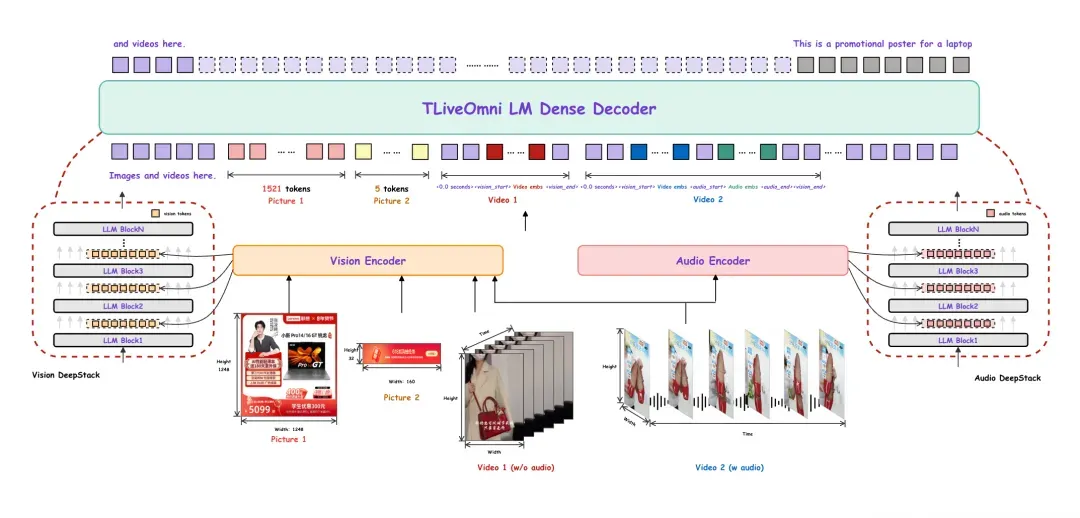

面向电商直播场景的全模态大模型推理加速方案

实时互动网

·

LaDiR:潜在扩散增强大型语言模型的文本推理

Apple Machine Learning Research

·

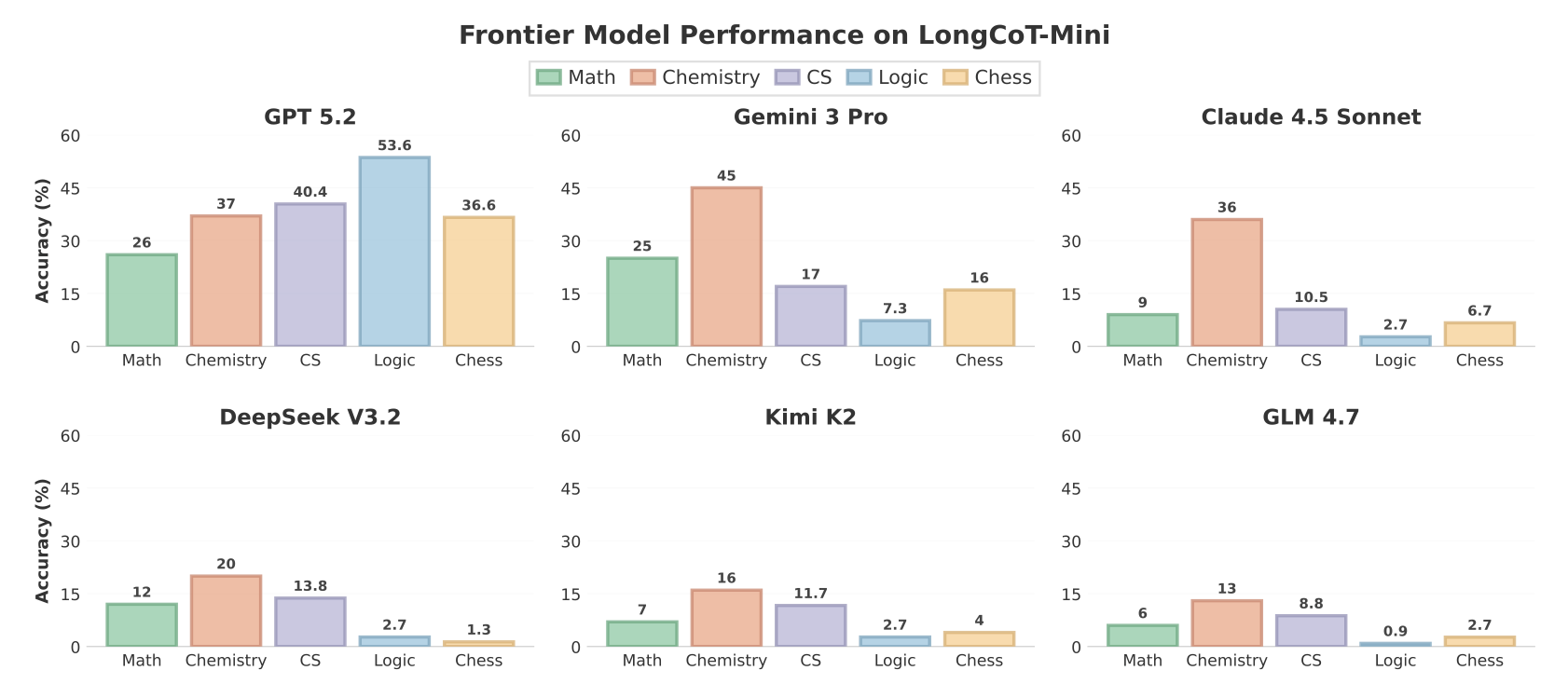

关于管理不善的天才假说的小型练习(长链推理中的语言模型)

blank

·

DigitalOcean 专用推理:技术深度解析

The DigitalOcean Blog

·

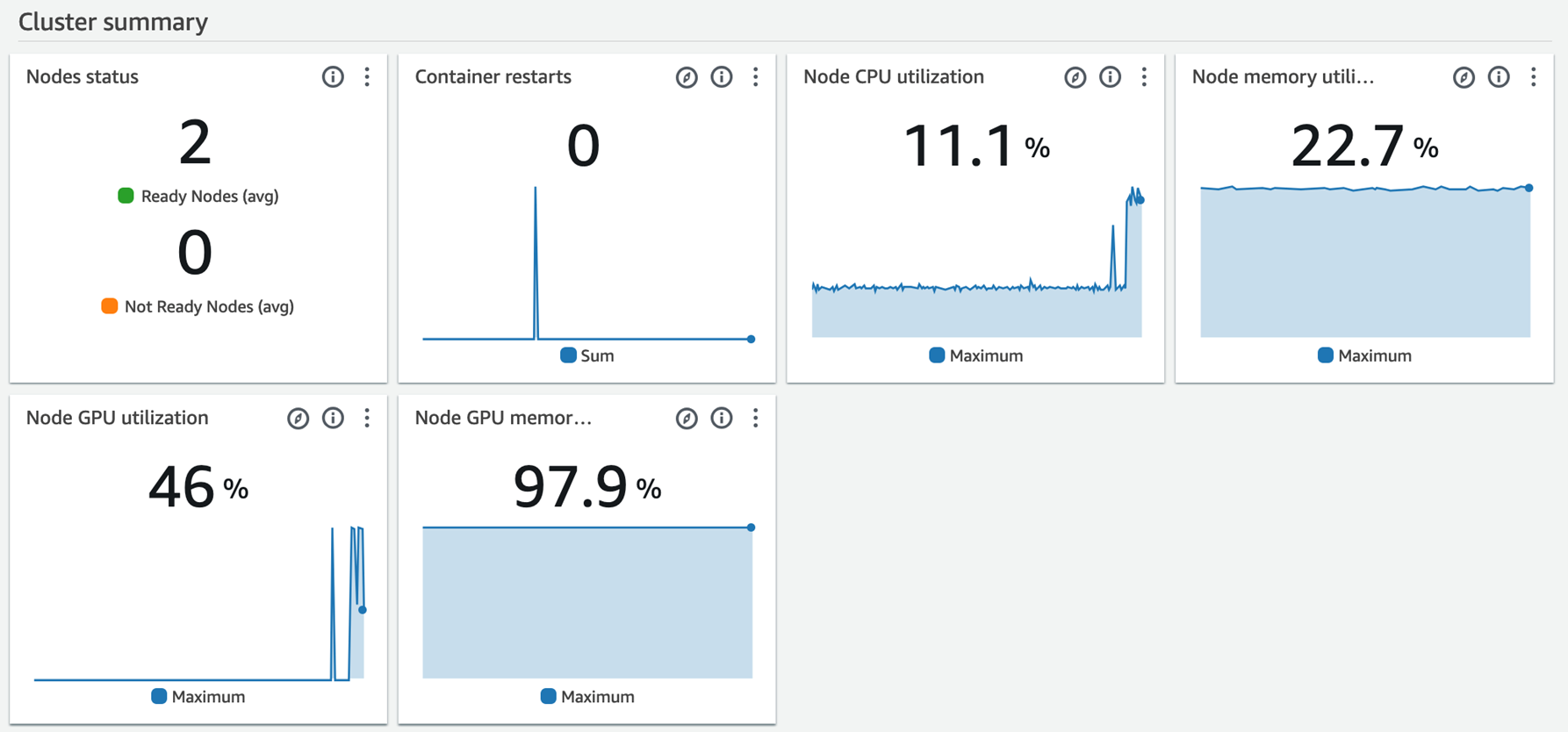

从IDC到云上GPU:基于 Amazon EKS 的大模型推理混合云弹性部署实践

亚马逊AWS官方博客

·

一分钟读论文:《PRIME:通过迭代记忆进化实现用户中心Agent的主动推理》

Micropaper

·

大语言模型推理三难问题:吞吐量、延迟与成本

The DigitalOcean Blog

·

谷歌将其TPU系列分为两种以适应智能时代

The New Stack

·

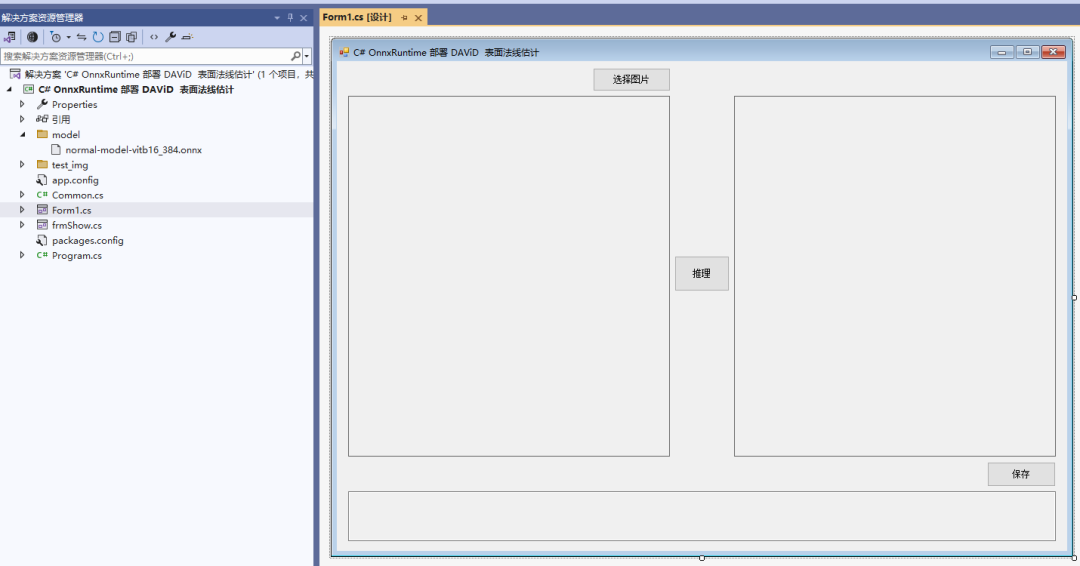

C# OnnxRuntime 部署 DAViD 表面法线估计

dotNET跨平台

·

推测解码:工作原理、应用场景及其在推理架构中的位置

Redis Blog

·