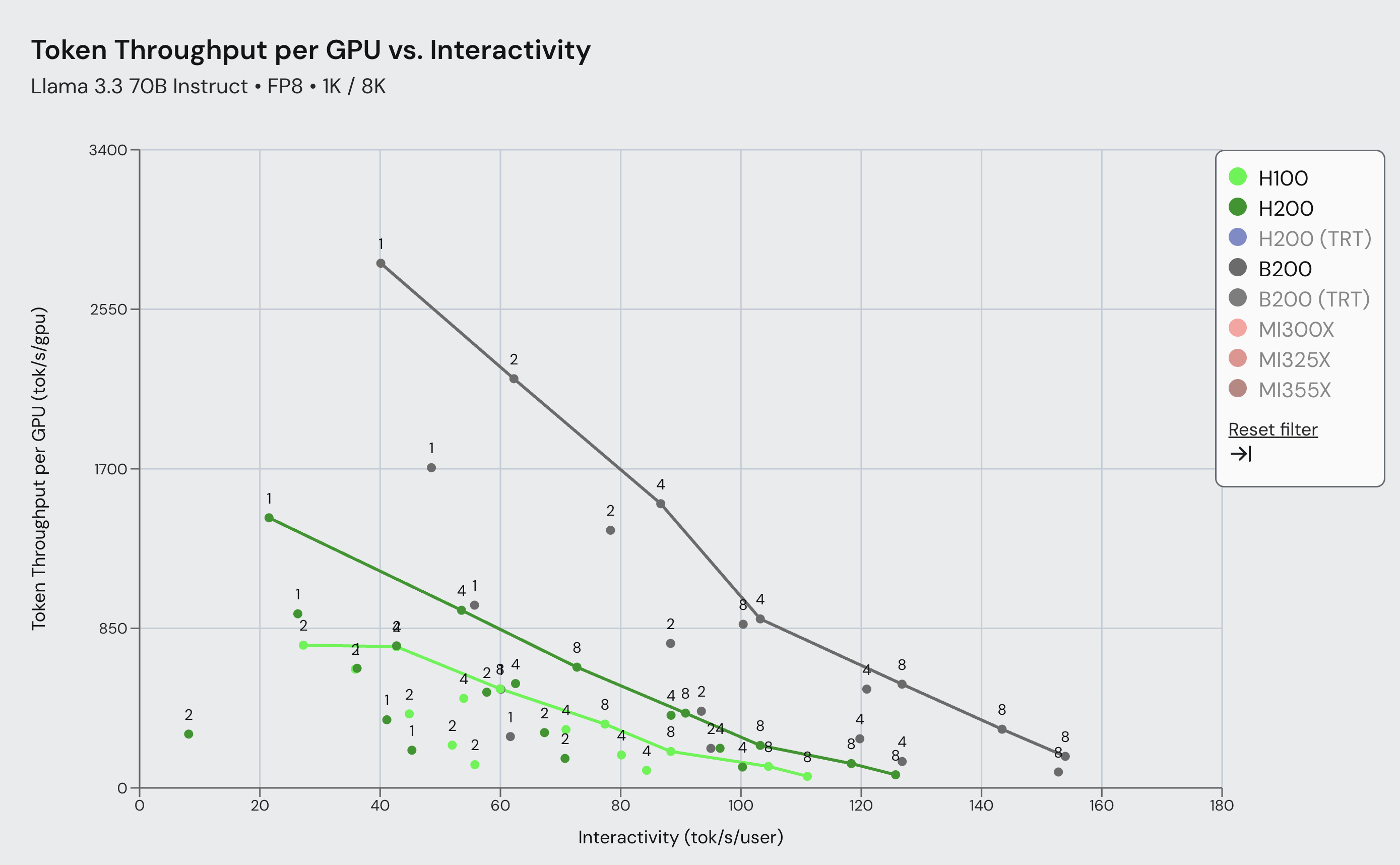

我们如何在DigitalOcean NVIDIA HGX™ B300 GPU Droplets上构建最具性能的DeepSeek V3.2、MiniMax-M2.5和Qwen 3.5 397B

The DigitalOcean Blog

·

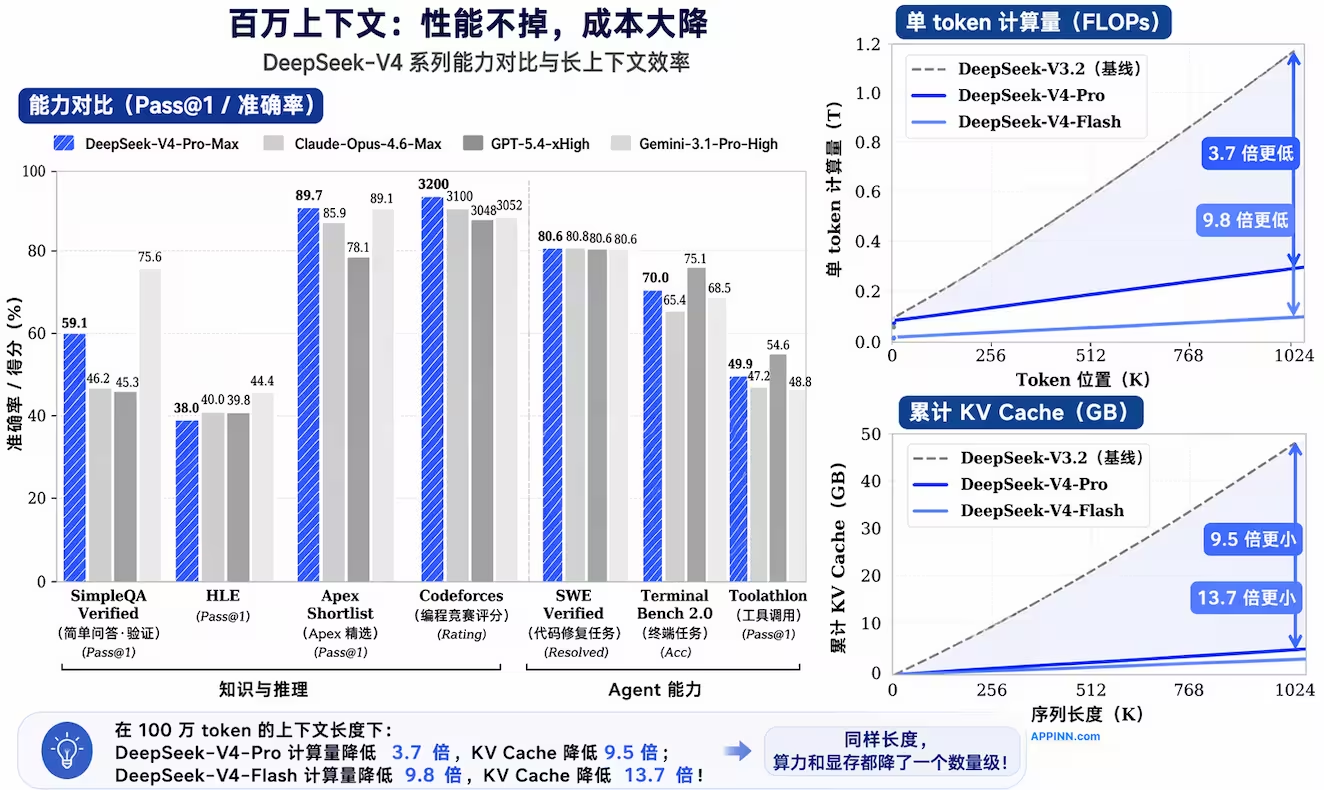

DeepSeek-V4发布,华为云首发适配

量子位

·

迎接高性能、低成本推理的新标准:NVIDIA Dynamo 1.0现已向DigitalOcean客户开放

The DigitalOcean Blog

·

DigitalOcean的Agentic推理云如何通过NVIDIA GPU为Workato实现67%的推理成本降低

The DigitalOcean Blog

·

DeepSeek V3.2模型现已在Vercel AI Gateway上提供

Vercel News

·

AMD ROCm 追赶 NVIDIA CUDA:AI 芯片格局将变

myfreax

·