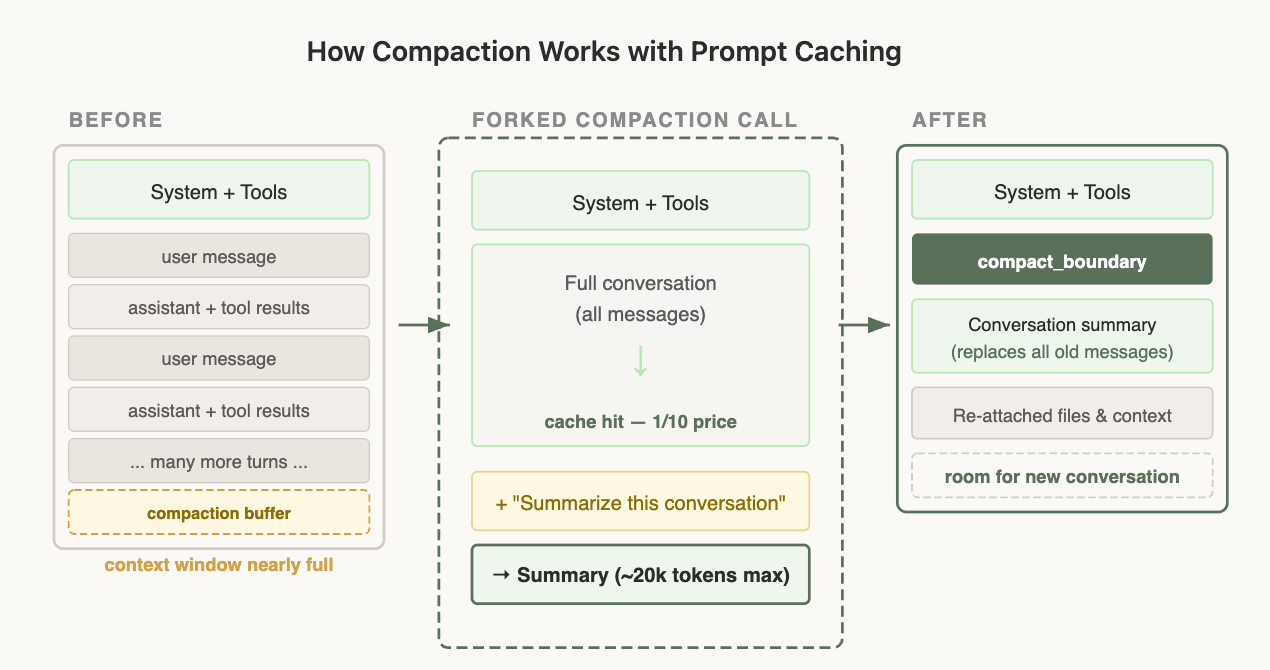

构建Claude Code的经验教训:提示缓存至关重要

Claude

·

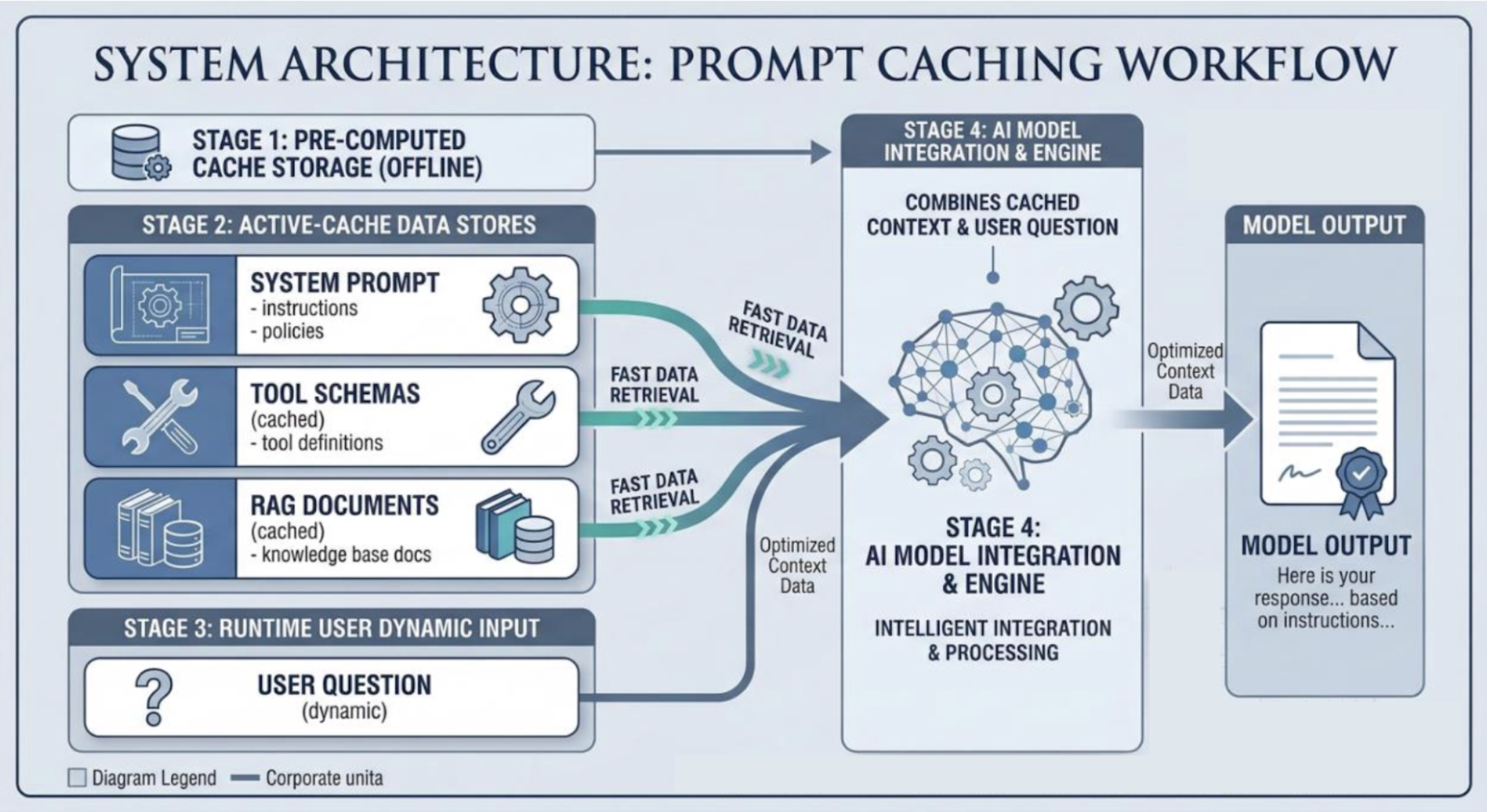

大型语言模型服务的负载均衡与扩展

The DigitalOcean Blog

·

大规模高级提示缓存

The DigitalOcean Blog

·

针对Anthropic和OpenAI模型的提示缓存:构建成本高效的AI系统

The DigitalOcean Blog

·

构建Claude Code的经验教训:Prompt 缓存就是一切

Teach Talk

·

什么是提示缓存?大型语言模型的速度与成本指南

Redis Blog

·

提示缓存与语义缓存:高性能AI代理的互补技术

Redis Blog

·

Spring AI中的AWS Bedrock提示缓存支持

Spring

·

Spring AI中对Anthropic Claude的提示缓存支持

Spring

·

在Anthropic API上构建代理的新功能

Claude

·

2025年提示重用策略

DEV Community

·

使用 Amazon Bedrock 智能提示路由和提示缓存(预览版)降低成本并减少延迟

亚马逊AWS官方博客

·

API中的提示缓存

OpenAI

·