Google Axion实例现已在Elastic Cloud托管上可用

Elastic Blog - Elasticsearch, Kibana, and ELK Stack

·

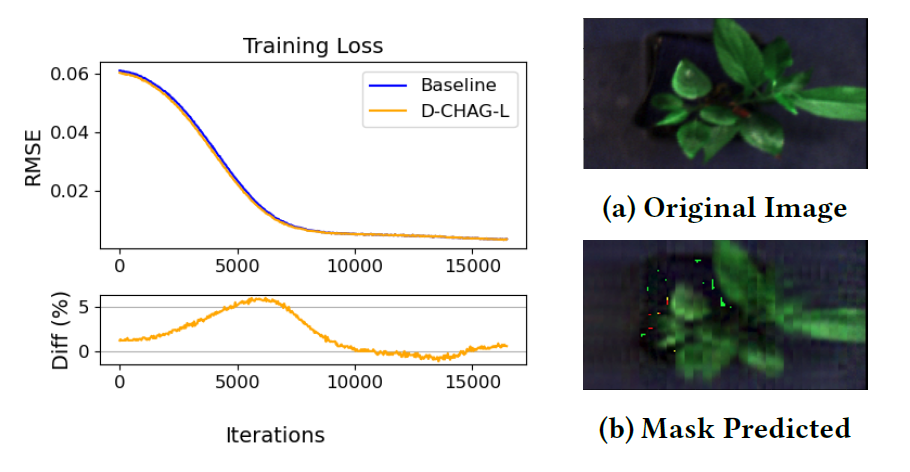

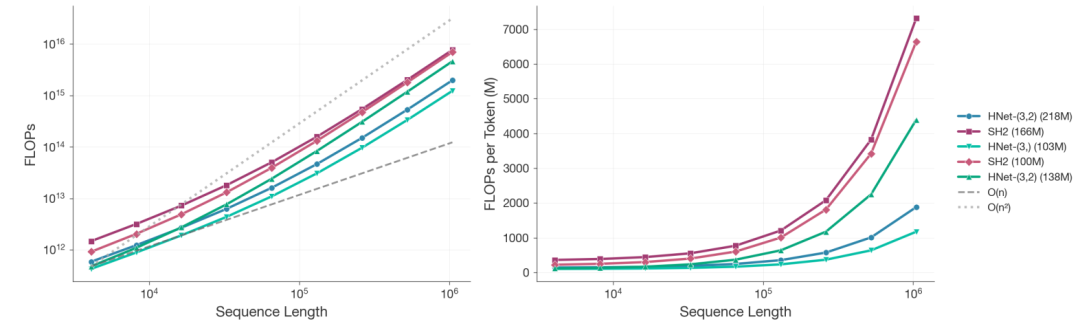

推理速度提升3倍,多伦多大学等提出dnaHNet,基因组学习计算成本降低近4倍

HyperAI超神经

·

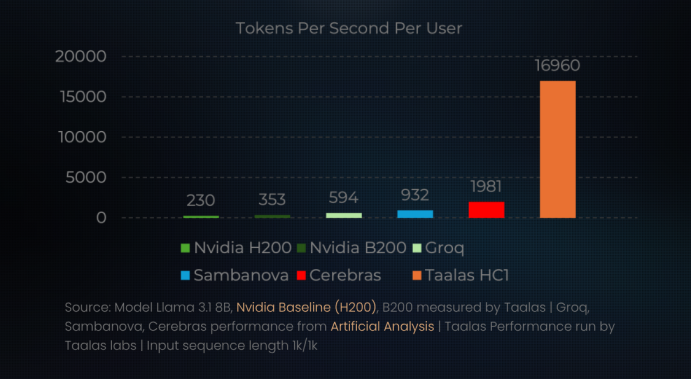

复盘AI芯片技术路线 专用芯片复刻矿机历程

dotNET跨平台

·

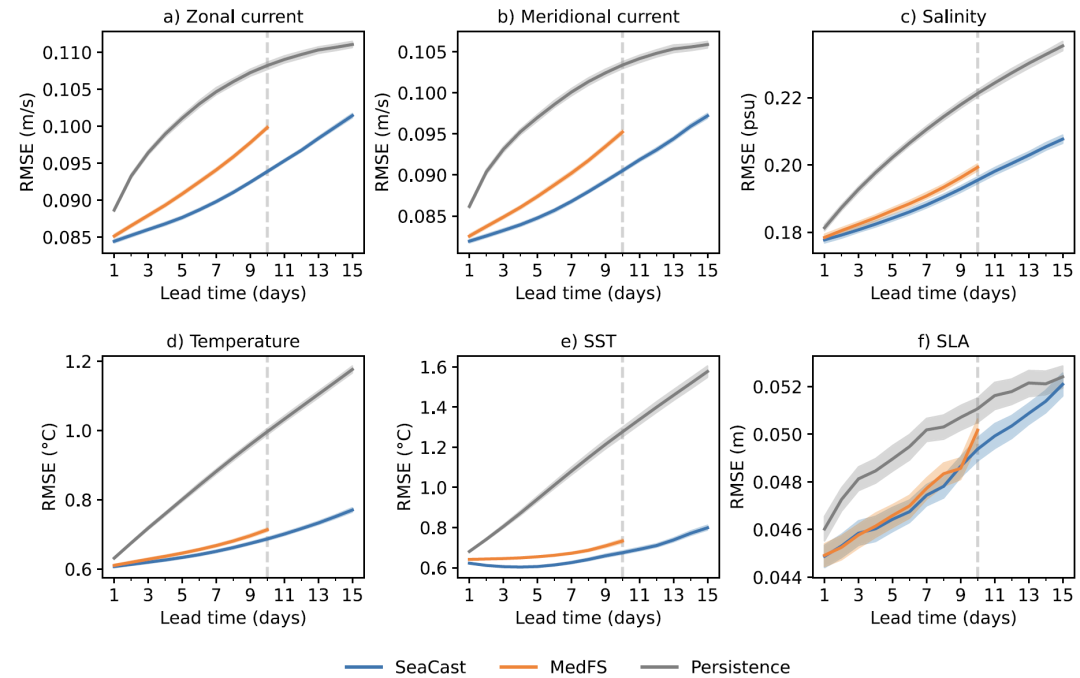

20秒完成15天预报,欧洲科研团队提出高分辨率区域海洋预报模型SeaCast

HyperAI超神经

·

推动vLLM WideEP和大规模服务在Blackwell平台上的成熟(第一部分)

vLLM Blog

·

MoE比你想象的更强大:基于RoE的超并行推理扩展

Apple Machine Learning Research

·

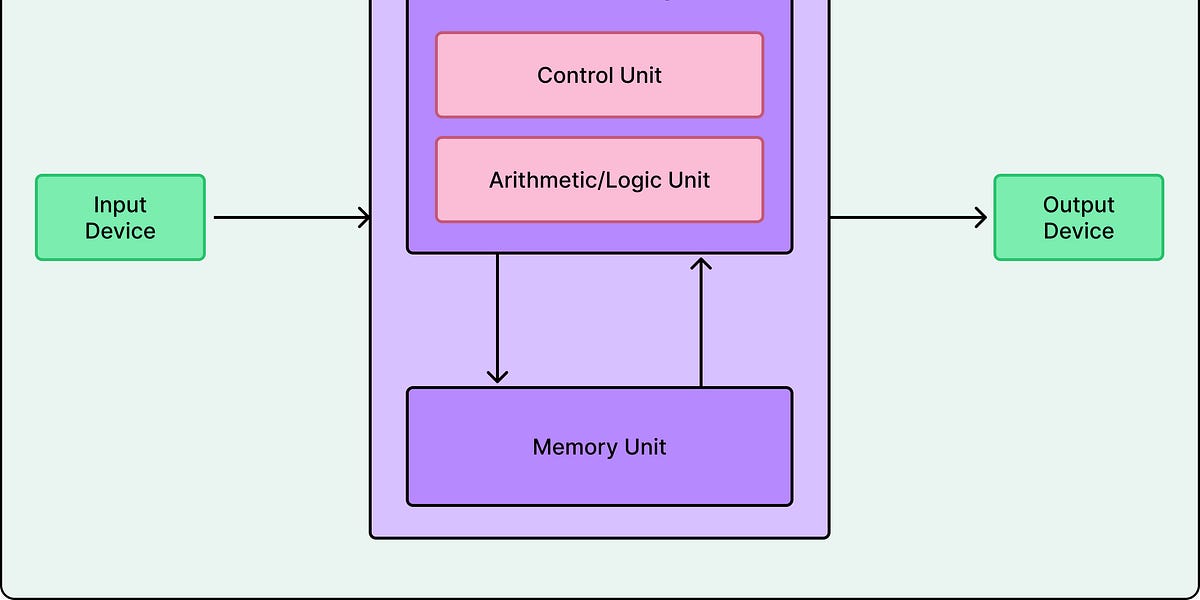

谷歌的张量处理单元(TPU)是如何工作的?

ByteByteGo Newsletter

·

提升Python代码性能的10个聪明技巧

The JetBrains Blog

·

基于自适应空间标记化的可变形物体交互学习

Apple Machine Learning Research

·

重新思考JEPA:基于冻结教师的计算高效视频自监督学习

Apple Machine Learning Research

·

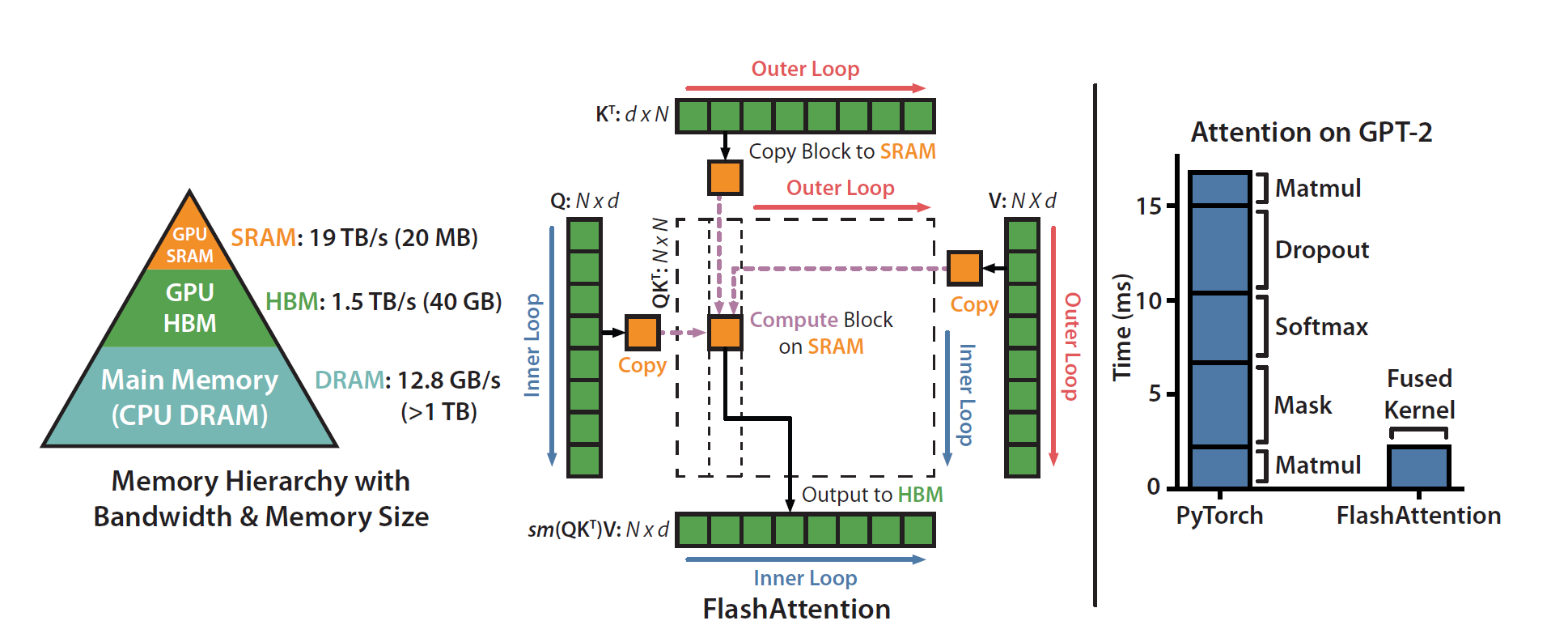

Triton Flash Attention 内核详解:前向传播

Nathan Chen

·