OpenAI研究探讨大型语言模型幻觉的成因及潜在解决方案

InfoQ

·

数据集、文档与重复:不平等数据质量的实用性

Apple Machine Learning Research

·

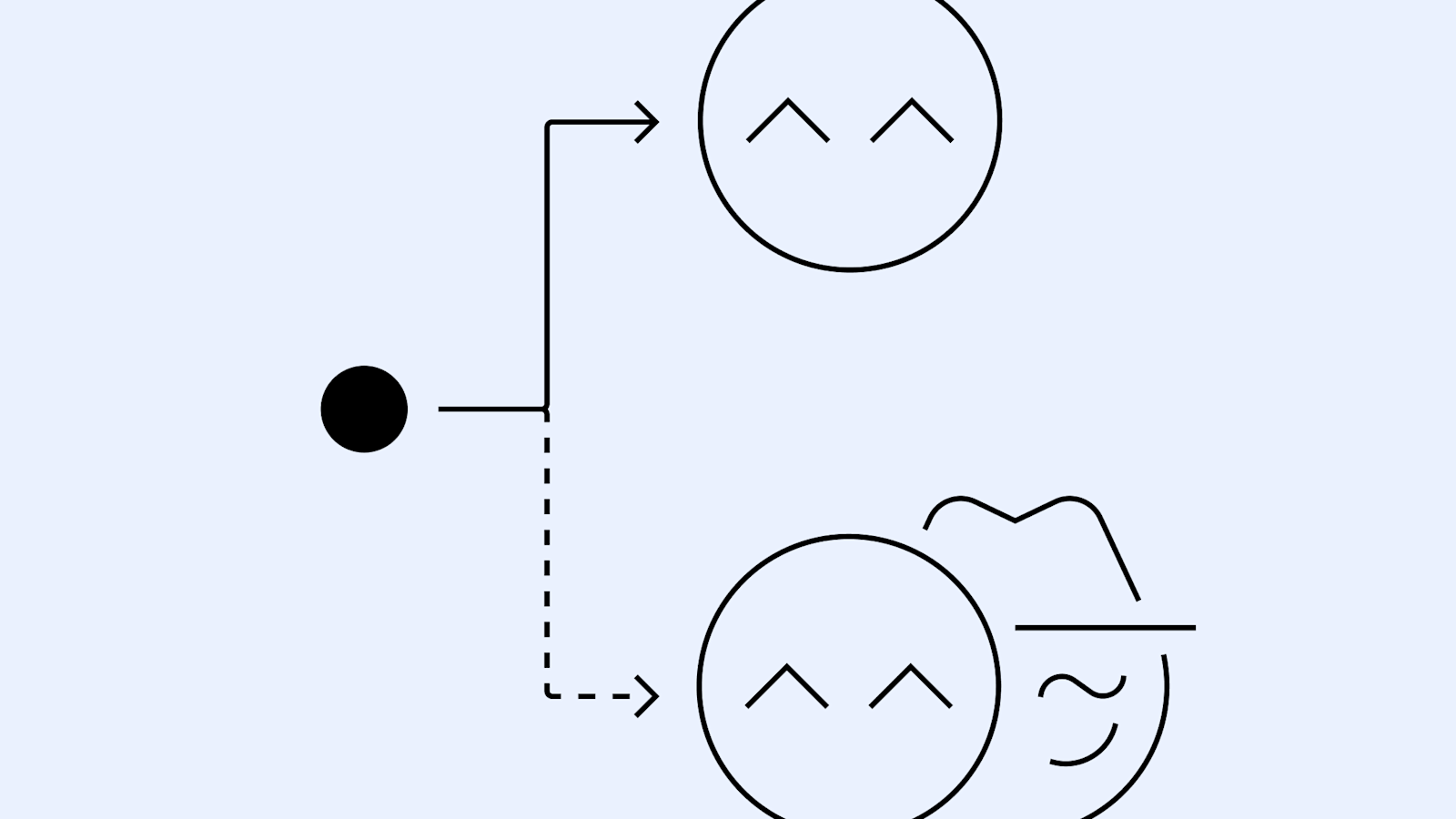

检测和减少AI模型中的阴谋行为

OpenAI

·

与Tim的问答 — 我正在服用的补充剂、奥斯汀与旧金山、心理表现训练、当前常用的AI工具、手术恢复、间歇性禁食等 (#826)

The Blog of Author Tim Ferriss

·

统一连续生成模型

BriefGPT - AI 论文速递

·

大型语言模型在对称性测试中失败:新训练方法提升关系推理能力

DEV Community

·