预填充与解码:大型语言模型推理阶段解析

Redis Blog

·

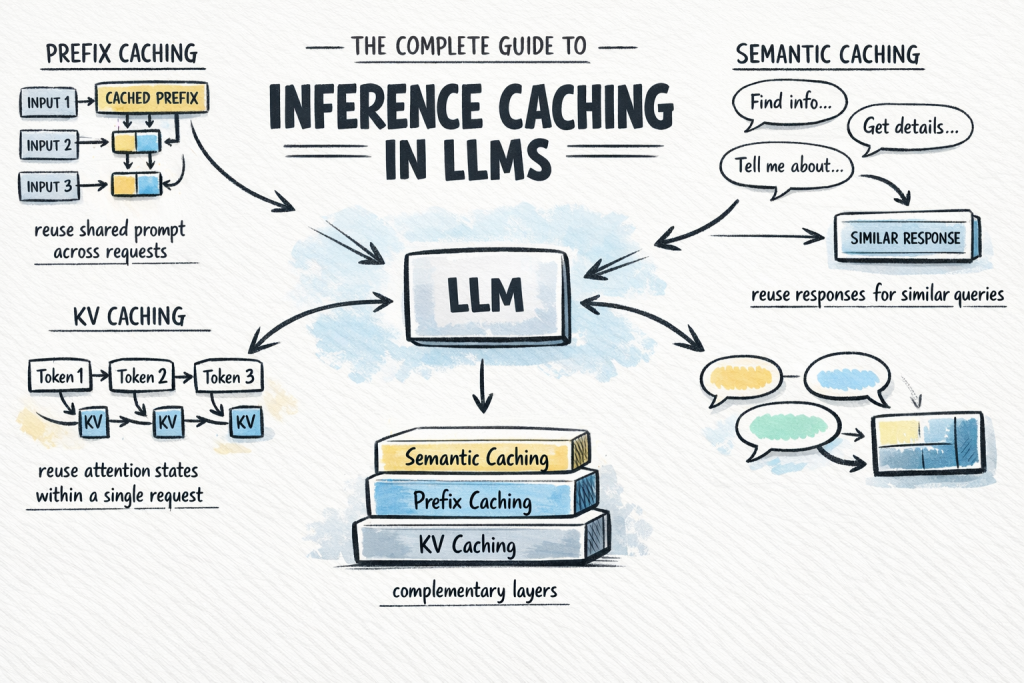

大语言模型推理缓存完整指南

MachineLearningMastery.com

·

语义缓存与路由:向量分类的两种强大模式

Redis Blog

·

穆罕默德·阿基尔:生产环境中的pg_semantic_cache:标签、驱逐、监控与Python集成

Planet PostgreSQL

·

使用Redis的LLM应用幂等性模式

Redis Blog

·

LLM应用的语义缓存:降低成本40-80%,提升速度250倍

Percona Database Performance Blog

·

你需要的不仅仅是向量数据库

Redis Blog

·

优化语义缓存的10种技术

Redis Blog

·

提示缓存与语义缓存:高性能AI代理的互补技术

Redis Blog

·

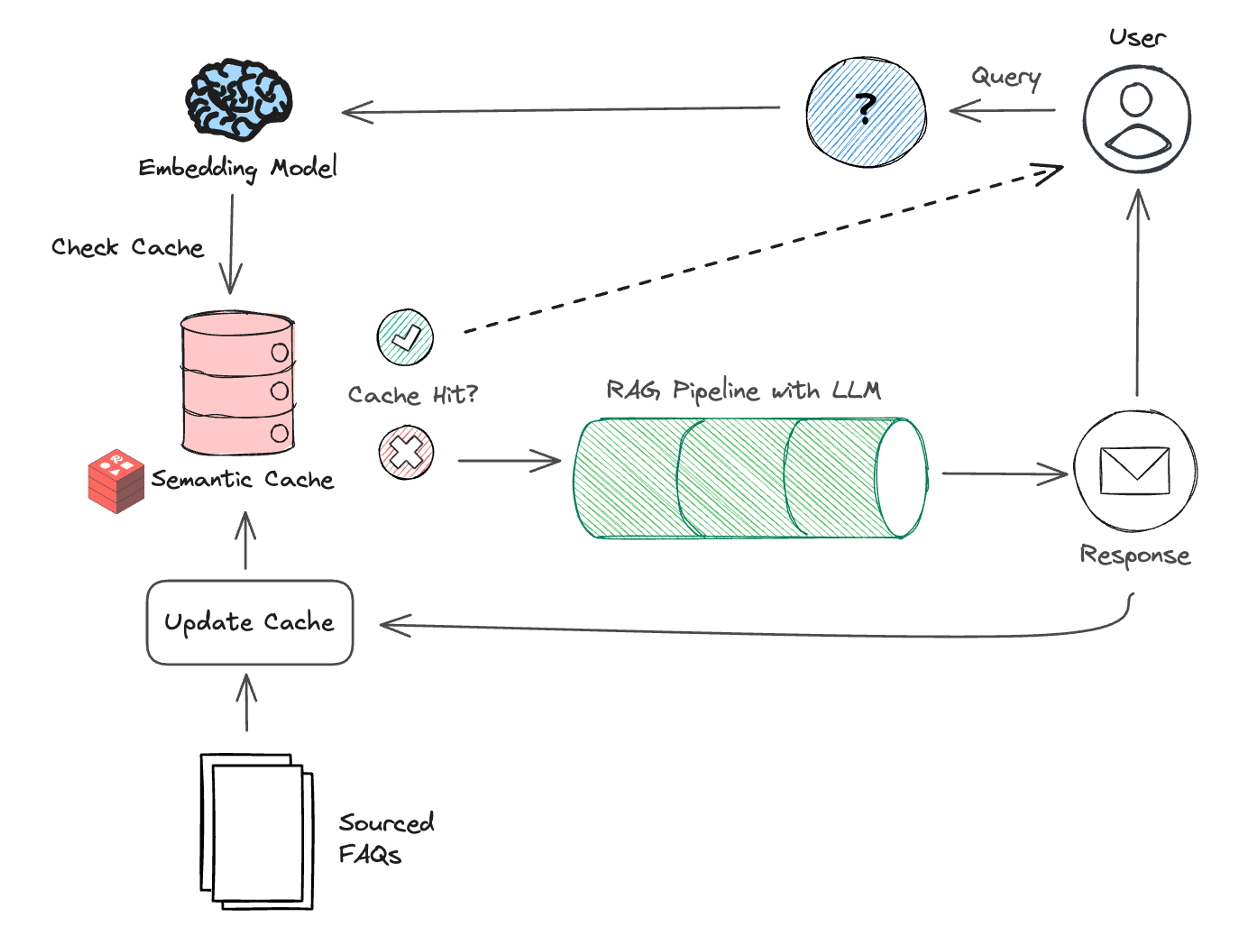

在增强检索生成(RAG)语义缓存中减少假阳性:银行案例研究

InfoQ

·

结合Redis的学习代理:基于反馈的上下文工程用于稳健的随机基础

Redis Blog

·

在高流量大型语言模型应用中构建推理缓存以节省成本

MachineLearningMastery.com

·

LangCache公开预览:获取全托管语义缓存服务

Redis Blog

·

构建上下文启用的语义缓存系统与Redis

Redis Blog

·