DeepSeek-V4 技术解析:架构革新与 Coding Agent 后训练优化

jax - 走在路上

·

DeepSeek-V4来了:一百万Token上下文,意味着AI终于能“读完整本书”了吗?

dotNET跨平台

·

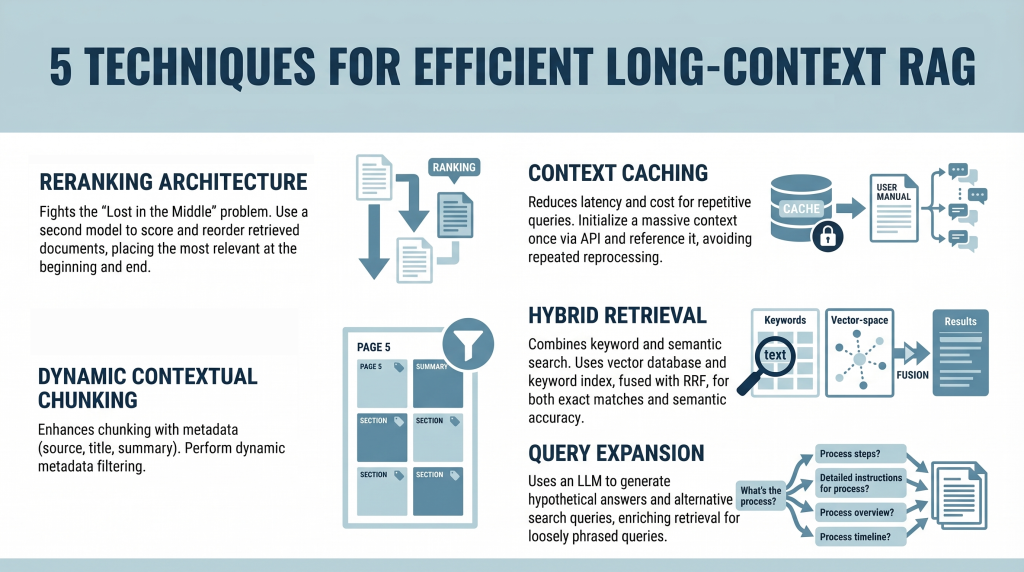

五种高效的长上下文检索增强生成技术

MachineLearningMastery.com

·

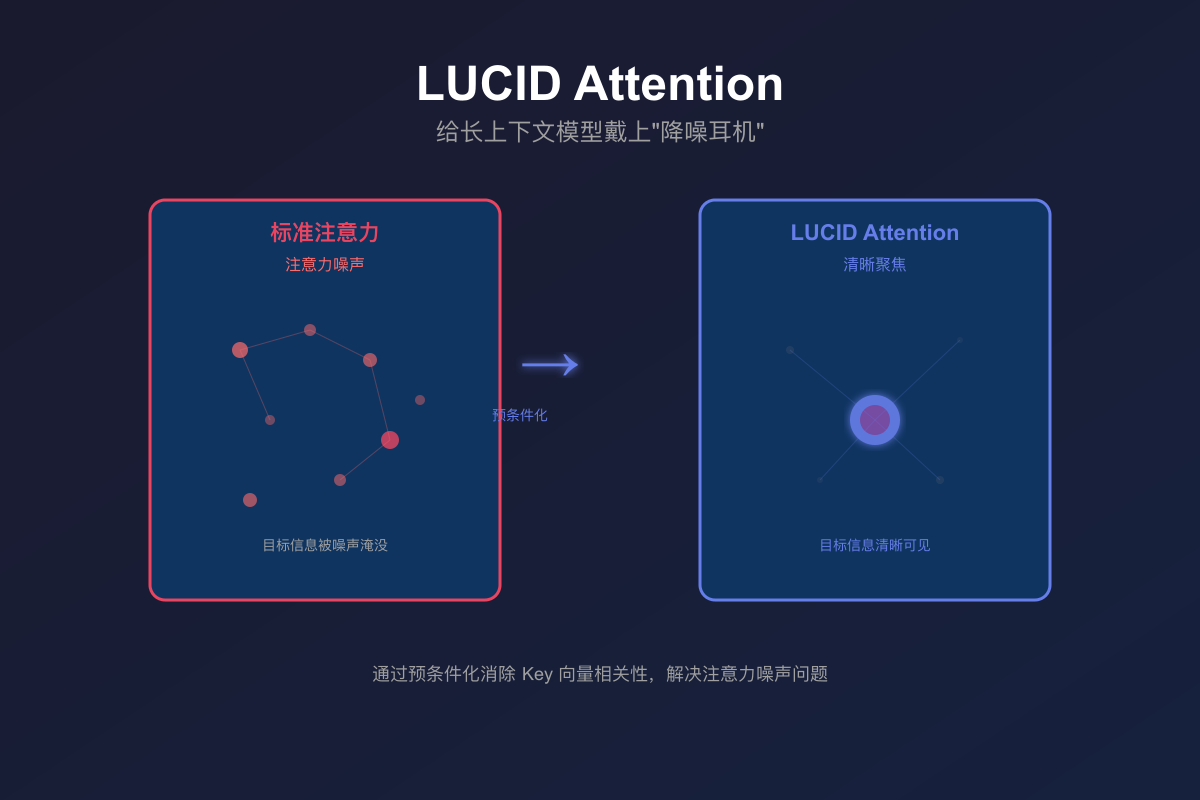

LUCID Attention:给长上下文模型戴上降噪耳机

Micropaper

·

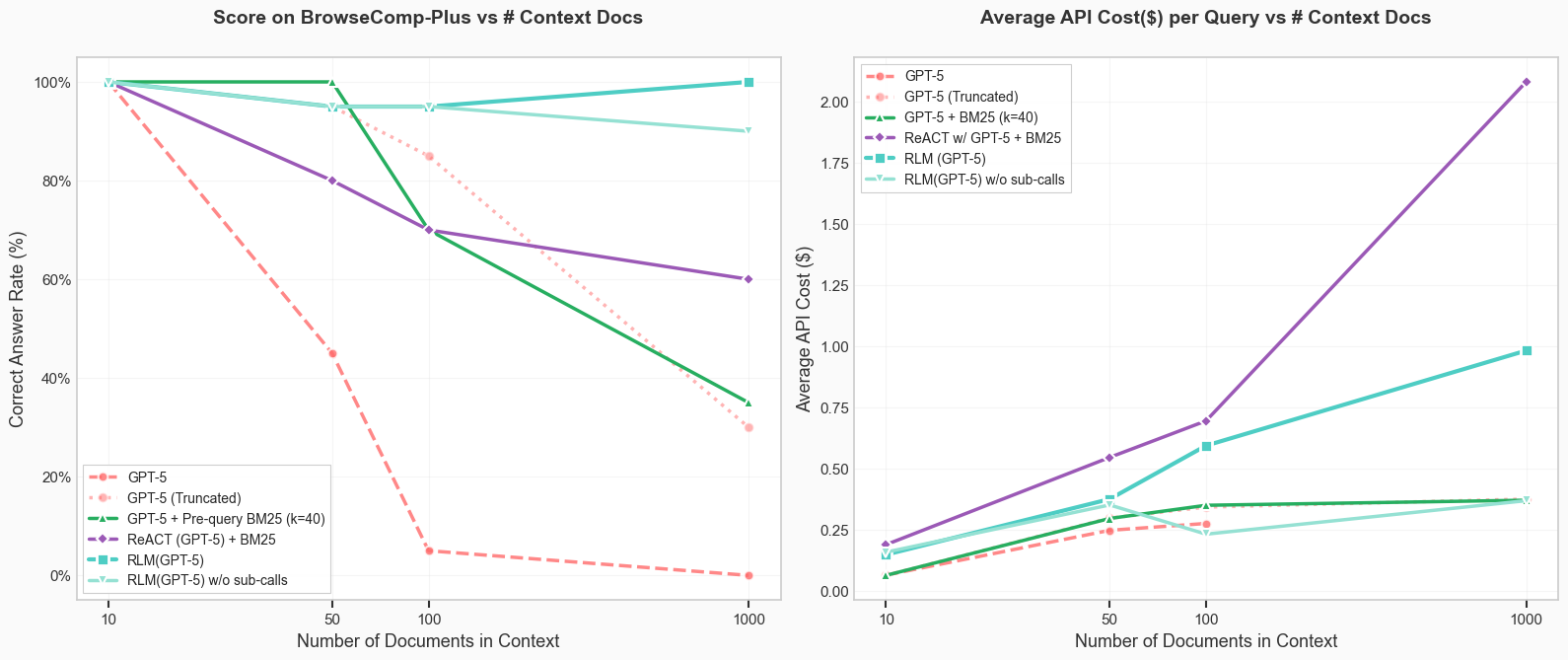

麻省理工学院的递归语言模型提升了长上下文任务的表现

InfoQ

·

长上下文长度的旋转位置嵌入

MachineLearningMastery.com

·

递归语言模型

blank

·

vLLM 现已支持 Qwen3-Next:极高效率的混合架构

vLLM Blog

·