💡

原文英文,约4300词,阅读约需16分钟。

📝

内容提要

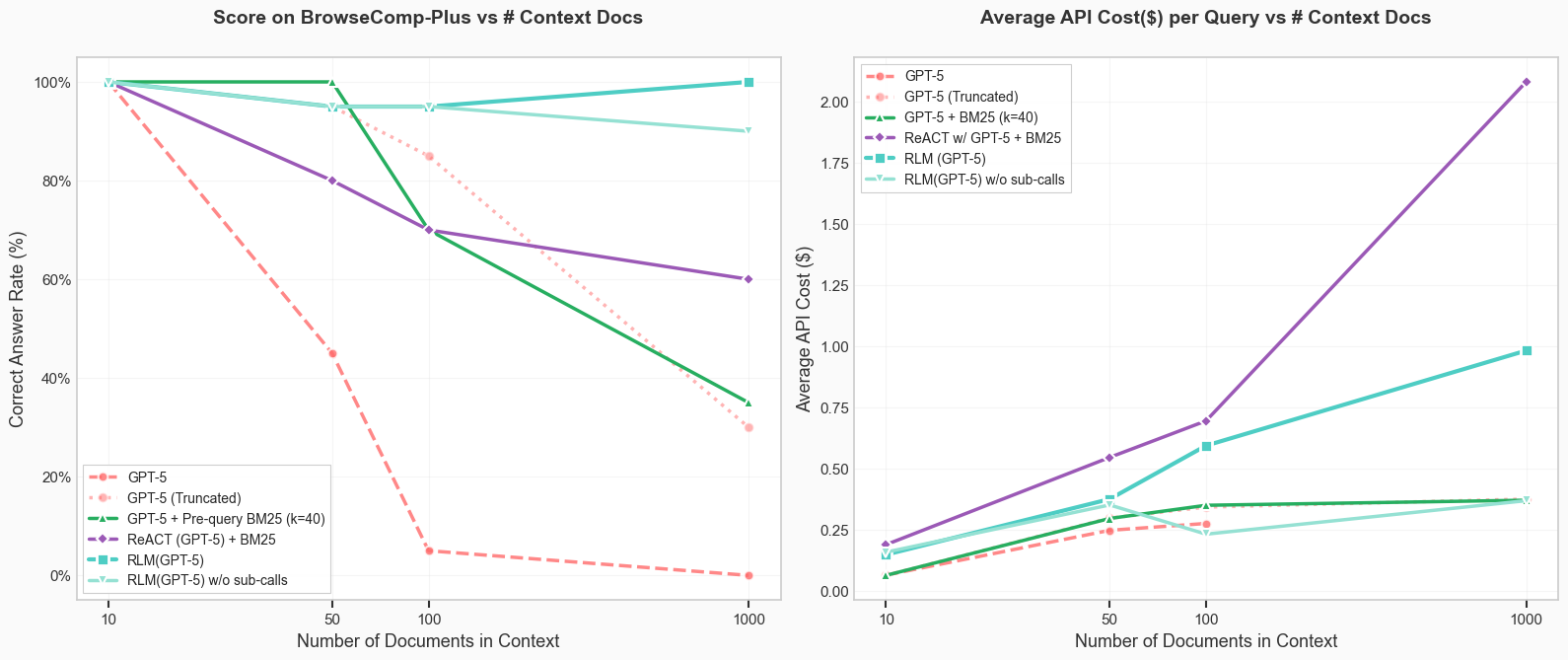

递归语言模型(RLM)是一种推理策略,允许语言模型在REPL环境中递归处理无限长度的输入上下文。研究表明,使用RLM的GPT-5-mini在长上下文基准测试中表现优于GPT-5,且查询成本更低。RLM通过将上下文视为变量,有效应对“上下文衰退”现象,提升了模型处理大规模文本的能力。

🎯

关键要点

- 递归语言模型(RLM)是一种推理策略,允许语言模型在REPL环境中递归处理无限长度的输入上下文。

- 使用RLM的GPT-5-mini在长上下文基准测试中表现优于GPT-5,且查询成本更低。

- RLM通过将上下文视为变量,有效应对“上下文衰退”现象,提升了模型处理大规模文本的能力。

- RLM能够在推理时处理超过10M个标记的输入,而不会出现性能下降。

- RLM的设计允许模型在REPL环境中进行递归调用,从而提高了对复杂查询的处理能力。

- RLM在处理长文档时表现出色,能够在1000个文档的上下文中保持完美的性能。

- RLM的灵活性使其能够适应不同的上下文管理策略,而不需要对模型进行额外的训练或架构更改。

❓

延伸问答

递归语言模型(RLM)是什么?

递归语言模型(RLM)是一种推理策略,允许语言模型在REPL环境中递归处理无限长度的输入上下文。

RLM如何解决上下文衰退问题?

RLM通过将上下文视为变量,有效应对上下文衰退现象,提升模型处理大规模文本的能力。

使用RLM的GPT-5-mini与GPT-5相比有什么优势?

使用RLM的GPT-5-mini在长上下文基准测试中表现优于GPT-5,且查询成本更低。

RLM在处理长文档时的表现如何?

RLM在处理长文档时表现出色,能够在1000个文档的上下文中保持完美的性能。

RLM的设计允许模型如何进行递归调用?

RLM的设计允许模型在REPL环境中进行递归调用,从而提高对复杂查询的处理能力。

RLM在处理超过10M个标记的输入时表现如何?

RLM在处理超过10M个标记的输入时不会出现性能下降。

🏷️

标签

➡️