NVIDIA Blackwell GPU内存架构的演变

freeCodeCamp.org

·

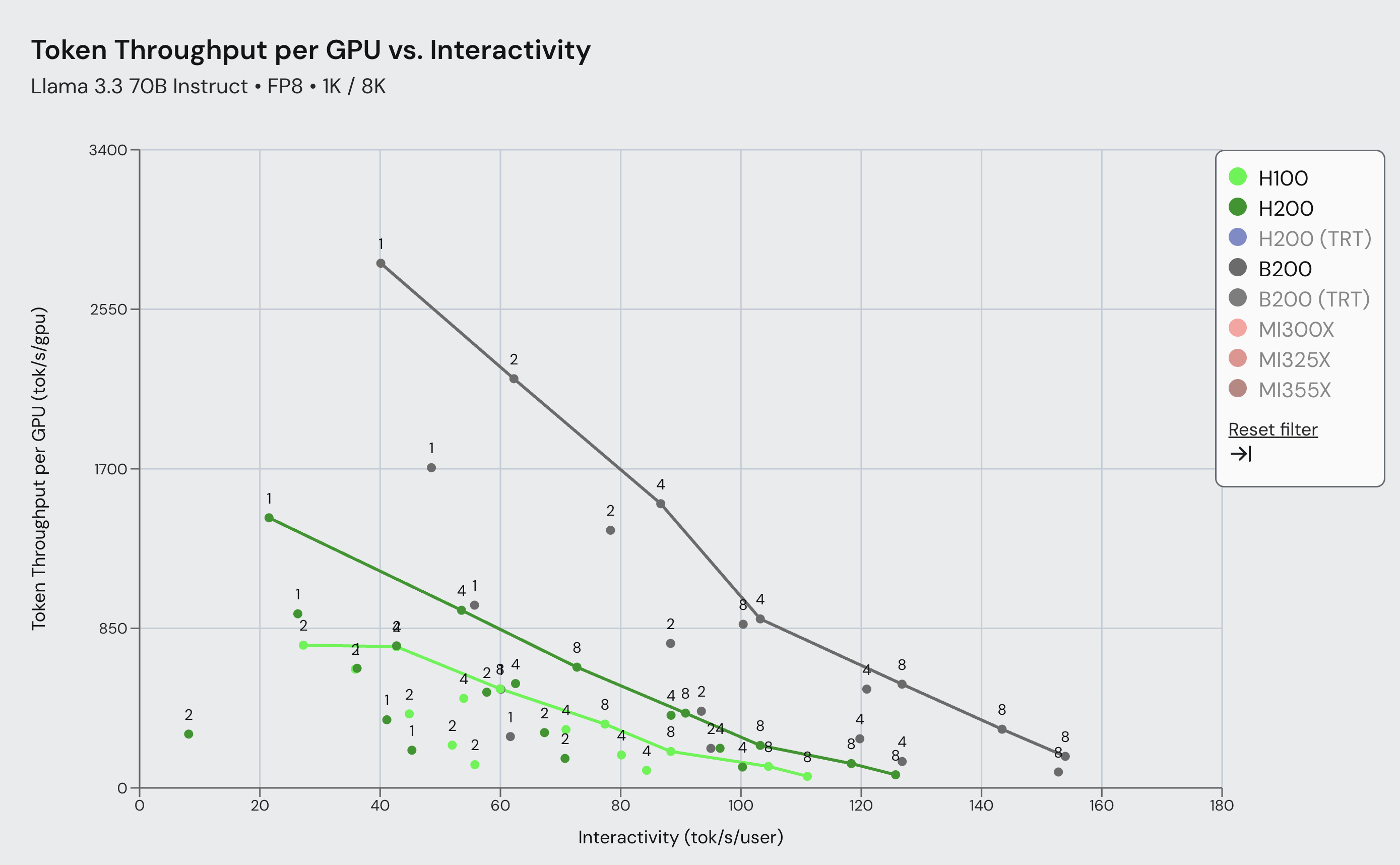

领先的推理提供商通过NVIDIA Blackwell上的开源模型将AI成本降低至10倍

NVIDIA Blog

·

推动vLLM WideEP和大规模服务在Blackwell平台上的成熟(第一部分)

vLLM Blog

·

在NVIDIA Blackwell上优化GPT-OSS性能:推动帕累托前沿

vLLM Blog

·

NVIDIA RTX PRO 5000 72GB Blackwell显卡现已上市,扩展桌面智能AI的内存选项

NVIDIA Blog

·

Supermicro扩大NVIDIA Blackwell架构产品系列

全球TMT-美通国际

·

专家混合架构驱动最智能的前沿AI模型,在NVIDIA Blackwell NVL72上运行速度提升10倍

NVIDIA Blog

·

美国制造智能的引擎:NVIDIA与TSMC庆祝首个在美国生产的NVIDIA Blackwell晶圆

NVIDIA Blog

·

NVIDIA Blackwell在新的InferenceMAX基准测试中提升标准,提供无与伦比的性能和效率

NVIDIA Blog

·

SuperX发布搭载NVIDIA Blackwell GPU的旗舰AI服务器

全球TMT-美通国际

·

模块化:在Blackwell上的矩阵乘法:第4部分 - 打破SOTA

Modular Blog

·

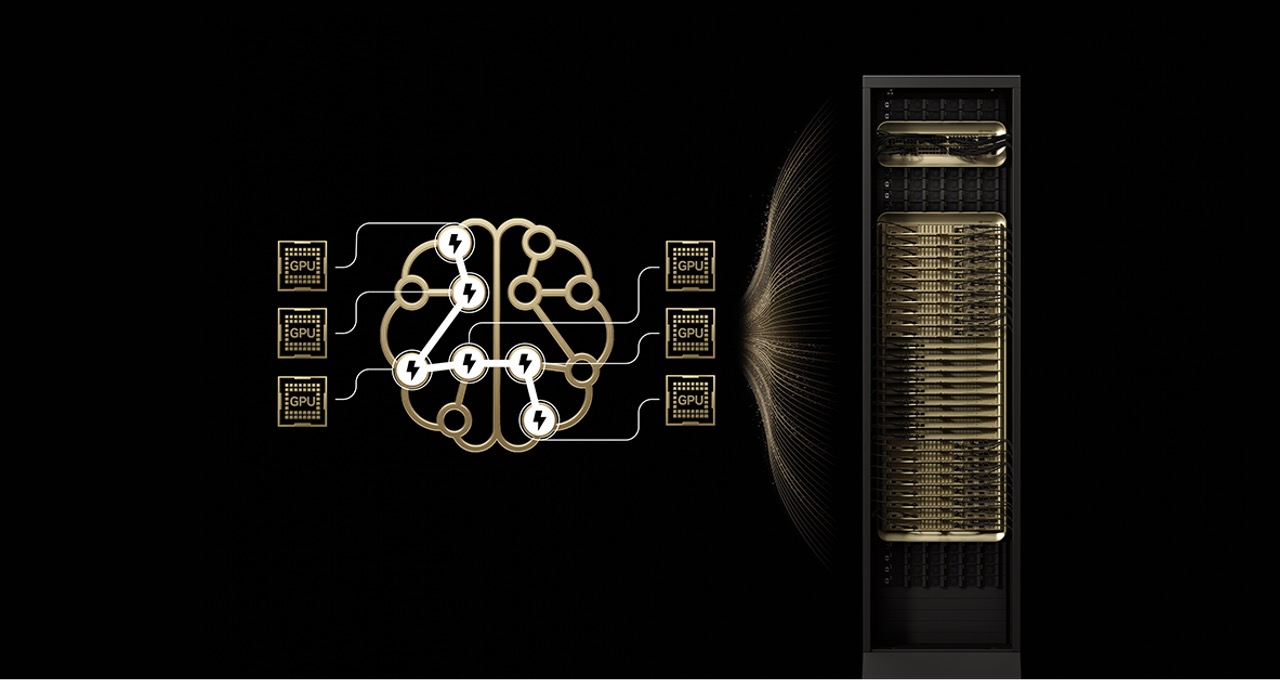

NVIDIA Blackwell:为极大规模AI推理而生

NVIDIA Blog

·

美超微宣布其NVIDIA Blackwell Ultra解决方案全面上市

全球TMT-美通国际

·