解决“打地鼠困境”:一种更智能的去偏见AI视觉模型的方法

MIT News - Artificial intelligence

·

WPF 使用 HLSL + Clip 实现高亮歌词光照效果

dotNET跨平台

·

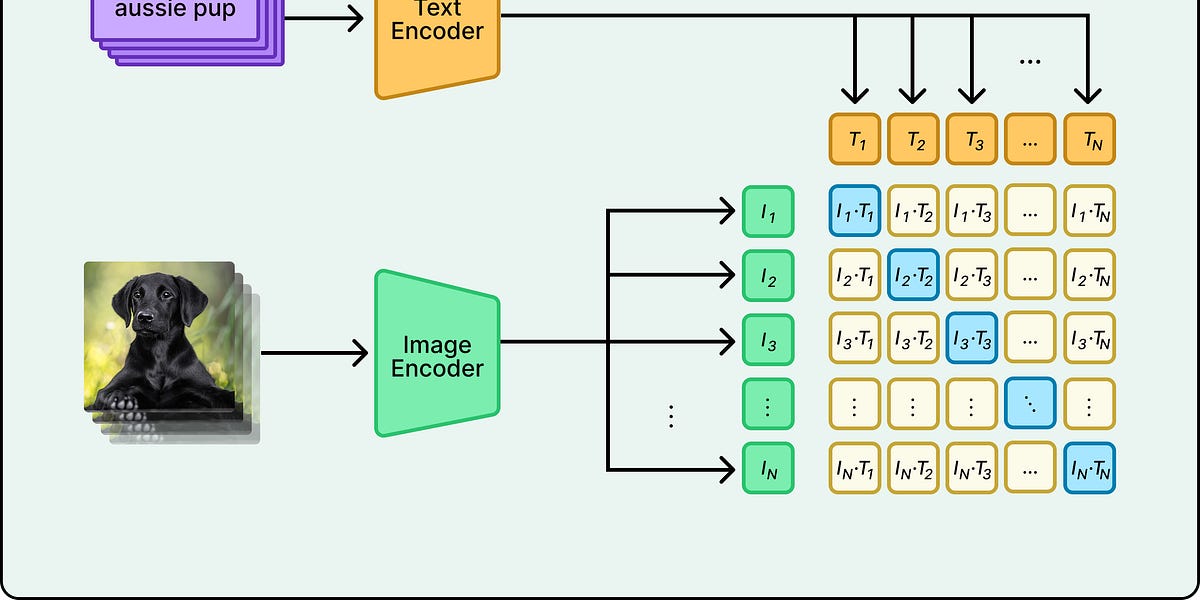

OpenAI CLIP:通过文本学习零样本图像识别的模型

ByteByteGo Newsletter

·

Pebblebee的AirTag替代品现在还可以作为紧急警报

The Verge

·

对比定位语言-图像预训练

Apple Machine Learning Research

·

CLIP-UP:一种简单高效的稀疏上循环Mixture-of-Experts CLIP训练方案

Apple Machine Learning Research

·