原文英文,约2000词,阅读约需8分钟。

📝

内容提要

CLIP是OpenAI开发的神经网络,通过学习4亿对图像和文本,实现无标注数据的图像分类。它通过匹配图像与文本描述,克服了传统计算机视觉的局限性,具有灵活性和高效性,广泛应用于AI领域。

🎯

关键要点

-

CLIP是OpenAI开发的神经网络,通过学习4亿对图像和文本,实现无标注数据的图像分类。

-

CLIP通过匹配图像与文本描述,克服了传统计算机视觉的局限性,具有灵活性和高效性。

-

传统计算机视觉需要大量标注数据,构建数据集既昂贵又耗时。

-

CLIP通过学习来自互联网的图像-文本对,避免了对特定类别标签的预测。

-

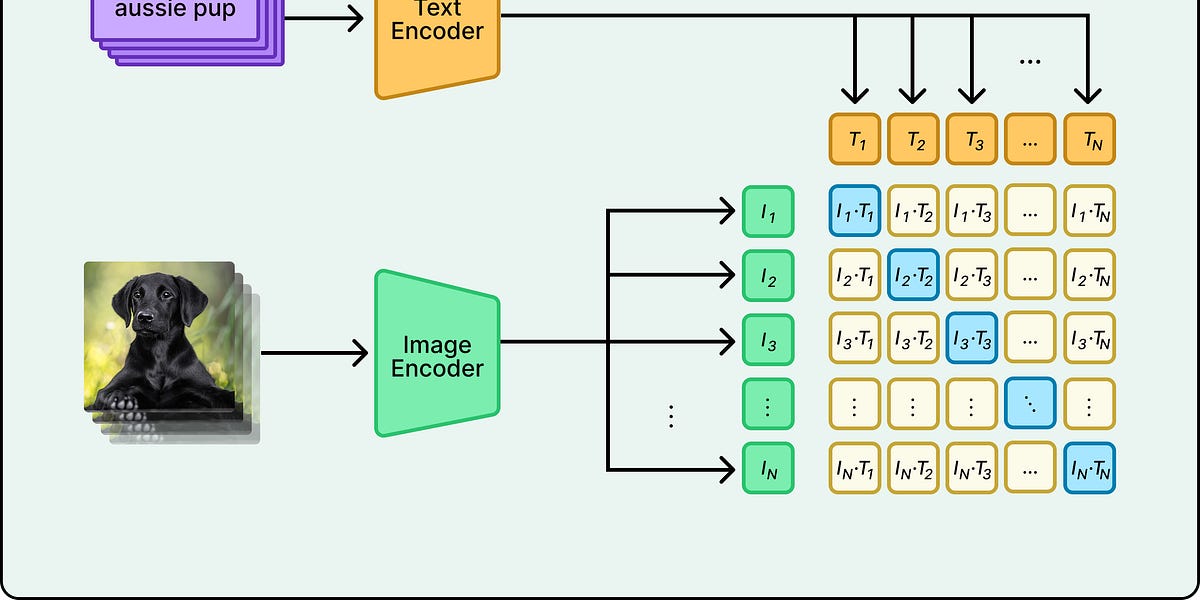

CLIP使用对比学习和视觉变换器架构,提高了训练效率。

-

CLIP的零-shot分类能力使其能够处理多种分类任务,无需重新训练。

-

CLIP在多种数据集上表现出色,超越了传统模型的性能。

-

尽管CLIP有一些局限性,如对空间推理和细微区分的困难,但它展示了从互联网数据学习的潜力。

-

CLIP已成为AI行业的基础设施,被广泛应用于图像搜索、内容审核和推荐系统。

❓

延伸问答

CLIP是什么,它的主要功能是什么?

CLIP是OpenAI开发的神经网络,通过学习4亿对图像和文本,实现无标注数据的图像分类。

CLIP如何克服传统计算机视觉的局限性?

CLIP通过匹配图像与文本描述,避免了对特定类别标签的预测,从而克服了传统计算机视觉需要大量标注数据的局限性。

CLIP的零-shot分类能力是什么?

CLIP的零-shot分类能力使其能够处理多种分类任务,无需重新训练,只需通过自然语言描述类别即可。

CLIP是如何进行训练的?

CLIP使用对比学习和视觉变换器架构,通过匹配图像和文本的向量来进行训练,提高了训练效率。

CLIP在实际应用中有哪些用途?

CLIP被广泛应用于图像搜索、内容审核和推荐系统等多个领域。

CLIP有哪些局限性?

CLIP在空间推理和细微区分方面存在困难,且对文本提示的敏感性可能影响其表现。

🏷️