如何使用Ollama在本地运行和自定义大型语言模型(LLMs)

freeCodeCamp.org

·

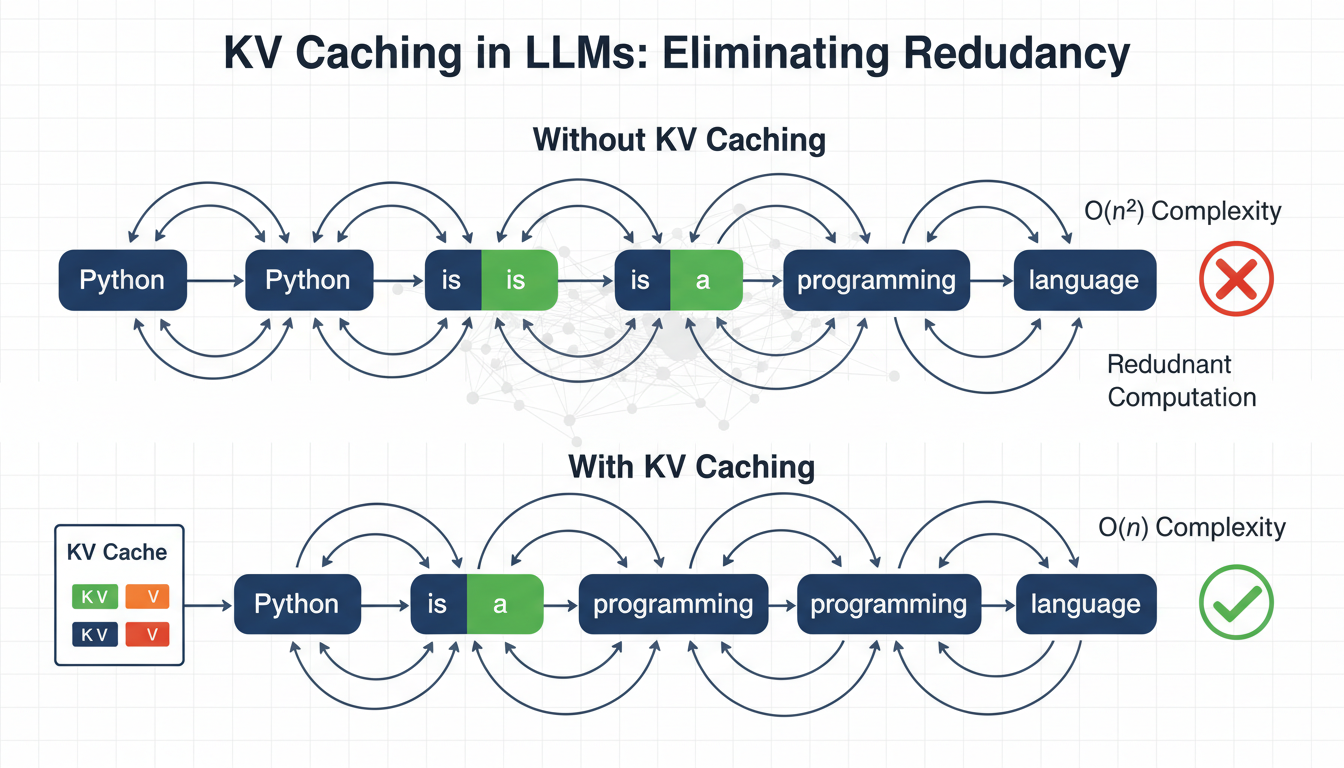

LLMs中的KV缓存:开发者指南

MachineLearningMastery.com

·

使用扩散生成文本(以及使用LLMs的投资回报)

Stack Overflow Blog

·

研究人员发现大型语言模型(LLMs)的一项缺陷,使其可靠性降低

MIT News - Artificial intelligence

·

CodeClash通过多轮编码比赛评估大型语言模型(LLMs)

InfoQ

·

利用大型语言模型(LLMs)进行结构化数据的五种高级特征工程技术

MachineLearningMastery.com

·

Guide to the OWASP Top 10 for LLMs: Vulnerability mitigation with Elastic

Elastic Blog - Elasticsearch, Kibana, and ELK Stack

·

大型语言模型(LLMs)的OWASP十大风险指南:与Elastic一起进行漏洞缓解

Elastic Blog - Elasticsearch, Kibana, and ELK Stack

·

如何利用Python和大型语言模型(LLMs)构建智能开支追踪器

freeCodeCamp.org

·

大型语言模型(LLMs)提升机器学习工作流程的五个关键方式

MachineLearningMastery.com

·

与Unmesh探讨如何利用大型语言模型(LLMs)构建语言

Martin Fowler

·

数据库迎来了新用户——大型语言模型(LLMs)——他们需要一种不同的数据库

Timescale Blog

·