💡

原文中文,约2200字,阅读约需6分钟。

📝

内容提要

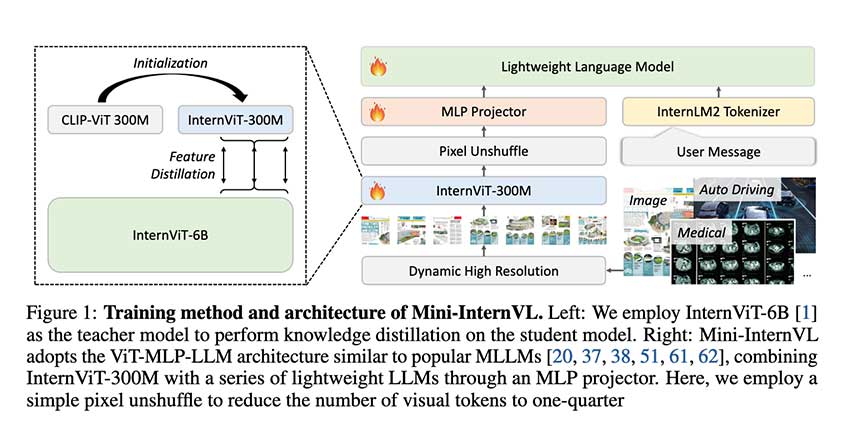

多模态大型语言模型(MLLM)迅速发展,结合视觉与语言处理,提升数据理解能力。Mini-InternVL系列轻量级MLLM通过减少参数,实现高效的多模态理解,适用于自动驾驶和医学成像等领域,表现出色。该模型在多个基准测试中展现出强大的适应性和性能,为资源有限的环境提供了可扩展的解决方案。

🎯

关键要点

- 多模态大型语言模型(MLLM)结合视觉与语言处理,提升数据理解能力。

- Mini-InternVL系列轻量级MLLM通过减少参数,实现高效的多模态理解。

- Mini-InternVL适用于自动驾驶和医学成像等领域,表现出色。

- 该模型在多个基准测试中展现出强大的适应性和性能。

- Mini-InternVL仅使用5%的参数即可保持大型多模态模型90%的性能。

- 模型设计为袖珍解决方案,提供比传统MLLM更低的计算开销。

- Mini-InternVL采用稳健的视觉编码器,增强模型的表示能力。

- 训练分为两个阶段,确保视觉和文本元素的稳健对齐。

- Mini-InternVL在多模态基准测试中表现良好,准确度与某些专有模型相当。

- 该模型在资源有限环境中提供可扩展的解决方案,提高了多模态大型语言模型的实际适用性。

❓

延伸问答

Mini-InternVL模型的主要优势是什么?

Mini-InternVL模型通过仅使用5%的参数实现90%的性能,适用于资源有限的环境,提供高效的多模态理解。

Mini-InternVL适合哪些应用领域?

Mini-InternVL适用于自动驾驶、医学成像和遥感等领域。

Mini-InternVL的训练过程是怎样的?

Mini-InternVL的训练分为两个阶段:首先进行语言-图像对齐的预训练,然后进行视觉指令调整以适应多模态任务。

Mini-InternVL在基准测试中的表现如何?

Mini-InternVL在多个基准测试中表现出色,特别是在MMBench和ChartQA上得分高,显示出强大的适应性。

Mini-InternVL与传统MLLM相比有什么优势?

Mini-InternVL提供更低的计算开销和更高的资源效率,适合在消费级设备上使用。

Mini-InternVL的视觉编码器有什么特点?

Mini-InternVL采用稳健的InternViT-300M视觉编码器,增强了模型的表示能力,支持有效的跨域传输。

➡️