💡

原文英文,约1300词,阅读约需5分钟。

📝

内容提要

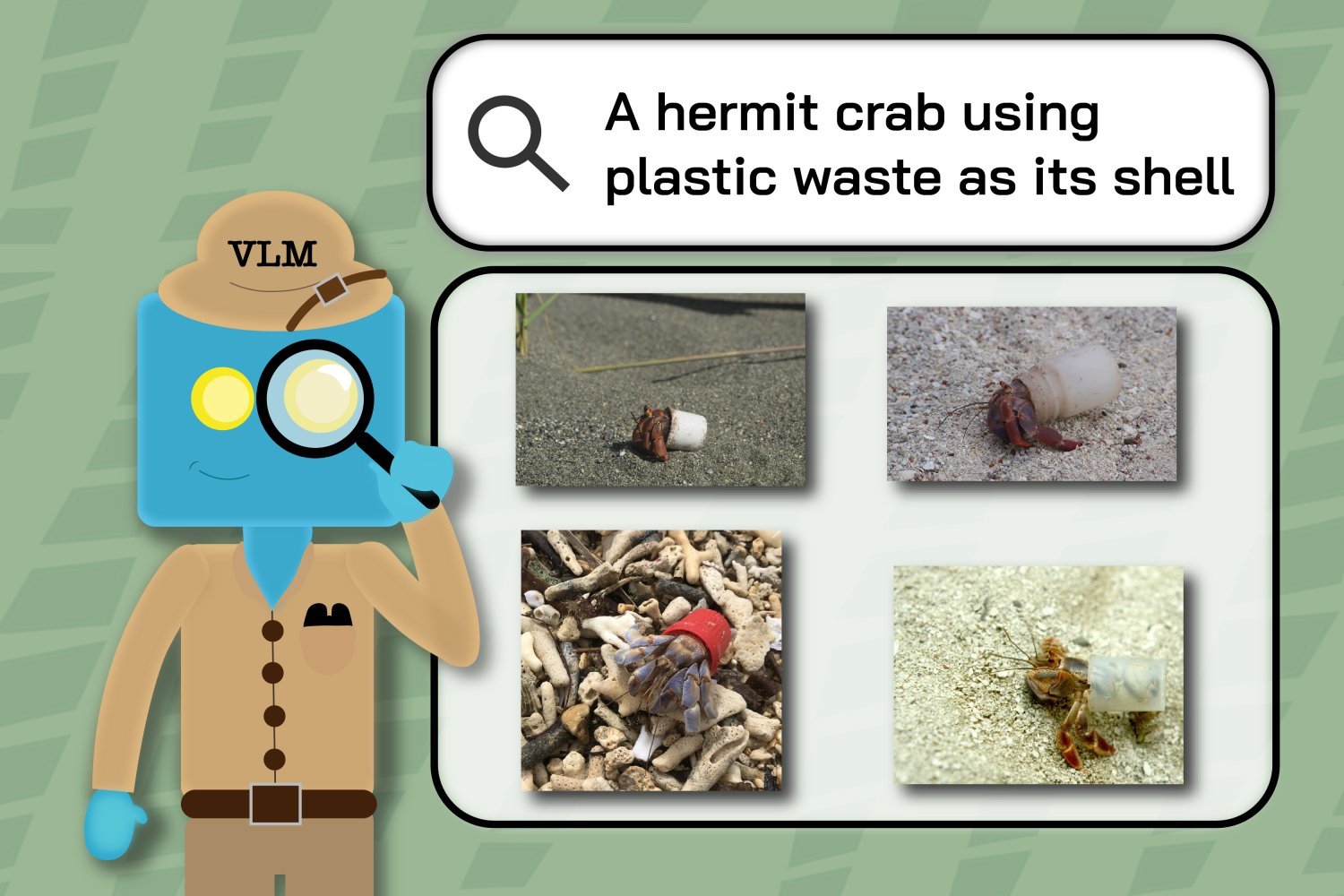

研究人员评估了多模态视觉语言模型(VLMs)在自然图像数据集中的图像检索能力。尽管大型VLMs在简单查询中表现良好,但在复杂且需专业知识的查询中仍显不足。研究指出,VLMs需要更多领域特定的训练数据,以提升对科学术语的理解和图像检索的准确性。

🎯

关键要点

- 研究人员评估了多模态视觉语言模型(VLMs)在自然图像数据集中的图像检索能力。

- 大型VLMs在简单查询中表现良好,但在复杂且需专业知识的查询中显不足。

- VLMs需要更多领域特定的训练数据,以提升对科学术语的理解和图像检索的准确性。

- MIT的研究团队设计了性能测试,评估VLMs在INQUIRE数据集中的表现。

- 研究发现,较大的VLMs在简单查询和复杂查询中表现更好,因其训练数据更丰富。

- VLMs在处理复杂查询时仍然存在困难,例如识别特定生物条件。

- INQUIRE数据集包含基于专家讨论的搜索查询,旨在帮助科学家检索特定图像。

- 研究表明,尽管一些视觉模型已经足够精确以帮助科学家检索图像,但许多任务仍然对现有模型来说过于困难。

- 研究团队正在与iNaturalist合作开发查询系统,以帮助科学家更快找到所需图像。

- INQUIRE数据集的能力强调了有效搜索大规模生物多样性数据集的重要性。

❓

延伸问答

多模态视觉语言模型(VLMs)在图像检索中表现如何?

VLMs在简单查询中表现良好,但在复杂且需专业知识的查询中显不足。

INQUIRE数据集的目的是什么?

INQUIRE数据集旨在帮助科学家检索特定图像,包含基于专家讨论的搜索查询。

研究人员发现VLMs在处理复杂查询时存在哪些困难?

VLMs在识别特定生物条件和行为时存在困难,例如识别青蛙的特定生物条件。

研究团队如何评估VLMs的表现?

研究团队设计了性能测试,评估VLMs在INQUIRE数据集中的表现,测试其在图像检索中的准确性。

研究结果对未来的科学研究有什么启示?

研究表明,VLMs需要更多领域特定的训练数据,以提升对科学术语的理解和图像检索的准确性。

研究团队与iNaturalist的合作目标是什么?

研究团队与iNaturalist合作开发查询系统,以帮助科学家更快找到所需图像。

➡️