内容提要

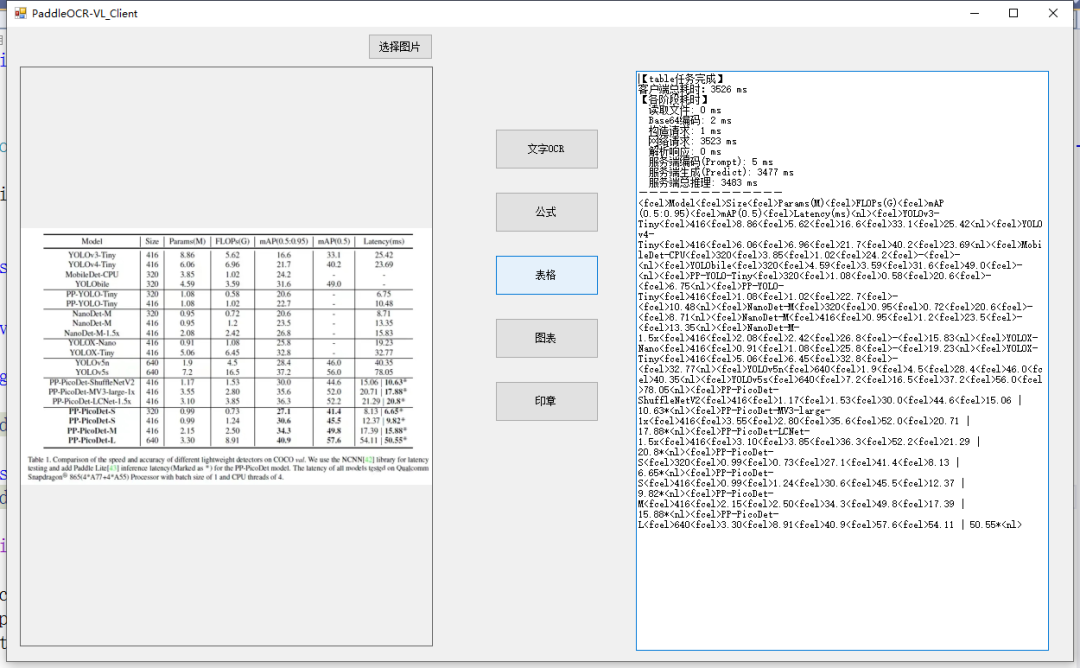

本文介绍了如何使用C# WinForm结合PaddleOCR-VL-1.5模型,构建一个本地离线的OCR客户端。该客户端支持多种识别任务,包括文字、表格和公式,架构简单,服务端与客户端解耦,便于升级和维护。通过RestSharp实现HTTP请求,确保识别过程的安全与高效。

关键要点

-

本文介绍了如何使用C# WinForm结合PaddleOCR-VL-1.5模型构建本地离线OCR客户端。

-

该客户端支持多种识别任务,包括文字、表格和公式,架构简单,服务端与客户端解耦。

-

通过RestSharp实现HTTP请求,确保识别过程的安全与高效。

-

整个方案的架构由C# WinForm客户端、llama-server和PaddleOCR-VL-1.5 GGUF模型三部分组成。

-

llama-server是轻量级HTTP服务器,负责加载GGUF模型并提供推理API。

-

环境准备包括llama.cpp、PaddleOCR模型文件、.NET Framework和RestSharp等组件。

-

启动llama-server需要指定模型文件路径、监听端口等关键参数。

-

客户端代码实现了图片选择、发送请求和结果显示的全流程,支持多种OCR任务。

延伸解读

本地OCR的优势

使用PaddleOCR-VL-1.5构建本地OCR客户端的最大优势在于数据隐私和安全性。与依赖云服务的OCR解决方案相比,本地处理避免了数据泄露的风险,适合处理敏感信息的场景。

架构解耦的好处

该方案的架构将客户端与服务端解耦,使得系统的维护和升级变得更加灵活。开发者可以独立更新llama-server或PaddleOCR模型,而无需对客户端代码进行修改,这降低了系统整体的维护成本。

环境准备的重要性

在搭建本地OCR客户端之前,确保环境准备充分是至关重要的。缺少必要的组件或版本不兼容可能导致系统无法正常运行,因此在开始之前应仔细检查所有依赖项的版本和配置。

延伸问答

如何使用C#构建本地OCR客户端?

可以使用C# WinForm结合PaddleOCR-VL-1.5模型,构建一个本地离线的OCR客户端。

PaddleOCR-VL-1.5支持哪些识别任务?

PaddleOCR-VL-1.5支持文字、表格、公式、图表和印章等多种识别任务。

llama-server的作用是什么?

llama-server是一个轻量级HTTP服务器,负责加载GGUF模型并提供推理API。

如何启动llama-server?

启动llama-server需要在终端执行命令,指定模型文件路径和监听端口等参数。

使用RestSharp有什么好处?

使用RestSharp可以通过HTTP调用本地服务,确保识别过程的安全与高效。

如何处理OCR识别的结果?

OCR识别的结果可以通过客户端代码进行显示,包括识别文本和各阶段耗时。