💡

原文中文,约1500字,阅读约需4分钟。

📝

内容提要

F2LLM-v2是蚂蚁集团与上海交通大学联合开源的嵌入模型,旨在解决语言偏见和透明度问题。该模型支持282种语言,尤其在多语言和代码搜索方面表现优异,提供多种尺寸以满足不同需求,推动开源社区发展。

🎯

关键要点

-

F2LLM-v2是蚂蚁集团与上海交通大学联合开源的嵌入模型,旨在解决语言偏见和透明度问题。

-

该模型支持282种语言,尤其在多语言和代码搜索方面表现优异。

-

F2LLM-v2提供多种尺寸以满足不同需求,从80M到14B,适应不同场景。

-

模型的训练数据全部来自公开资源,团队公开了完整的训练配方和相关代码,体现了开源透明的精神。

-

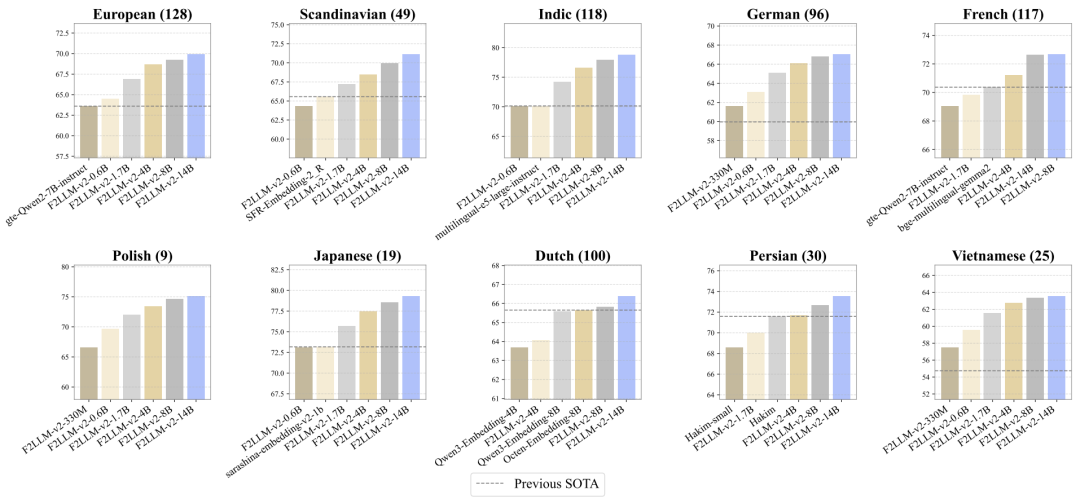

F2LLM-v2在MTEB评测中表现出色,刷新了多项SOTA记录,成为开发者构建智能化代码库检索的首选。

-

所有模型均支持套娃式表征,提供灵活的存储成本和检索速度的权衡空间。

-

F2LLM-v2代表了开源社区的力量,推动了更包容、更透明的AI世界的构建。

❓

延伸问答

F2LLM-v2的主要目标是什么?

F2LLM-v2旨在解决语言偏见和透明度问题,推动开源社区的发展。

F2LLM-v2支持多少种语言?

F2LLM-v2支持282种语言,特别在多语言和代码搜索方面表现优异。

F2LLM-v2的模型尺寸有哪些?

F2LLM-v2提供从80M到14B的多种尺寸,以满足不同需求。

F2LLM-v2在MTEB评测中的表现如何?

F2LLM-v2在MTEB评测中表现出色,刷新了多项SOTA记录。

F2LLM-v2的训练数据来源是什么?

F2LLM-v2的训练数据全部来自公开资源,团队公开了完整的训练配方和相关代码。

F2LLM-v2如何支持开发者的需求?

F2LLM-v2通过提供多种模型尺寸和灵活的存储成本与检索速度的权衡,支持开发者的不同需求。

➡️