💡

原文中文,约1400字,阅读约需4分钟。

📝

内容提要

近年来,AI行业认识到并非所有场景都需使用大型模型。高昂的推理成本和数据隐私风险使得小型模型在实际应用中更具效率。新开源的MiniCPM-V 4.6模型仅有1.3B参数,支持多种任务,适合在端侧设备上运行,推动AI应用落地。

🎯

关键要点

- AI行业逐渐认识到并非所有场景都需要大型模型,尤其是在实际应用中。

- 大型模型的高昂推理成本、网络延迟和数据隐私风险使得小型模型更具效率。

- 轻量级模型在端侧设备和高并发工业环境中展现出更高的性价比,承担基础任务如OCR和图像问答。

- 新开源的MiniCPM-V 4.6模型仅有1.3B参数,支持多种任务,包括图像理解和多轮对话。

- MiniCPM-V 4.6模型适合在单卡GPU环境中进行快速验证与应用原型开发,便于全球开发者使用。

❓

延伸问答

MiniCPM-V 4.6模型的参数规模是多少?

MiniCPM-V 4.6模型的参数规模约为1.3B。

为什么小型模型在实际应用中更具效率?

小型模型在推理成本、网络延迟和数据隐私风险方面表现更好,因此在实际应用中更具效率。

MiniCPM-V 4.6支持哪些任务?

MiniCPM-V 4.6支持图像理解、视频理解、OCR和多轮多模态对话等任务。

如何在单卡GPU环境中使用MiniCPM-V 4.6进行验证?

可以使用官方提供的基于Transformers的AutoProcessor与AutoModelForImageTextToText推理方案进行快速验证。

MiniCPM-V 4.6模型的开源合作方有哪些?

MiniCPM-V 4.6模型是由面壁智能、清华大学和OpenBMB联合开源的。

如何在线部署MiniCPM-V 4.6模型?

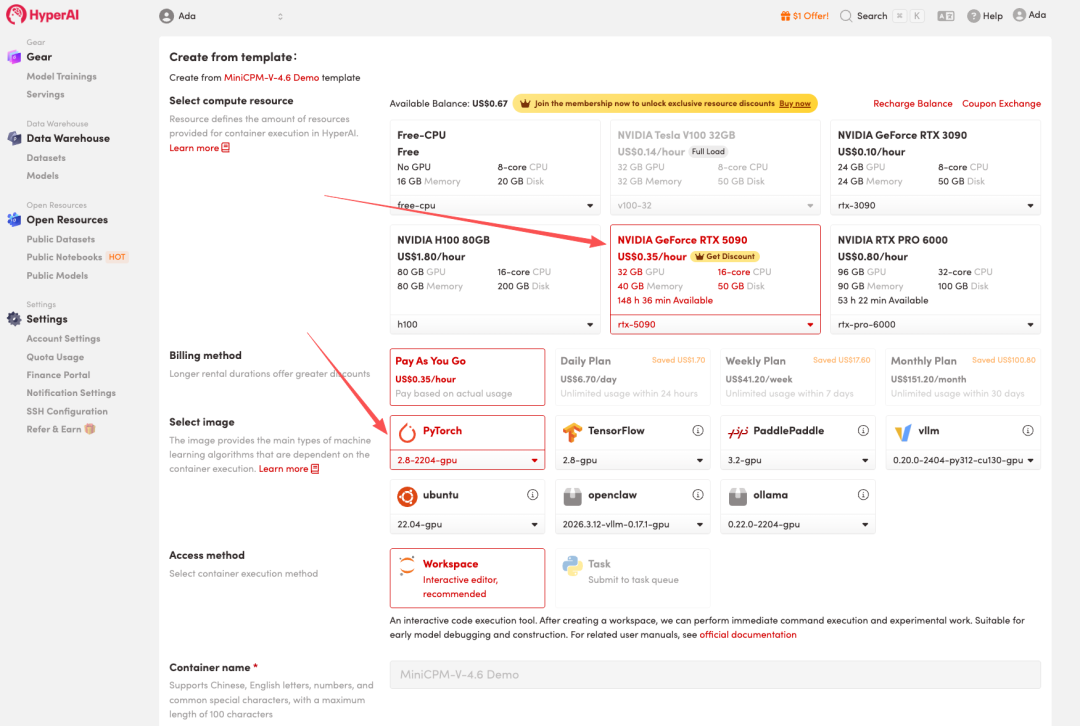

可以通过HyperAI平台完成环境配置并轻松实现该模型的在线部署。

➡️