💡

原文英文,约2600词,阅读约需10分钟。

📝

内容提要

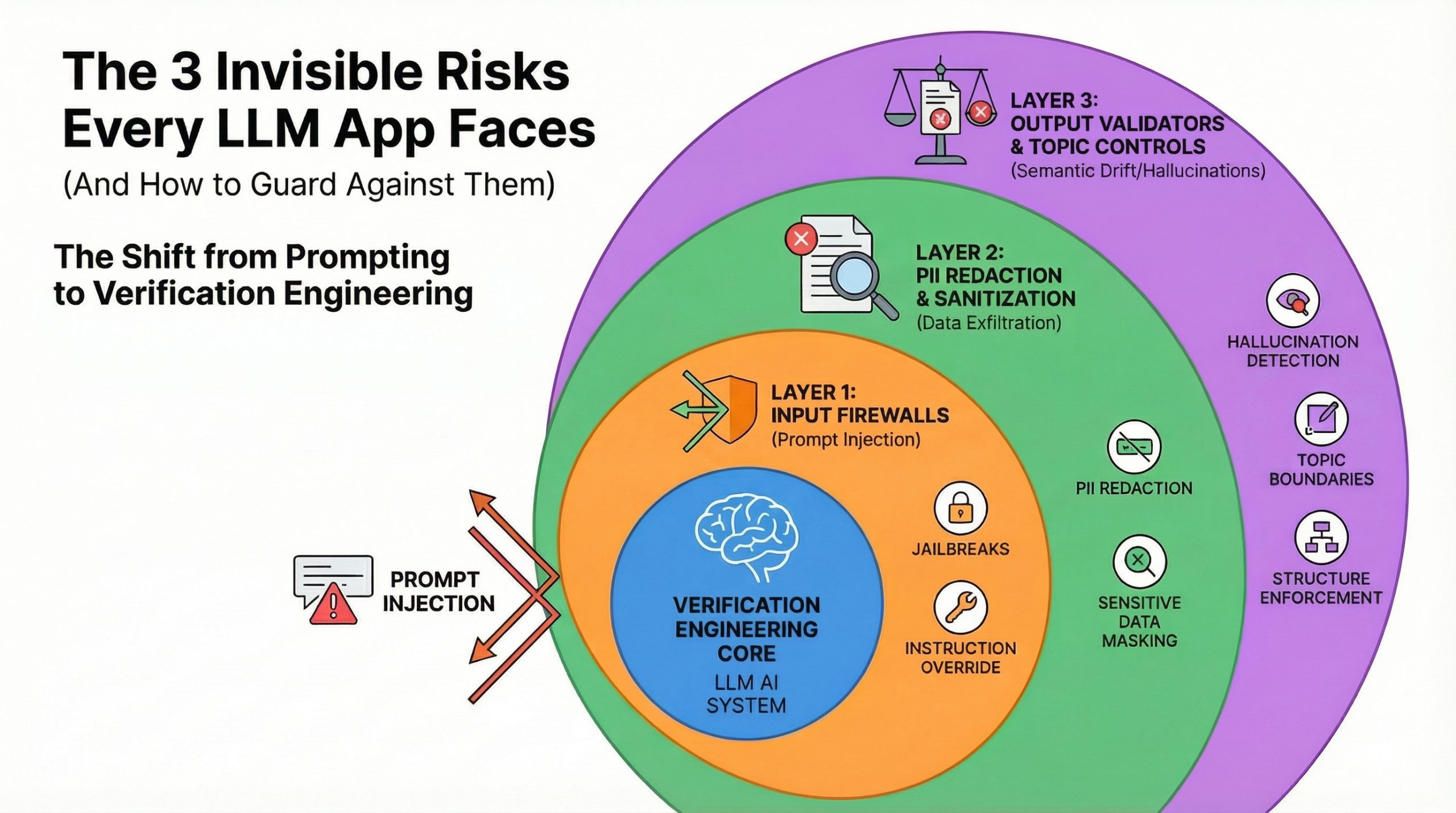

大型语言模型应用面临三大隐性风险:提示注入、数据外泄和语义漂移。提示注入可能导致用户操控AI行为,数据外泄可能泄露敏感信息,语义漂移则使AI生成不准确或不相关的回答。为应对这些风险,建议使用输入防火墙、PII检测工具和输出验证器等安全措施,以确保AI的安全性和可靠性。

🎯

关键要点

- 大型语言模型应用面临三大隐性风险:提示注入、数据外泄和语义漂移。

- 提示注入可能导致用户操控AI行为,用户可以通过嵌入指令来覆盖应用的预期行为。

- 数据外泄可能泄露敏感信息,包括个人身份信息(PII)和公司机密数据。

- 语义漂移使AI生成不准确或不相关的回答,可能导致用户信任度下降。

- 为应对这些风险,建议使用输入防火墙、PII检测工具和输出验证器等安全措施。

❓

延伸问答

大型语言模型应用面临哪些隐性风险?

大型语言模型应用面临三大隐性风险:提示注入、数据外泄和语义漂移。

什么是提示注入,如何影响AI的行为?

提示注入是指用户在输入中嵌入指令,可能覆盖应用的预期行为,导致AI执行不当操作。

数据外泄的风险如何发生?

数据外泄可能通过AI无意中透露训练数据中的敏感信息或在检索增强生成过程中分享公司数据库的信息。

语义漂移是什么,为什么会造成用户信任度下降?

语义漂移是指AI生成不准确或不相关的回答,可能导致用户对AI的信任度下降。

如何防范提示注入风险?

可以使用输入防火墙来分析用户提示,检测并阻止恶意输入,从而防范提示注入风险。

PII检测工具的作用是什么?

PII检测工具用于自动识别和屏蔽敏感信息,防止在用户交互中泄露个人身份信息。

➡️