💡

原文中文,约2000字,阅读约需5分钟。

📝

内容提要

Meta近期发布了WebSSL模型,探索无语言视觉自监督学习的潜力。该模型在大规模图像数据集上训练,展现了在视觉问答和OCR等任务中的竞争力,挑战了语言监督的重要性,并强调了数据集组成和模型规模的影响。WebSSL为未来的多模态系统提供了开源基础。

🎯

关键要点

- Meta发布WebSSL模型,探索无语言视觉自监督学习的潜力。

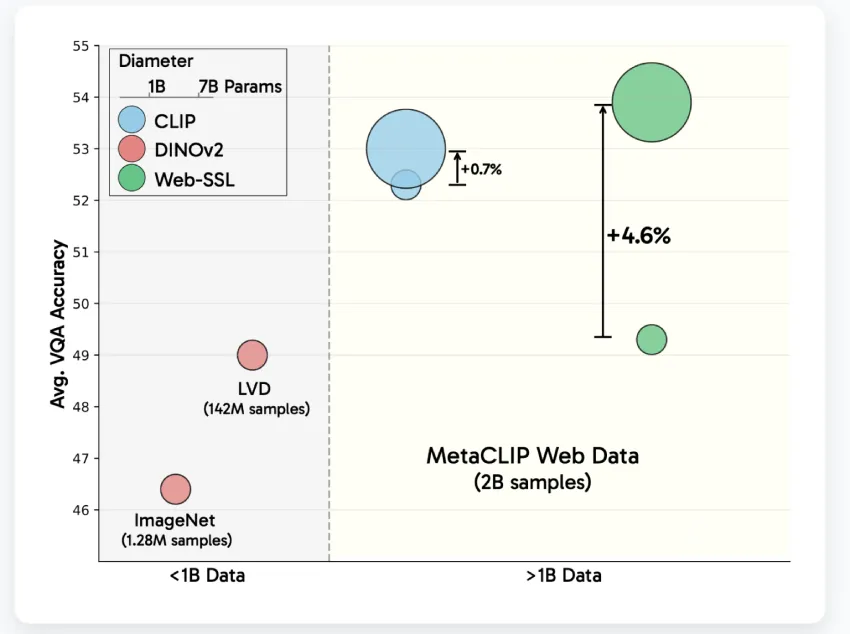

- WebSSL模型在大规模图像数据集上训练,展现了在视觉问答和OCR等任务中的竞争力。

- 无语言视觉自监督学习在多模态推理中尚未得到充分利用。

- WebSSL模型参数范围从3亿到70亿,专门在MetaCLIP数据集的图像子集上进行训练。

- WebSSL模型的评估使用Cambrian-1进行,涵盖多个视觉理解任务。

- 随着模型规模的增加,WebSSL模型的VQA性能呈现出近乎对数线性的提升。

- 数据组成至关重要,过滤训练数据后WebSSL在OCR和图表任务上表现优于CLIP。

- 高分辨率训练进一步缩小了WebSSL与高分辨率模型的性能差距。

- WebSSL与预训练语言模型的对齐效果随着模型规模和训练次数的增加而提升。

- WebSSL研究提供了证据,表明视觉自监督学习是语言监督预训练的可行替代方案。

➡️