💡

原文中文,约1900字,阅读约需5分钟。

📝

内容提要

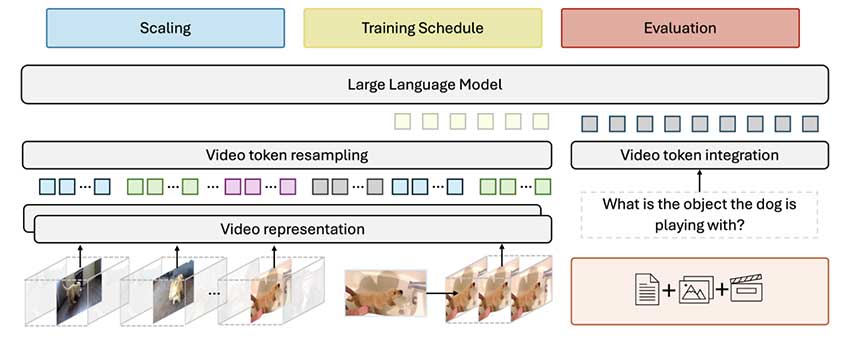

Meta AI与斯坦福大学联合开发的Apollo视频多模态模型,旨在提升视频理解能力。Apollo通过优化设计和双视觉编码器,支持处理最长一小时的视频,性能超越多种大型模型,为视频问答和内容分析提供有效解决方案。

🎯

关键要点

- Meta AI与斯坦福大学联合开发Apollo视频多模态模型,旨在提升视频理解能力。

- Apollo支持处理最长一小时的视频,性能超越多种大型模型。

- 现有视频模型面临计算资源需求高和难以捕捉运动时间模式的问题。

- Apollo通过优化设计和双视觉编码器解决视频理解的挑战。

- Apollo模型有三种大小,适应不同计算约束和需求。

- 每秒帧数采样技术提高了视频时间一致性。

- 双视觉编码器结合空间理解和时间推理,提供更准确的视频表示。

- Apollo采用三阶段训练流程,确保稳定有效的学习。

- Apollo支持基于视频内容的多轮对话,适用于聊天系统和内容分析。

- Apollo在多个基准测试中表现优异,超越了许多大型模型。

- Apollo为视频理解提供了实用而强大的解决方案,推动了视频LMM的发展。

➡️