💡

原文中文,约6100字,阅读约需15分钟。

📝

内容提要

飞桨推出插件式CUDA兼容硬件接入方案,模型推理速度提升2.2倍。通过C接口实现CINN编译器与硬件解耦,支持动态注册,降低适配成本,促进国产芯片融入AI生态。

🎯

关键要点

- 飞桨推出插件式CUDA兼容硬件接入方案,模型推理速度提升2.2倍。

- 通过C接口实现CINN编译器与硬件解耦,支持动态注册,降低适配成本。

- 新方案允许CUDA兼容类硬件即插即用,享受飞桨框架的图优化与算子自动生成技术。

- 硬件厂商只需实现标准化接口,显著降低了研发门槛和代码开发量。

- 该方案使得编译器底层技术壁垒降低,促进国产芯片融入AI生态。

- 未来,飞桨将继续与硬件生态伙伴合作,探索动态Shape优化与算子定制。

❓

延伸问答

飞桨的插件式CUDA兼容硬件接入方案有什么优势?

该方案使模型推理速度提升2.2倍,并通过C接口实现编译器与硬件解耦,降低适配成本。

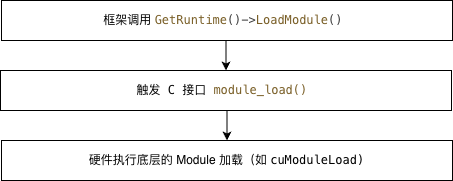

如何实现飞桨CINN编译器与硬件的解耦?

通过C接口和动态链接机制,CINN编译器与硬件底层编译工具链实现了彻底解耦。

硬件厂商如何接入飞桨的CINN编译器?

硬件厂商只需实现标准化接口,并通过动态库形式供飞桨加载即可。

飞桨的方案如何降低研发门槛?

新方案显著减少了需要修改的核心代码量,厂商只需实现数十行C接口的映射。

飞桨未来的计划是什么?

飞桨将继续与硬件生态伙伴合作,探索动态Shape优化与算子定制。

飞桨CINN编译器的技术壁垒如何降低?

通过插件式接入方案,编译器底层技术壁垒降低,促进国产芯片融入AI生态。

➡️