💡

原文英文,约2000词,阅读约需8分钟。

📝

内容提要

Speculative decoding是一种优化技术,通过小型草稿模型加速大型LLM的推理。Speculators v0.3.0支持Eagle3草稿模型的端到端训练,简化训练流程并提升生成速度,特别适用于低吞吐量场景,减少模型延迟,提高性能。

🎯

关键要点

- Speculative decoding是一种优化技术,通过小型草稿模型加速大型LLM的推理。

- Speculators v0.3.0支持Eagle3草稿模型的端到端训练,简化训练流程并提升生成速度。

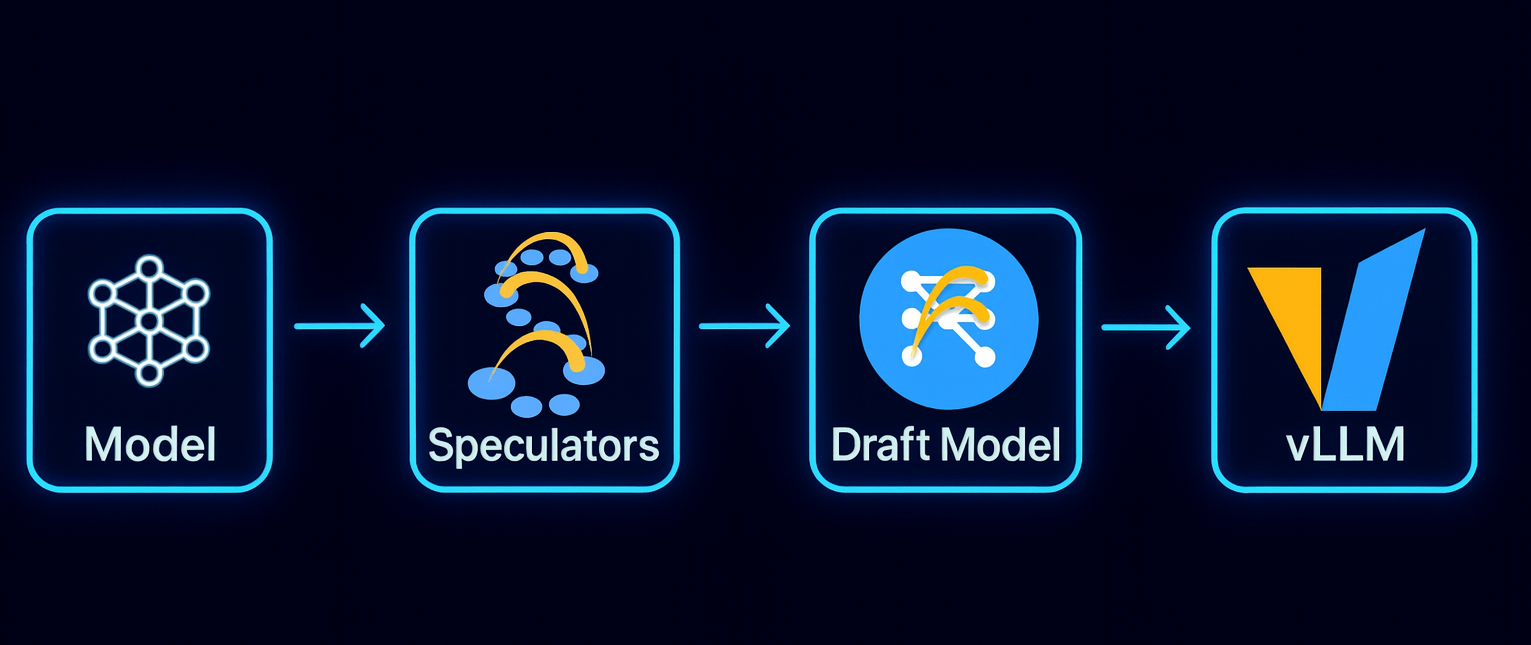

- Speculators库为研究人员和工程师提供了生成推测解码模型的工具,支持与vLLM无缝集成。

- 推测解码允许LLM在单次前向传递中生成多个标记,使用小型草稿模型与完整的验证模型配合。

- Eagle3草稿模型利用验证模型的隐藏状态作为输入,生成草稿标记。

- Speculators v0.3.0支持离线数据生成,通过隐藏状态生成器从标准LLM文本数据集中提取值。

- 训练Eagle3草稿模型需要样本序列的数据集,包括验证模型的隐藏状态和输出概率。

- Speculators使用FlexAttention优化训练过程,处理稀疏的注意力掩码以提高计算效率。

- 训练完成后,模型可以通过简单的vllm serve命令在vLLM中运行,支持灵活的配置选项。

- Speculators与vLLM的紧密集成使推测解码成为生产就绪的特性,支持多种模型架构和配置。

- 未来的计划包括在线数据生成、支持视觉语言模型的数据生成和重新生成验证器响应。

❓

延伸问答

什么是推测解码,它的主要作用是什么?

推测解码是一种优化技术,通过小型草稿模型加速大型LLM的推理,允许在单次前向传递中生成多个标记,从而提高生成速度。

Speculators v0.3.0有哪些主要功能?

Speculators v0.3.0支持Eagle3草稿模型的端到端训练,简化训练流程,支持离线数据生成,并与vLLM无缝集成。

Eagle3草稿模型是如何工作的?

Eagle3草稿模型利用验证模型的隐藏状态作为输入,生成草稿标记,并通过验证模型并行处理这些标记。

如何在vLLM中运行Speculators模型?

可以通过简单的vllm serve命令运行Speculators模型,命令会读取speculators_config中的设置,加载草稿模型和验证模型。

Speculators如何优化训练过程?

Speculators使用FlexAttention优化训练过程,处理稀疏的注意力掩码,提高计算效率,并支持智能批处理算法。

未来Speculators的计划是什么?

未来计划包括在线数据生成、支持视觉语言模型的数据生成和重新生成验证器响应,以提高训练数据的对齐性。

➡️