💡

原文中文,约3800字,阅读约需9分钟。

📝

内容提要

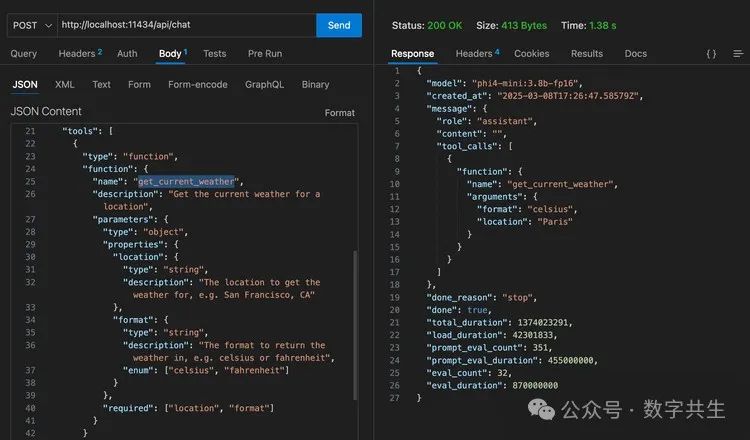

Phi-4-mini和Phi-4-multimodal现已支持函数调用功能,能够与外部工具和API交互。通过在边缘设备上部署这些模型,可以提高任务执行效率。文章介绍了如何利用这些功能构建高效的AI代理,并提供了函数调用的应用场景和示例。使用Ollama工具可以在有限计算能力下实现AI代理的本地部署。

🎯

关键要点

- Phi-4-mini和Phi-4-multimodal支持函数调用功能,可以与外部工具和API交互。

- 在边缘设备上部署这些模型可以提高任务执行效率。

- 函数调用的工作原理包括工具集成、函数定义、LLM检测、JSON输出和外部执行。

- 应用场景包括数据检索、操作执行、计算任务、数据处理和UI/UX集成。

- 使用Ollama工具可以在有限计算能力下实现AI代理的本地部署。

- 需要在System中定义Tools以启动单函数或并行函数调用。

- 通过调整模板和绑定量化模型,可以实现Phi-4-mini的单函数调用和并行函数调用。

❓

延伸问答

Phi-4-mini和Phi-4-multimodal的函数调用功能有什么用?

它们可以与外部工具和API交互,提高任务执行效率。

如何在边缘设备上部署AI代理?

可以使用Ollama工具在边缘设备上本地部署Phi-4-mini。

函数调用的工作原理是什么?

包括工具集成、函数定义、LLM检测、JSON输出和外部执行。

Phi-4-mini支持哪些类型的函数调用?

支持单函数调用和并行函数调用。

使用Ollama时需要注意什么?

需要在System中定义Tools以启动函数调用,并确保绑定正确的量化模型。

函数调用的应用场景有哪些?

包括数据检索、操作执行、计算任务、数据处理和UI/UX集成。

➡️