💡

原文中文,约1600字,阅读约需4分钟。

📝

内容提要

大型语言模型(LLM)面临存储、内存和网络带宽的瓶颈。模型压缩技术如修剪、知识提炼和量化旨在减小模型体积。ZipNN是一种新型无损压缩技术,能够将神经网络模型压缩高达33%,同时提升性能和速度,显著减少网络流量。研究表明,针对模型架构的定制压缩有效解决了存储和通信的低效率问题。

🎯

关键要点

- 大型语言模型(LLM)面临存储、内存和网络带宽的瓶颈。

- 模型压缩技术包括修剪、知识提炼和量化,旨在减小模型体积。

- ZipNN是一种新型无损压缩技术,能够将神经网络模型压缩高达33%。

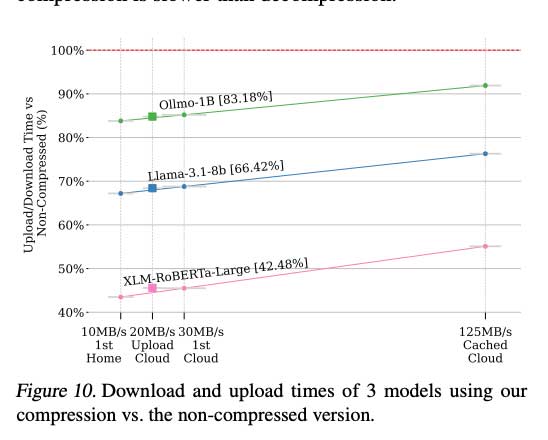

- ZipNN在性能和速度上优于普通压缩技术,压缩和解压速度提高了62%。

- ZipNN有潜力每月为大型模型分发平台节省1EB的网络流量。

- ZipNN的架构支持高效、并行的神经网络模型压缩,适合多核心GPU架构。

- 研究表明,模型架构中存在大量冗余,可以通过定制压缩技术解决。

- 尽管大型模型趋势明显,但可以在不损害模型完整性的情况下节省空间和带宽。

❓

延伸问答

ZipNN是什么?

ZipNN是一种新型无损压缩技术,专为神经网络设计,能够将模型压缩高达33%。

ZipNN与其他模型压缩技术相比有什么优势?

ZipNN在性能和速度上优于普通压缩技术,压缩和解压速度提高了62%。

ZipNN如何影响大型语言模型的网络流量?

ZipNN有潜力每月为大型模型分发平台节省1EB的网络流量。

ZipNN的架构设计有什么特点?

ZipNN的架构支持高效、并行的模型压缩,特别适合多核心GPU架构。

ZipNN的实验评估是在什么环境下进行的?

ZipNN的实验评估是在一台拥有10个内核和64GB RAM的Apple M1 Max机器上进行的。

ZipNN的压缩策略是如何工作的?

ZipNN的压缩策略在块级别和字节组级别上运行,允许独立处理模型段。

➡️