💡

原文英文,约700词,阅读约需3分钟。

📝

内容提要

随着AI代理从原型转向生产,组织需确保质量并扩大评估流程。MLflow提供定制化的LLM评估工具,提升AI代理的质量与可靠性。新功能如可调评估者和自动评估工具,简化了开发与领域专家的协作,提高了评估效率。

🎯

关键要点

- AI代理从原型转向生产,组织需确保质量并扩大评估流程。

- MLflow提供定制化的LLM评估工具,提升AI代理的质量与可靠性。

- 新功能包括可调评估者和自动评估工具,简化开发与领域专家的协作。

- 定制评估逻辑的构建以前耗时且需要开发者与领域专家紧密合作。

- MLflow推出的可调评估者使得与领域专家的系统性对齐成为可能。

- Agent-as-a-Judge自动确定评估的追踪部分,消除复杂的手动实现开销。

- Judge Builder提供直观的可视化工作流程,简化开发者与领域专家之间的协作。

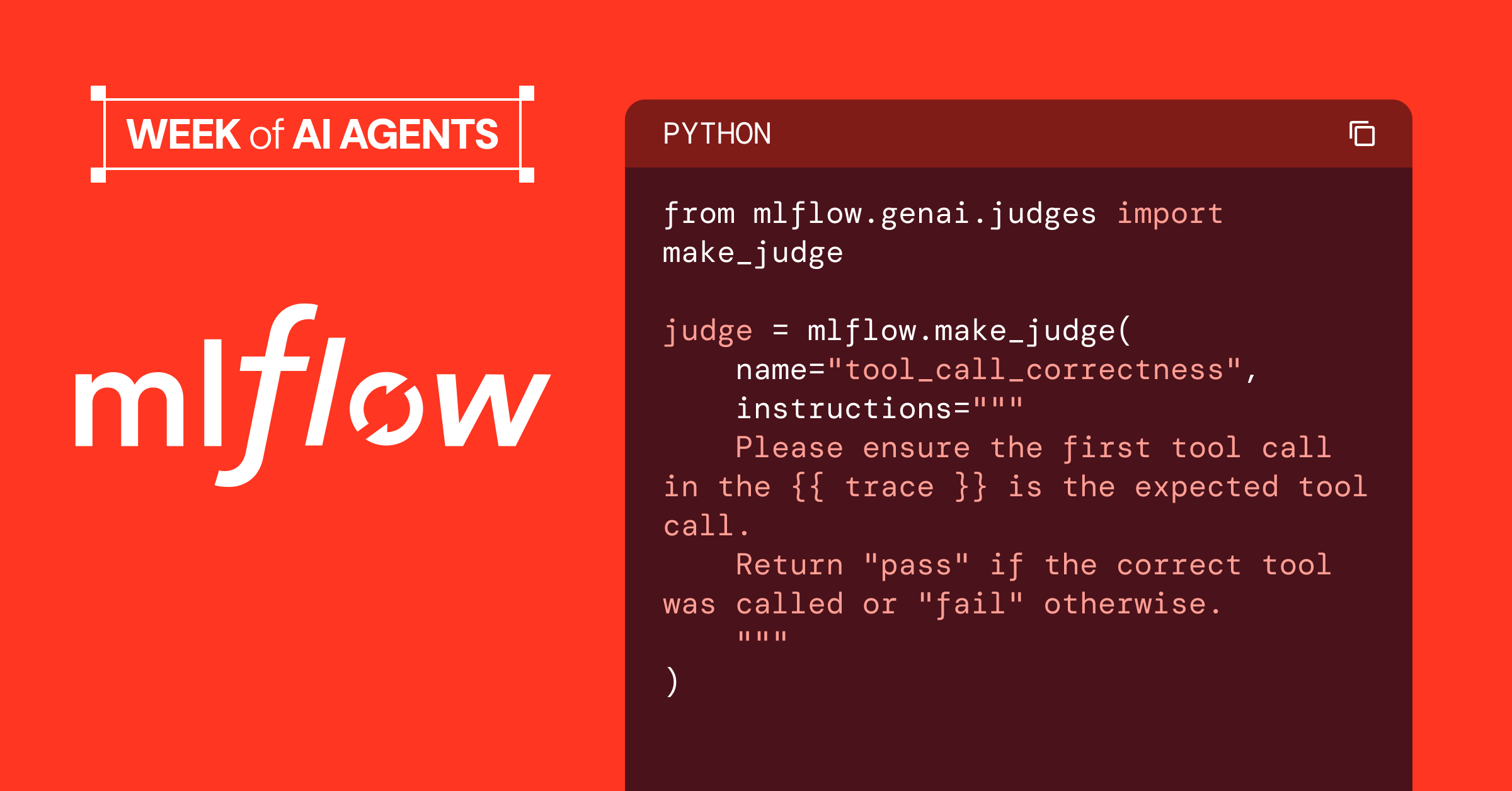

- 使用make_judge SDK可以轻松创建定制的LLM评估者,使用自然语言指令。

- MLflow的调优和对齐工具帮助将领域专家的反馈编码到评估逻辑中。

- Agent-as-a-Judge通过自动识别追踪中相关部分,简化评估过程,消除手动数据处理的需要。

❓

延伸问答

如何确保AI代理的质量和可靠性?

组织可以通过使用MLflow提供的定制化LLM评估工具来确保AI代理的质量和可靠性。

MLflow的新功能有哪些?

MLflow的新功能包括可调评估者、Agent-as-a-Judge和Judge Builder,这些功能简化了开发与领域专家的协作。

什么是Agent-as-a-Judge?

Agent-as-a-Judge是一种自动确定评估追踪部分的工具,消除了复杂的手动实现开销。

如何创建定制的LLM评估者?

可以使用MLflow的make_judge SDK,通过自然语言指令轻松创建定制的LLM评估者。

定制评估逻辑的构建有什么挑战?

构建定制评估逻辑以前耗时且需要开发者与领域专家紧密合作,造成开发周期的瓶颈。

如何将领域专家的反馈编码到评估逻辑中?

MLflow的调优和对齐工具可以帮助将领域专家的反馈直接编码到定制评估者的逻辑中。

➡️