💡

原文英文,约3400词,阅读约需13分钟。

📝

内容提要

本文介绍了LangChain和增强生成技术(RAG)的最佳实践,重点在于如何利用向量存储构建语言模型应用。内容涵盖数据加载、文本分割、向量存储、检索方法(如相似性搜索和最大边际相关性),以及如何通过大型语言模型(LLM)生成准确回答。提供示例代码,帮助读者提高查询的准确性和效率。

🎯

关键要点

- LangChain是一个开源开发框架,用于构建大型语言模型应用。

- RAG过程依赖于向量存储加载和检索增强生成。

- 数据加载器可处理不同格式的数据,包括PDF和网页。

- 文本分割器用于将文档分割成较小的块,以提高计算效率和模型的泛化能力。

- 向量存储用于存储每个文本块,并在查询时返回最相似的向量。

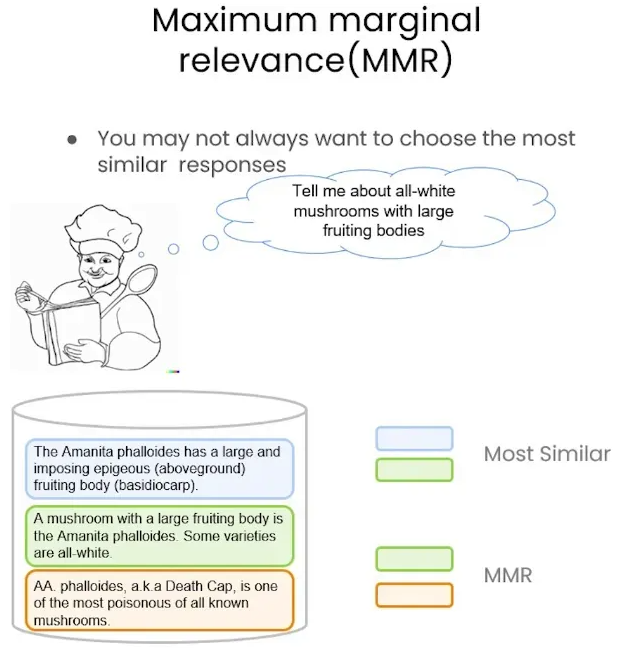

- 相似性搜索和最大边际相关性(MMR)是检索方法,用于提高查询的准确性和多样性。

- 元数据可以用于过滤检索结果,从而提高查询的准确性。

- LLM辅助检索使用语言模型自动解析句子语义,提取过滤信息。

- 压缩检索机制通过提取相关部分来减少资源浪费。

- 检索问答链结合检索结果和生成能力,提高答案的准确性和实时更新知识库的能力。

❓

延伸问答

LangChain是什么?

LangChain是一个开源开发框架,用于构建大型语言模型应用。

RAG过程的主要步骤是什么?

RAG过程包括向量存储加载和检索增强生成,用户输入后系统从向量存储中检索相关文档片段,并结合上下文生成答案。

如何提高查询的准确性?

可以通过使用相似性搜索和最大边际相关性(MMR)等检索方法,以及利用元数据过滤检索结果来提高查询的准确性。

文本分割器的作用是什么?

文本分割器用于将文档分割成较小的块,以提高计算效率和模型的泛化能力。

什么是最大边际相关性(MMR)?

最大边际相关性(MMR)是一种检索方法,旨在平衡检索结果的相关性和多样性,避免重复信息。

如何使用LangChain进行文档加载?

可以使用不同格式的数据加载器,如PDF和网页加载器,来处理和加载文档。

➡️