💡

原文中文,约4100字,阅读约需10分钟。

📝

内容提要

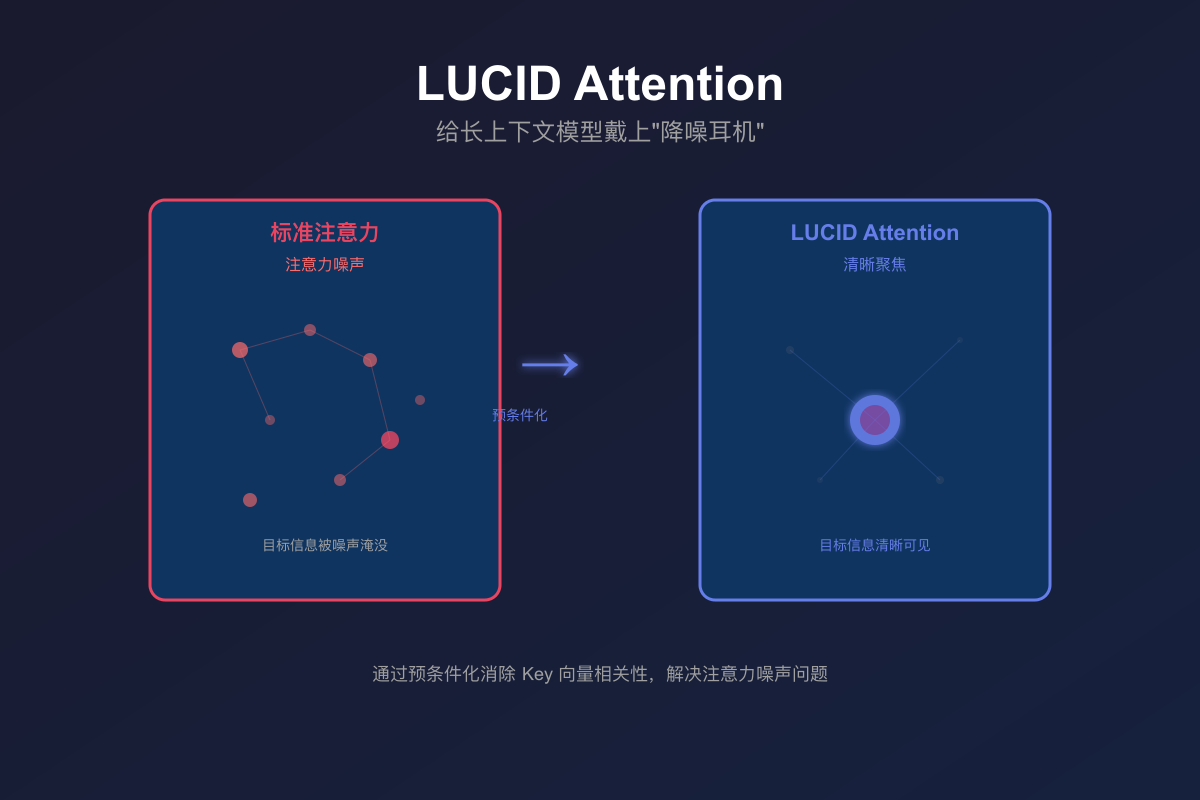

LUCID Attention 提出了一种新型注意力机制,通过去相关化 key 向量,解决了长上下文模型中的噪声和学习困境,提高了信息检索精度,计算开销几乎不变,适用于长上下文任务。

🎯

关键要点

- LUCID Attention 提出了一种新型注意力机制,通过去相关化 key 向量,解决了长上下文模型中的噪声和学习困境。

- LUCID Attention 使模型在超长上下文中精准找到重要信息,计算开销几乎不变。

- 标准 softmax 注意力机制在处理长上下文时存在噪声和学习困境。

- LUCID 的核心洞察是 key 向量之间的相关性导致注意力噪声。

- LUCID 通过构建预条件器消除 key 向量之间的相关性,从而提高检索精度。

- LUCID 的计算复杂度保持 O(N²d),与标准注意力相同,训练和推理开销增加很小。

- 在多个长上下文基准测试中,LUCID 显著提升了检索精度和模型性能。

- LUCID 适用于长上下文任务、精确检索需求和多跳推理。

- LUCID 的设计可以与多种现有技术互补,提升性能。

- LUCID 的贡献在于提供了新的理论视角,展示了预条件化在深度学习中的应用潜力。

🏷️

标签

➡️