💡

原文中文,约2000字,阅读约需5分钟。

📝

内容提要

研究人员提出了一种新型环路残差神经网络,通过迭代优化提升Transformer模型性能,减少参数和层数,适用于低端设备。实验结果表明,该模型在复杂模式捕捉方面优于同规模基线模型,未来可探索更多神经网络架构。

🎯

关键要点

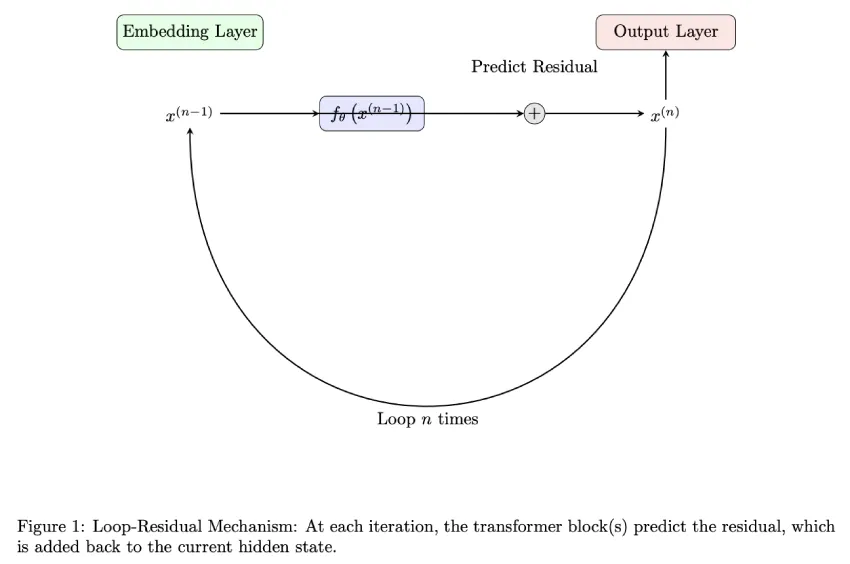

- 研究人员提出了一种新型环路残差神经网络,旨在提升Transformer模型性能。

- 该模型通过迭代优化,减少参数和层数,适用于低端设备。

- 实验结果显示,环路残差模型在复杂模式捕捉方面优于同规模基线模型。

- 传统Transformer模型存在一次性投影的局限性,限制了其迭代改进能力。

- Loop-Residual神经网络通过多次重访输入,优化预测,提升了Transformer性能。

- 与标准GPT-2版本比较,Loop-Residual模型在验证损失上表现相当,但参数减少了35%。

- 实验表明,环路残差模型能够在不增加模型大小的情况下实现显著性能提升。

- 未来可探索更多神经网络架构,尤其是在资源受限设备上的应用。

❓

延伸问答

什么是环路残差神经网络?

环路残差神经网络是一种新型神经网络架构,通过迭代优化提升Transformer模型性能,适用于低端设备。

环路残差神经网络如何提升Transformer模型的性能?

该网络通过多次重访输入并在模型子集上进行迭代循环来优化预测,从而提升Transformer的性能。

环路残差神经网络与传统Transformer模型相比有什么优势?

环路残差神经网络在复杂模式捕捉方面优于同规模基线模型,并且参数减少了35%。

实验结果显示环路残差神经网络的验证损失是多少?

环路残差GPT-2模型在OpenWebText数据集上的验证损失为3.11,与GPT-2-124M模型的3.12损失相当。

环路残差神经网络适合于哪些设备?

该网络适用于低端设备,能够在资源受限的环境中实现更佳效果。

未来对环路残差神经网络的研究方向是什么?

未来可以探索更多神经网络架构,特别是在资源受限设备上的应用。

➡️