💡

原文中文,约2500字,阅读约需6分钟。

📝

内容提要

本文介绍如何利用AI技术为WebRTC视频会议实时生成字幕,提升会议体验。通过音频流处理、语音活动检测和语音转文字技术,实现实时字幕功能,未来可实现同声传译。

🎯

关键要点

- AI技术可以为WebRTC视频会议实时生成字幕,提升会议体验。

- 实时字幕功能通过音频流处理、语音活动检测和语音转文字技术实现。

- 未来可能实现同声传译功能。

- WebRTC视频会议需要实时字幕的场景包括跨国英文会议、重要会议纪要和高端技术面试。

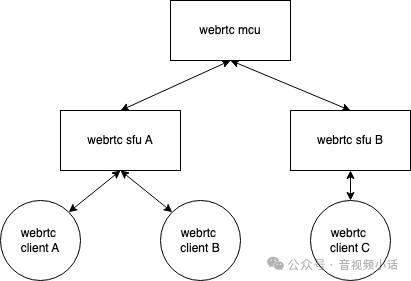

- WebRTC视频会议系统包括客户端、SFU服务器和MCU服务器。

- 实现AI实时语音字幕的关键步骤包括拉取音频流、音频解码、语音有效检测、生成音频文件和语音转文字。

- 推荐使用cpp_streamer开源实现WebRTC拉流。

- 音频解码可使用FFmpeg的API。

- VAD模块可使用libwebrtc和FFTW库进行语音检测。

- ASR技术可使用OpenAI的Whisper和FireRedASR进行语音转文字。

- 后续将有博文详细介绍VAD和ASR的实现。

❓

延伸问答

如何利用AI技术为WebRTC视频会议生成实时字幕?

通过音频流处理、语音活动检测和语音转文字技术,AI可以实时生成字幕。

WebRTC视频会议中需要实时字幕的场景有哪些?

包括跨国英文会议、重要会议纪要和高端技术面试等场景。

实现AI实时语音字幕的关键步骤是什么?

关键步骤包括拉取音频流、音频解码、语音有效检测、生成音频文件和语音转文字。

WebRTC视频会议系统的组成部分有哪些?

包括WebRTC客户端、SFU服务器和MCU服务器。

推荐使用哪些工具进行音频解码和语音转文字?

音频解码可使用FFmpeg的API,语音转文字可使用OpenAI的Whisper和FireRedASR。

未来WebRTC视频会议可能实现哪些功能?

未来可能实现同声传译功能。

➡️