内容提要

音频生成技术正向端到端生成演进。美团LongCat团队推出LongCat-AudioDiT,直接在波形潜空间进行文本转语音,避免信息损失。该模型在Seed基准测试中表现优异,取得了SOTA的说话人相似度和可懂度,展现出强大的零样本语音克隆能力。

关键要点

-

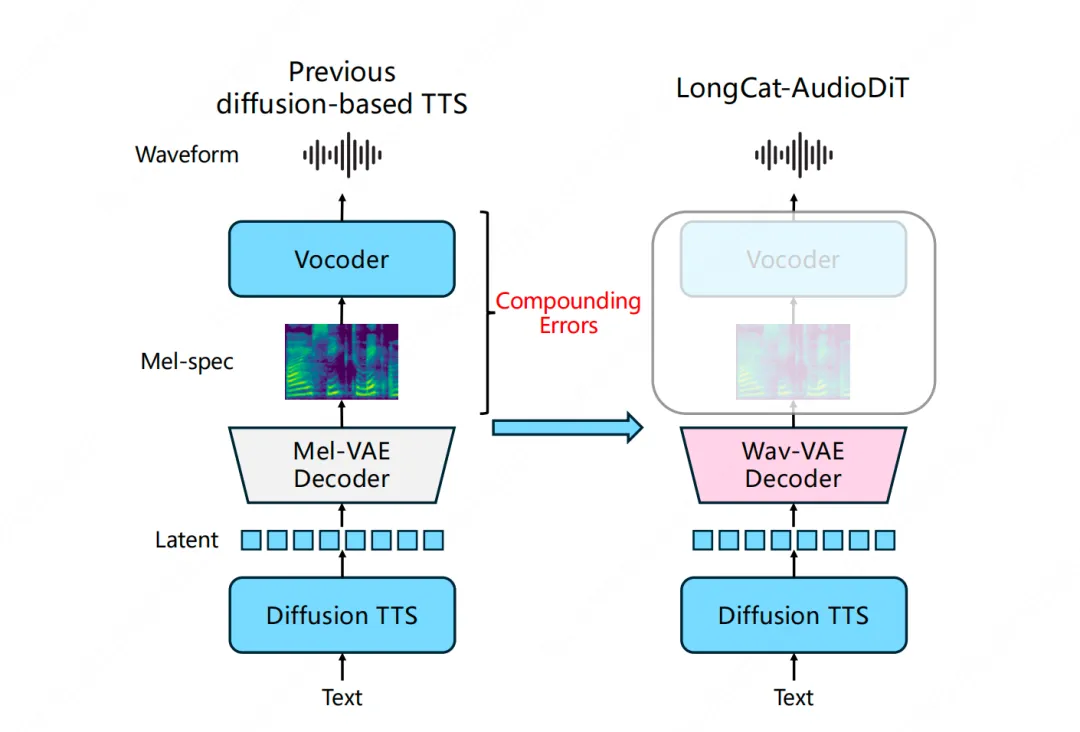

音频生成技术正在向端到端生成范式演进,避免信息损失。

-

美团LongCat团队推出LongCat-AudioDiT,直接在波形潜空间进行文本转语音。

-

LongCat-AudioDiT在Seed基准测试中表现优异,取得SOTA的说话人相似度和可懂度。

-

模型抛弃梅尔谱等中间表示,减少数据转换的级联误差。

-

Wav-VAE作为压缩器,压缩比超过2000倍,保持音频质量。

-

扩散Transformer在隐空间中学习文本到声音的映射,提升生成语音的可懂度。

-

双重约束对齐修复训练-推理不匹配问题,确保生成语音的稳定性。

-

自适应投影引导缓解CFG过饱和问题,提升生成语音的自然度。

-

VAE重建质量与语音生成效果并不成正比,需优化潜空间维度。

-

LongCat-AudioDiT在零样本语音克隆任务中展现出强大的竞争力。

延伸问答

LongCat-AudioDiT模型的主要创新是什么?

LongCat-AudioDiT模型的主要创新在于直接在波形潜空间进行文本转语音,避免了传统方法中的信息损失和误差累积。

LongCat-AudioDiT在Seed基准测试中的表现如何?

LongCat-AudioDiT在Seed基准测试中取得了SOTA的说话人相似度和可懂度,表现优异。

Wav-VAE在LongCat-AudioDiT中起什么作用?

Wav-VAE作为压缩器,将原始波形压缩为紧凑的隐向量,保持音频质量并提高训练稳定性。

自适应投影引导(APG)如何改善生成语音的质量?

APG通过精准筛选引导信号,保留有益部分并抑制劣化部分,从而提升生成语音的自然度和音质。

LongCat-AudioDiT如何解决训练-推理不匹配问题?

LongCat-AudioDiT通过双重约束对齐机制,确保提示区域的隐变量与训练分布对齐,从而修复了训练-推理不匹配问题。

LongCat-AudioDiT的零样本语音克隆能力如何?

LongCat-AudioDiT在零样本语音克隆任务中展现出强大的竞争力,取得了高说话人相似度和可懂度。