内容提要

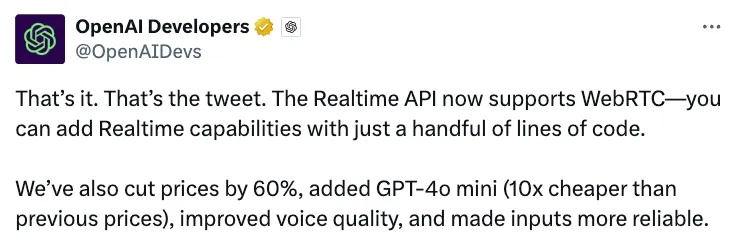

OpenAI RealTime 模型新增 WebRTC 接口,支持实时音频传输。用户可通过 HTTP/WebRTC 信令直接向 OpenAI 服务器发送音频数据,连接使用 UDP,音频采用 Opus 编解码器。尽管功能良好,但仍需优化带宽和音频质量,整体上 WebRTC 提供灵活的实时交互体验。

关键要点

-

OpenAI RealTime 模型新增 WebRTC 接口,支持实时音频传输。

-

用户可以通过 HTTP/WebRTC 信令直接向 OpenAI 服务器发送音频数据,连接使用 UDP。

-

音频采用 Opus 编解码器,每秒传输 50 个数据包。

-

信令建立连接有两种选择:WebSocket 信令和 HTTP/WebRTC 信令。

-

HTTP/WebRTC 信令适合真实网络,但 API 较丑陋,包含 SDP offer/answer。

-

连接仅使用 UDP 建立,缺乏 TURN 服务器或 ICE-TCP/SSLTCP 候选。

-

音频传输未启用不连续传输,可能导致带宽占用较高。

-

音频可靠性方面,opus inbandfec 是唯一的新增功能,没有重传机制。

-

数据通道提供灵活性,能够接收来自服务器的事件。

-

尽管功能良好,但仍需优化带宽和音频质量,WebRTC 提供灵活的实时交互体验。

延伸问答

OpenAI WebRTC API 的主要功能是什么?

OpenAI WebRTC API 支持实时音频传输,用户可以通过 HTTP/WebRTC 信令直接向 OpenAI 服务器发送音频数据。

如何建立与 OpenAI 服务器的 WebRTC 连接?

可以通过 HTTP/WebRTC 信令或 WebSocket 信令建立连接,HTTP/WebRTC 信令适合真实网络。

OpenAI WebRTC API 使用了哪种音频编解码器?

OpenAI WebRTC API 使用 Opus 编解码器进行音频传输。

OpenAI WebRTC API 在音频传输方面有哪些优化需求?

API 需要优化带宽和音频质量,当前音频传输未启用不连续传输,可能导致带宽占用较高。

OpenAI WebRTC API 的音频传输速率是多少?

音频传输速率为每秒 50 个数据包。

OpenAI WebRTC API 的数据通道有什么特点?

数据通道提供灵活性,能够接收来自服务器的事件,支持动态控制。