💡

原文英文,约800词,阅读约需3分钟。

📝

内容提要

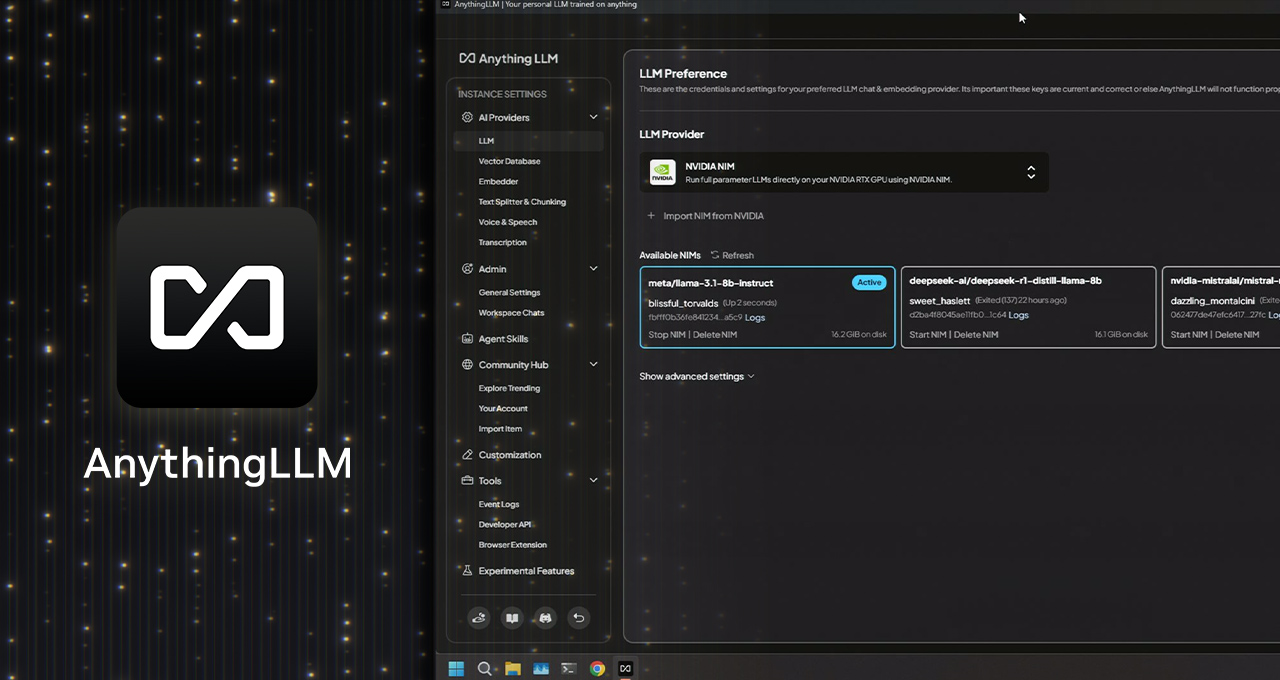

NVIDIA NIM微服务与RTX GPU支持AnythingLLM应用,加速本地大型语言模型(LLM)工作流程。AnythingLLM集成AI应用,支持本地LLM和检索增强生成(RAG)系统,提供高效问答、文档摘要和数据分析功能。NVIDIA NIM使用户能够快速测试生成AI模型,简化工作流程。

🎯

关键要点

- NVIDIA NIM微服务和RTX GPU加速AnythingLLM应用,使本地大型语言模型(LLM)工作流程更高效。

- AnythingLLM是一个集成AI应用,支持本地LLM和检索增强生成(RAG)系统,提供问答、文档摘要和数据分析功能。

- AnythingLLM可以连接多种开源本地LLM和云端大型LLM,包括OpenAI、Microsoft和Anthropic提供的模型。

- GeForce RTX和NVIDIA RTX PRO GPU为AnythingLLM提供显著性能提升,使用Tensor Cores加速AI推理。

- AnythingLLM最近增加了对NVIDIA NIM微服务的支持,简化了AI工作流程的启动过程。

- NVIDIA NIM为开发者提供了快速测试生成AI模型的方式,支持本地和云端运行。

- 每周的RTX AI Garage博客系列展示社区驱动的AI创新,帮助用户了解NIM微服务和AI蓝图。

❓

延伸问答

AnythingLLM是什么?

AnythingLLM是一个集成AI应用,允许用户在本地运行大型语言模型(LLM)和检索增强生成(RAG)系统。

NVIDIA NIM微服务如何提升AnythingLLM的性能?

NVIDIA NIM微服务提供性能优化的生成AI模型,使用户能够更快速地启动AI工作流程,简化了模型的测试和连接过程。

使用AnythingLLM可以实现哪些功能?

AnythingLLM支持问答、文档摘要、数据分析和动态研究等多种功能,帮助用户高效利用LLM。

GeForce RTX和NVIDIA RTX PRO GPU对AnythingLLM的影响是什么?

GeForce RTX和NVIDIA RTX PRO GPU通过加速推理过程,显著提升了AnythingLLM的性能,尤其是在运行LLM时。

AnythingLLM如何连接到开源LLM和云端LLM?

AnythingLLM可以连接多种开源本地LLM和云端大型LLM,包括OpenAI、Microsoft和Anthropic提供的模型。

如何使用NVIDIA NIM微服务进行AI模型测试?

用户可以通过NVIDIA NIM微服务快速测试生成AI模型,使用单一容器简化模型的下载和连接过程。

➡️