💡

原文英文,约1400词,阅读约需5分钟。

📝

内容提要

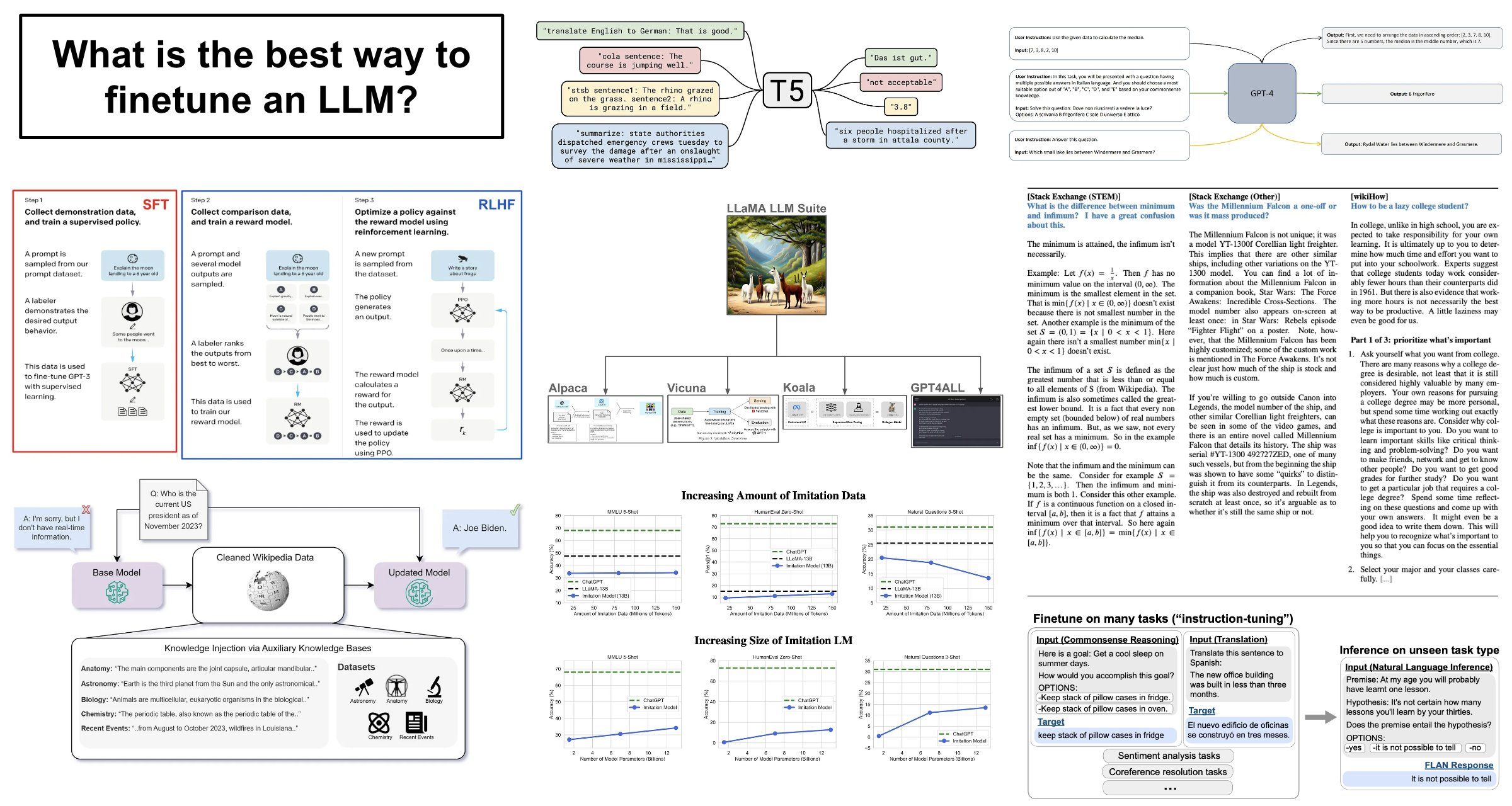

语言模型的微调技术包括继续预训练、指令微调和监督微调,主要目标是知识注入和对齐。研究表明,大部分知识来自预训练,而对齐可以通过少量高质量数据实现。微调时需明确目标,以便有效评估结果。

🎯

关键要点

- 微调技术包括继续预训练、指令微调和监督微调,主要目标是知识注入和对齐。

- 大部分知识来自预训练,而对齐可以通过少量高质量数据实现。

- 微调时需明确目标,以便有效评估结果。

- 大规模指令微调可以通过使用大型数据集来提高模型在下游任务中的表现。

- 对齐目标不需要学习新信息,少量高质量数据即可实现。

- 模仿模型的训练虽然可以快速学习风格,但缺乏强大的知识基础。

- 继续预训练和微调的区别仍然模糊,研究仍在继续探索如何有效注入知识。

❓

延伸问答

语言模型微调的主要目标是什么?

语言模型微调的主要目标是知识注入和对齐。

继续预训练和微调有什么区别?

继续预训练是进一步训练模型以获取新知识,而微调则是调整模型的输出风格或格式。

如何有效进行语言模型的对齐?

对齐可以通过少量高质量的数据进行微调,而不需要学习新信息。

大规模指令微调的优势是什么?

大规模指令微调可以提高模型在多种下游任务中的表现,尤其是在处理指令时。

模仿模型的训练有什么局限性?

模仿模型缺乏强大的知识基础,且在更广泛的基准测试中表现不佳。

微调时如何评估结果的有效性?

微调时需明确目标,并设置基准以准确评估是否达成该目标。

➡️