从递归神经网络到变换器

Louis Aeilot's Blog

·

向量嵌入生成器:工作原理及使用方法

Redis Blog

·

超越无限:工具使用解锁状态空间模型中的长度泛化

Apple Machine Learning Research

·

并行轨道变换器:通过减少同步操作实现快速GPU推理

Apple Machine Learning Research

·

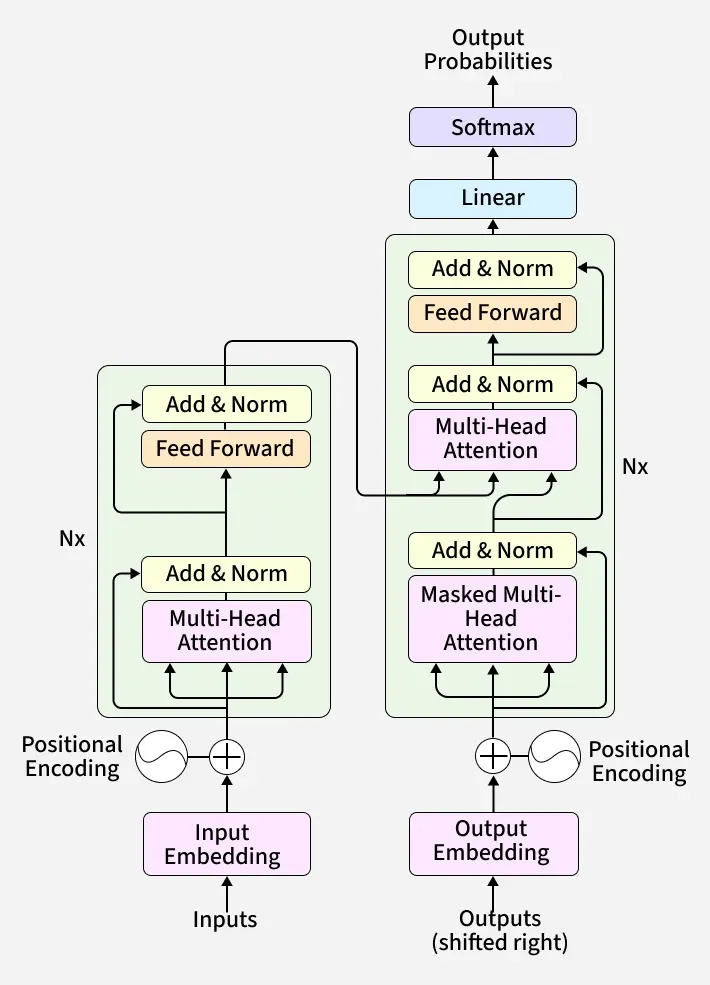

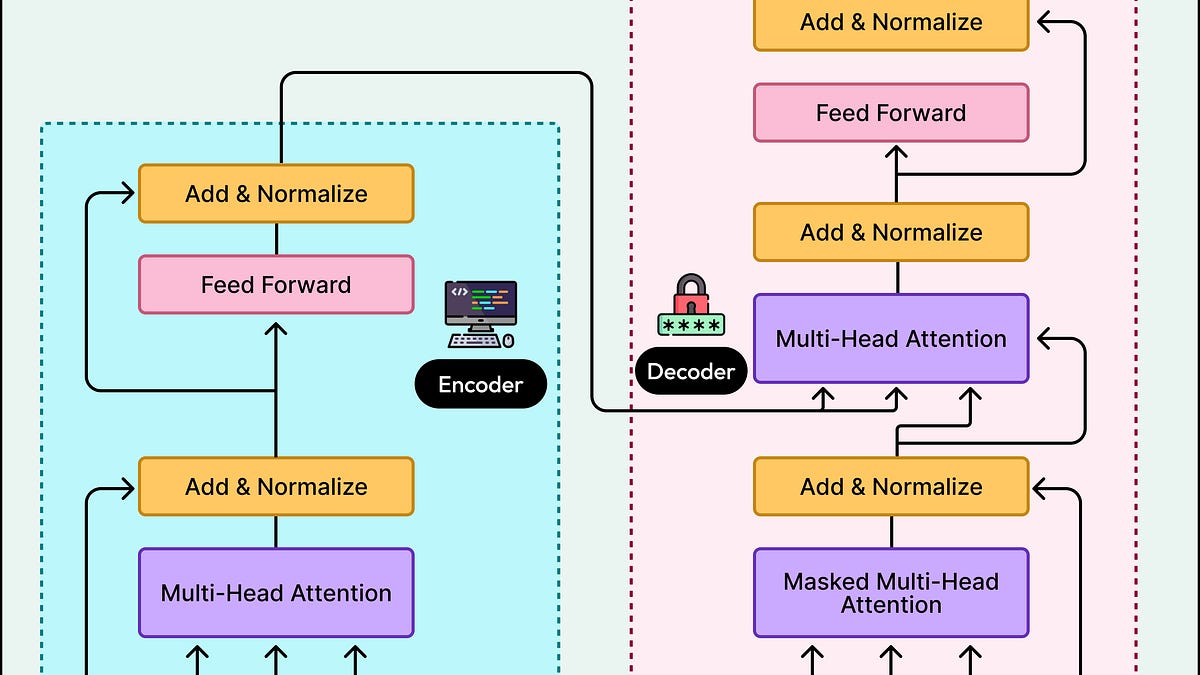

变换器架构如何驱动现代大型语言模型

ByteByteGo Newsletter

·

从零开始构建图像描述生成变换器

Yi's blog

·

变换器的思维方式:驱动语言模型运作的信息流

KDnuggets

·

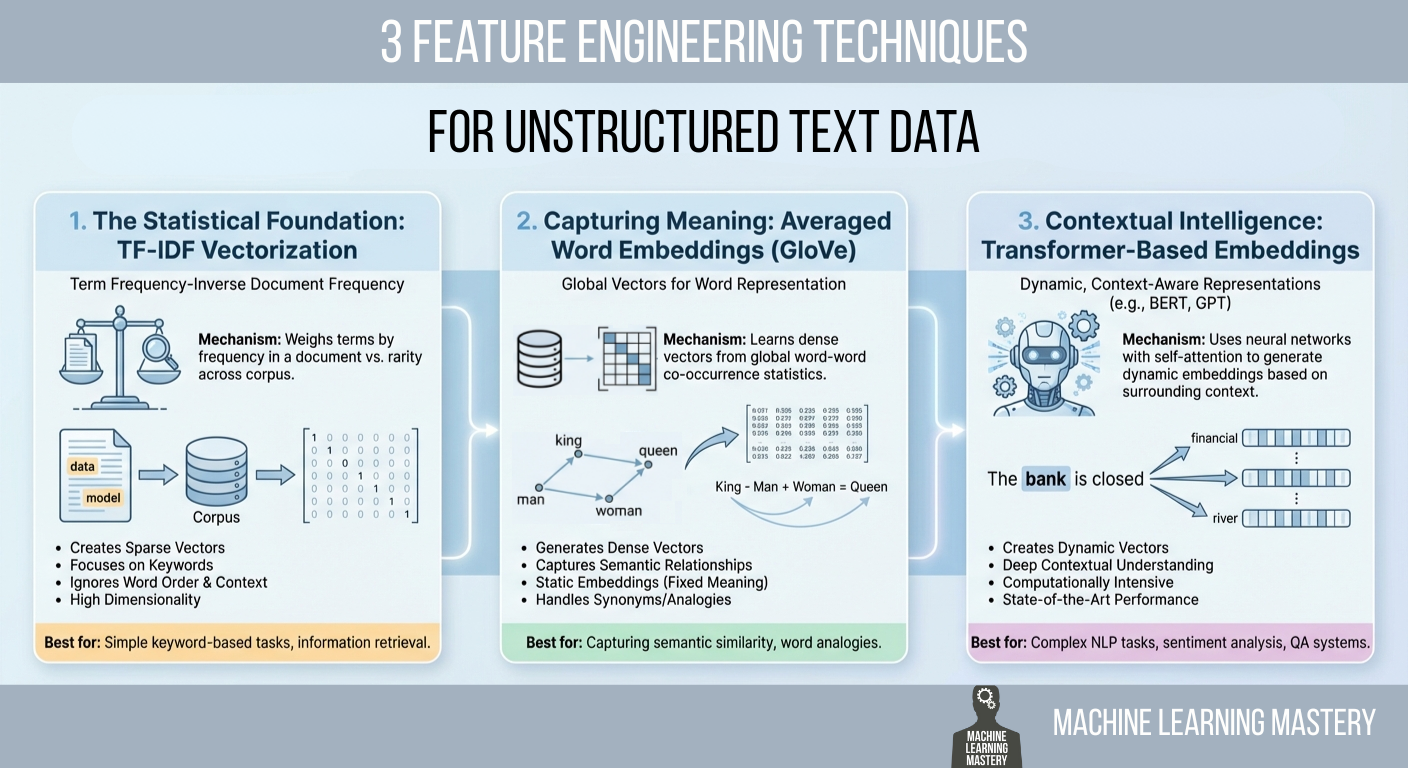

针对非结构化文本数据的三种特征工程技术

MachineLearningMastery.com

·

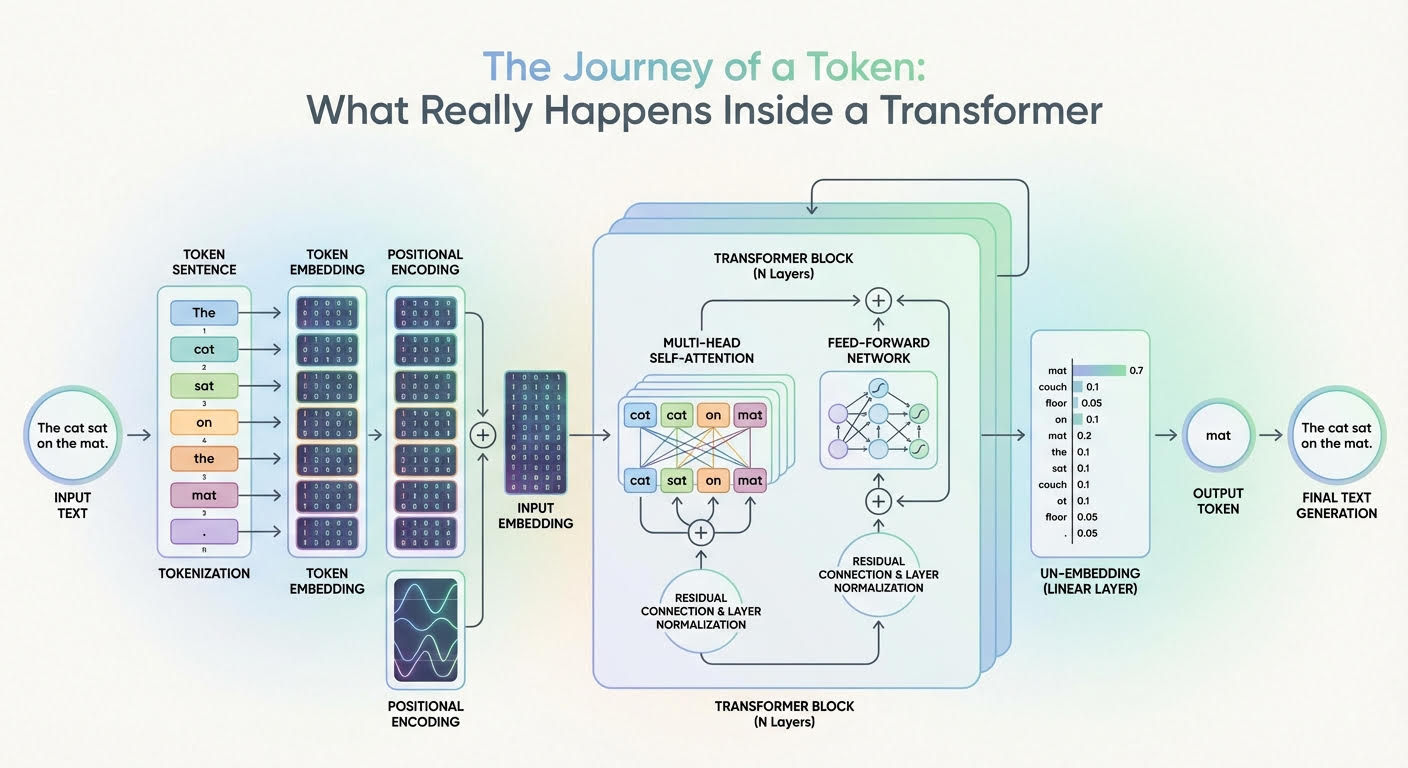

标记的旅程:变换器内部究竟发生了什么

MachineLearningMastery.com

·

BERT模型及其变体

MachineLearningMastery.com

·

基于自编码器变换器模型的软件缺陷预测

Apple Machine Learning Research

·

使用PyTorch从零开始构建变换器模型(10天迷你课程)

MachineLearningMastery.com

·

使用变换器进行实时手势识别

freeCodeCamp.org

·

基于变换器的自回归流在连续空间中的灵活语言建模

Apple Machine Learning Research

·

关于促进扩散变换器泛化能力的归纳偏差

Apple Machine Learning Research

·

具有局部等变变换器的离散神经流采样器

Apple Machine Learning Research

·

如何使用句子变换器进行句子相似性检查

freeCodeCamp.org

·

构建类似于Llama-2和Llama-3的仅解码器变换器模型

MachineLearningMastery.com

·

变换器模型中的跳跃连接

MachineLearningMastery.com

·

变换器模型中的混合专家架构

MachineLearningMastery.com

·