自言自语:让大语言模型告别灾难性遗忘

Micropaper

·

Google Nested Learning:突破AI灾难性遗忘的新范式

Micropaper

·

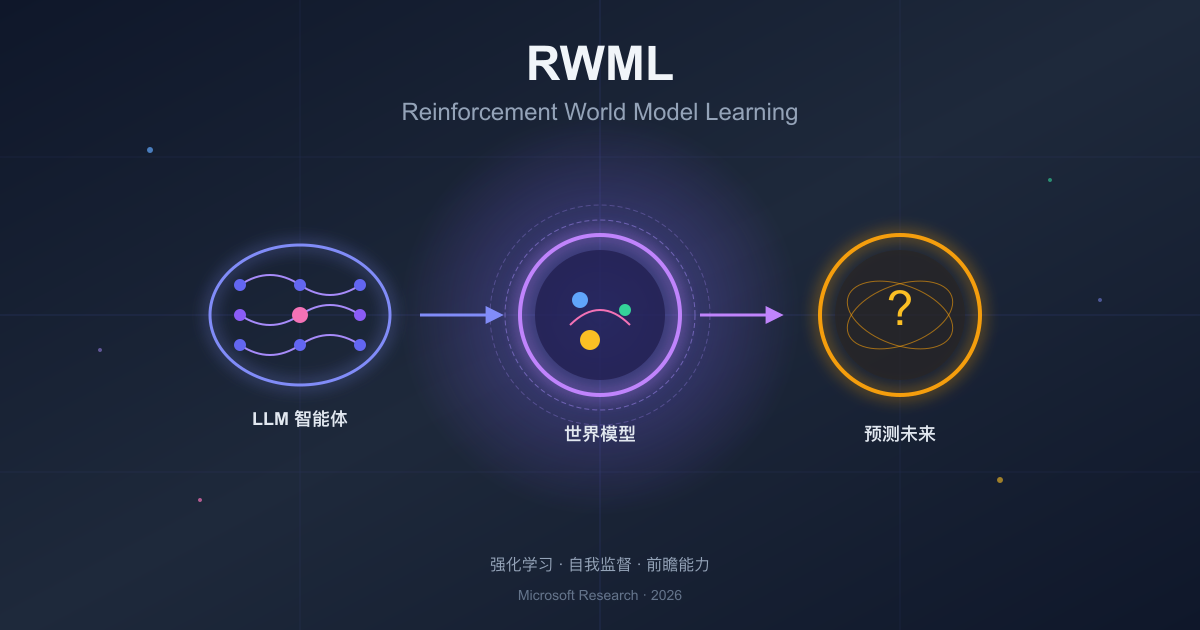

RWML:让 LLM 智能体学会预测未来——微软研究院突破性论文解读

Micropaper

·

微调大型语言模型时遇到的五个问题及解决方案

MachineLearningMastery.com

·