一分钟读论文:《归一化计算下单Agent为何优于多Agent》

Micropaper

·

参数与FLOPs:混合专家语言模型的最佳稀疏性扩展规律

Apple Machine Learning Research

·

基于可解释限制玻尔兹曼机的配置相互作用引导采样

BriefGPT - AI 论文速递

·

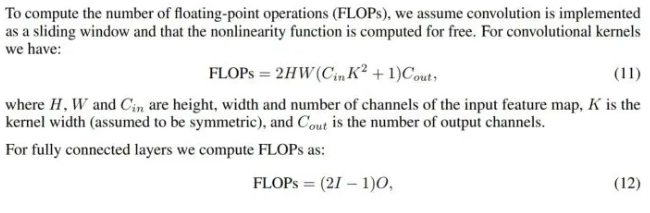

profile a deep learning model

Sekyoro的博客小屋

·

黎曼ζ函数零点密度定理的计算外包讨论

What's new by TerryTao

·