💡

原文英文,约1200词,阅读约需5分钟。

📝

内容提要

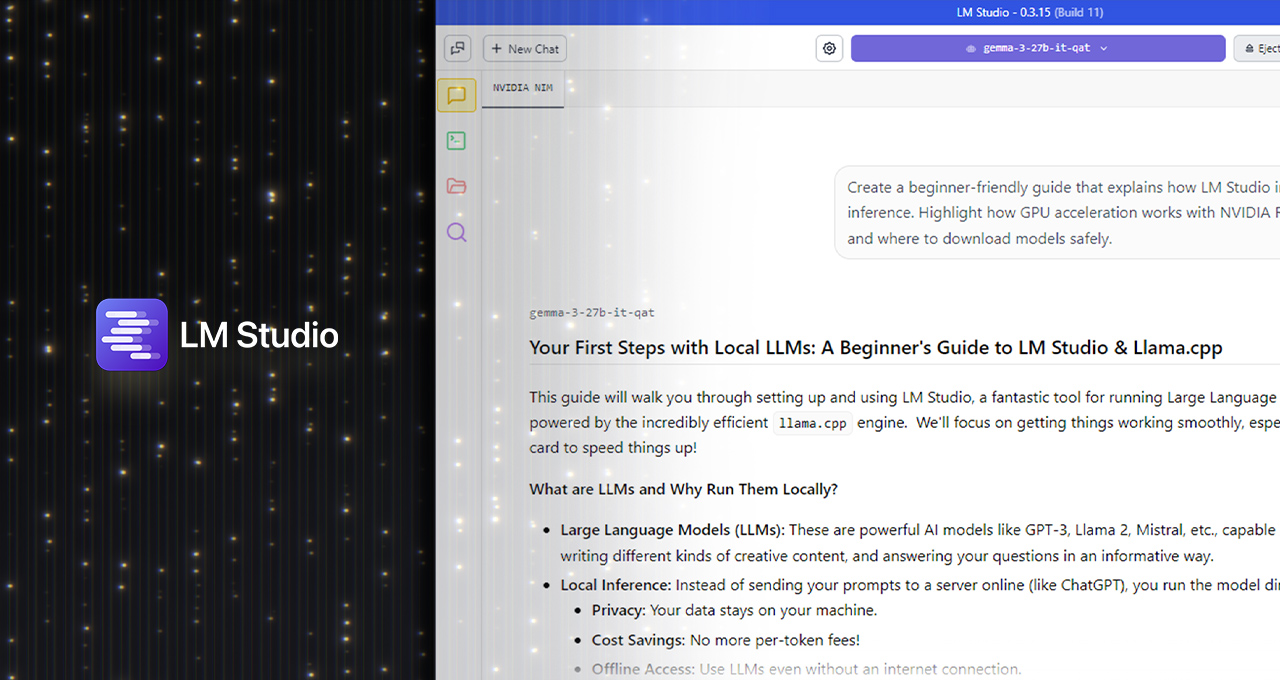

LM Studio 0.3.15更新提升了RTX GPU性能,支持本地运行大型语言模型(LLM)。新增“tool_choice”参数和改进的系统提示编辑器,增强开发者灵活性。该应用适用于文档问答和多轮对话,确保用户快速、私密地进行AI交互。

🎯

关键要点

- LM Studio 0.3.15更新提升了RTX GPU性能,支持本地运行大型语言模型(LLM)。

- 新增“tool_choice”参数和改进的系统提示编辑器,增强开发者灵活性。

- LM Studio适用于文档问答和多轮对话,确保用户快速、私密地进行AI交互。

- LM Studio允许在本地PC上高性能推理,增强数据隐私和AI部署控制。

- 更新后的LM Studio支持多种开放模型和量化格式,适用于多种使用场景。

- CUDA 12.8的集成显著提高了模型加载和响应时间,优化了RTX GPU性能。

- LM Studio的灵活性使其适合于休闲实验或完全集成到自定义工作流程中。

- 新功能包括更细粒度的工具使用控制和升级的系统提示编辑器。

- LM Studio支持多种RTX架构,确保与各种RTX AI PC的兼容性。

- LM Studio是免费软件,支持Windows、macOS和Linux,用户可快速下载和使用。

❓

延伸问答

LM Studio 0.3.15更新了哪些主要功能?

LM Studio 0.3.15更新提升了RTX GPU性能,新增了“tool_choice”参数和改进的系统提示编辑器,增强了开发者的灵活性。

LM Studio如何提高数据隐私?

LM Studio允许在本地PC上高性能推理,确保用户的数据隐私和对AI部署的完全控制。

CUDA 12.8对LM Studio的性能有什么影响?

CUDA 12.8的集成显著提高了模型加载和响应时间,优化了RTX GPU性能,提升了整体推理速度。

LM Studio适合哪些使用场景?

LM Studio适用于文档问答、多轮对话、RAG工作流和本地代理管道等多种使用场景。

如何在LM Studio中配置CUDA运行时?

用户可以通过发现菜单选择CUDA 12 llama.cpp运行时进行下载和安装,然后在设置中配置为默认运行时。

LM Studio支持哪些操作系统?

LM Studio是免费软件,支持Windows、macOS和Linux操作系统。

➡️