💡

原文中文,约21300字,阅读约需51分钟。

📝

内容提要

文字生成图片是近年来多模态研究的热门领域,主要依赖大模型实现。NovelAI等二次元模型利用稳定扩散算法生成高质量图像,用户需提供专业的描述词。扩散模型和超网络等技术不断进步,OpenAI的Consistency Models在图像生成方面也取得了进展。CLIP等模型通过对比学习建立文字与图像的联系,推动了文本引导图像生成的应用。

🎯

关键要点

- 文字生成图片是近年来多模态研究的热门领域,主要依赖大模型实现。

- NovelAI等二次元模型利用稳定扩散算法生成高质量图像,用户需提供专业的描述词。

- 扩散模型和超网络等技术不断进步,OpenAI的Consistency Models在图像生成方面也取得了进展。

- CLIP等模型通过对比学习建立文字与图像的联系,推动了文本引导图像生成的应用。

- DDPM模型通过前向和反向过程实现图像生成,逐步去噪声恢复目标信号。

- LDM模型通过隐空间实现高质量图像合成,并引入自注意力机制提高生成效率。

- GLIDE和DALLE2等模型通过结合CLIP实现文本引导的图像生成。

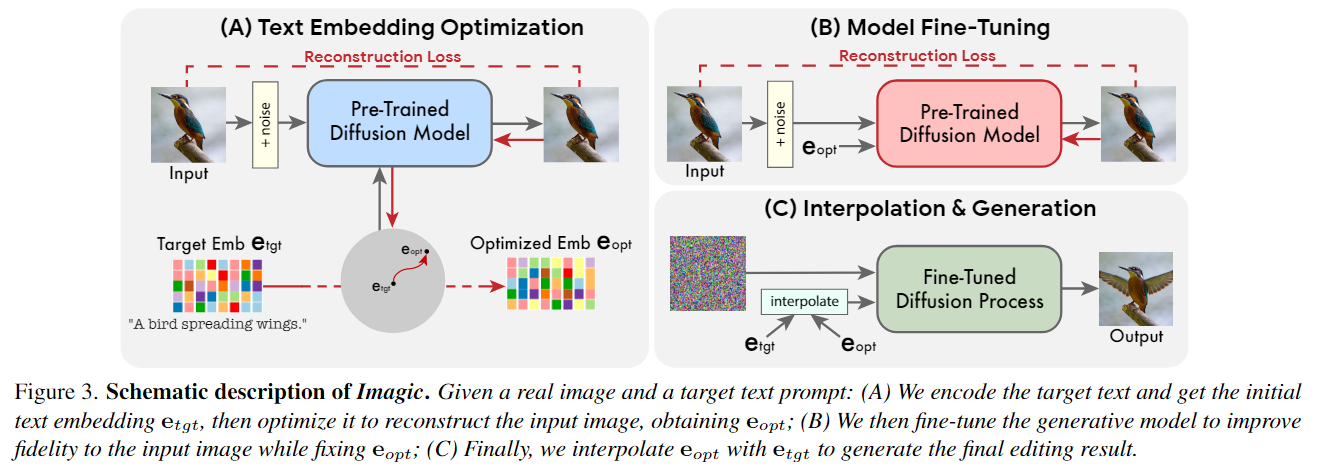

- DreamBooth和ControlNet等方法提供了图像编辑和微调的能力,增强了生成模型的灵活性和适应性。

❓

延伸问答

文字生成图片的主要技术是什么?

文字生成图片主要依赖于大模型和扩散模型等技术,如NovelAI和OpenAI的Consistency Models。

如何使用描述词生成高质量图像?

用户需要提供专业的描述词,模型如NovelAI会利用稳定扩散算法生成高质量图像。

CLIP模型在文字生成图片中起什么作用?

CLIP模型通过对比学习建立文字与图像的联系,推动文本引导图像生成的应用。

扩散模型的工作原理是什么?

扩散模型通过前向和反向过程逐步去噪声,恢复目标信号,从而实现图像生成。

DreamBooth和ControlNet有什么应用?

DreamBooth用于通过少量图片微调模型,ControlNet则提供图像编辑和微调能力,增强生成模型的灵活性。

LDM模型如何提高图像生成效率?

LDM模型通过隐空间实现高质量图像合成,并引入自注意力机制来提高生成效率。

➡️