内容提要

NVIDIA DGX Spark与Dify结合,支持企业在本地安全运行AI代理,集成完整的NVIDIA AI平台,支持多种开源模型,企业可无代码构建AI应用,确保合规。

关键要点

-

NVIDIA DGX Spark与Dify结合,支持企业在本地安全运行AI代理。

-

集成完整的NVIDIA AI平台,包括GPU、CPU、网络和CUDA库。

-

DGX Spark采用NVIDIA GB10 Grace Blackwell超级芯片,支持多种开源模型的本地推理。

-

Dify平台提供可视化工作流编排、知识管道集成和多模型管理。

-

企业可以无代码构建AI应用,确保数据输入、模型推理和应用输出在本地环境中进行。

-

DGX Spark为AI开发者和中小企业提供可访问的本地计算选项,消除对云基础设施的需求。

-

架构分为硬件层、推理层、应用层和业务层,形成闭环。

-

实施步骤包括环境准备、在DGX Spark上部署Dify、部署本地模型和推理引擎。

-

支持多种主流模型,如Llama 3.1 FP4和GPT-OSS 20B。

-

Dify提供零代码开发,快速构建AI应用,支持多种应用场景。

-

应用发布后可直接上线,确保数据安全和合规性。

-

DGX Spark支持模型微调,用户可根据特定任务调整开源大模型。

-

本地推理加速FP4/FP8,支持200B参数级模型,确保敏感数据在企业内部处理。

延伸问答

NVIDIA DGX Spark与Dify的结合有什么优势?

NVIDIA DGX Spark与Dify结合,支持企业在本地安全运行AI代理,确保数据安全和合规,同时提供无代码构建AI应用的能力。

如何在DGX Spark上部署Dify?

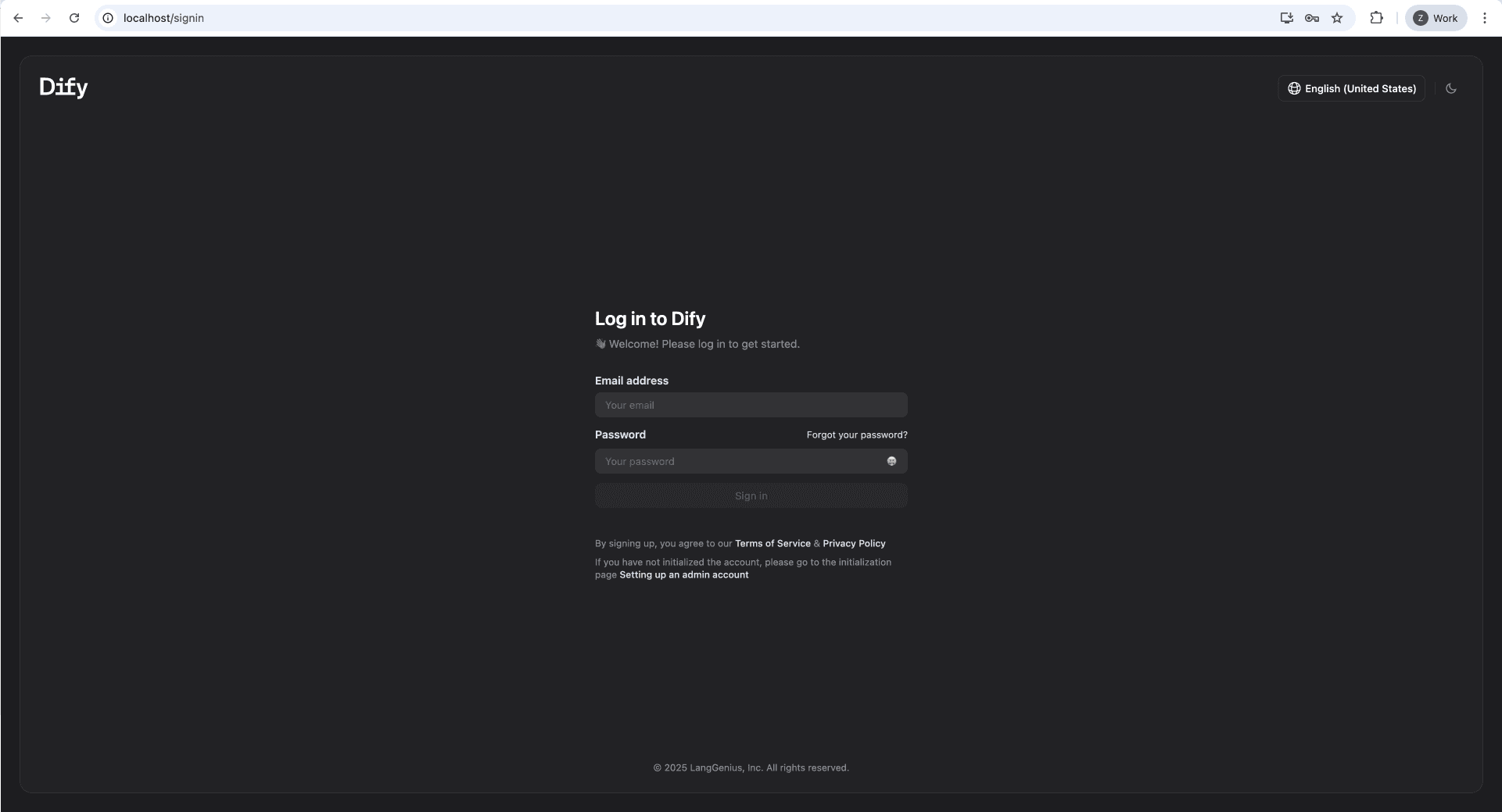

在DGX Spark上部署Dify的步骤包括环境准备、克隆Dify代码、运行Docker容器等,具体可参考官方文档。

DGX Spark支持哪些开源模型?

DGX Spark支持多种开源模型,包括Llama 3.1 FP4、GPT-OSS 20B和Qwen 2.5等。

企业如何确保AI应用的合规性?

企业通过在本地环境中进行数据输入、模型推理和应用输出,确保AI应用的合规性和数据安全。

DGX Spark的硬件规格是什么?

DGX Spark配备GB10 Grace Blackwell超级芯片、20核Arm CPU、128GB统一内存,支持高达1 PFLOP的FP4 AI计算。

Dify平台提供哪些功能?

Dify平台提供可视化工作流编排、知识管道集成和多模型管理,支持零代码开发AI应用。