内容提要

本文介绍了在TileLang中实现Flash Attention的前向传播,强调其内核设计、内存分配和计算过程。TileLang的性能比FlashAttention-2快1.3倍,达到630 TFLOPS/s,主要通过优化内存访问和计算并行性来提升性能。

关键要点

-

本文介绍了在TileLang中实现Flash Attention的前向传播,重点关注内核设计和计算过程。

-

TileLang的性能比FlashAttention-2快1.3倍,达到630 TFLOPS/s,主要通过优化内存访问和计算并行性来提升性能。

-

TileLang使用高效的内存分配策略,将数据从高延迟的HBM转移到快速的SRAM中,以提高计算速度。

-

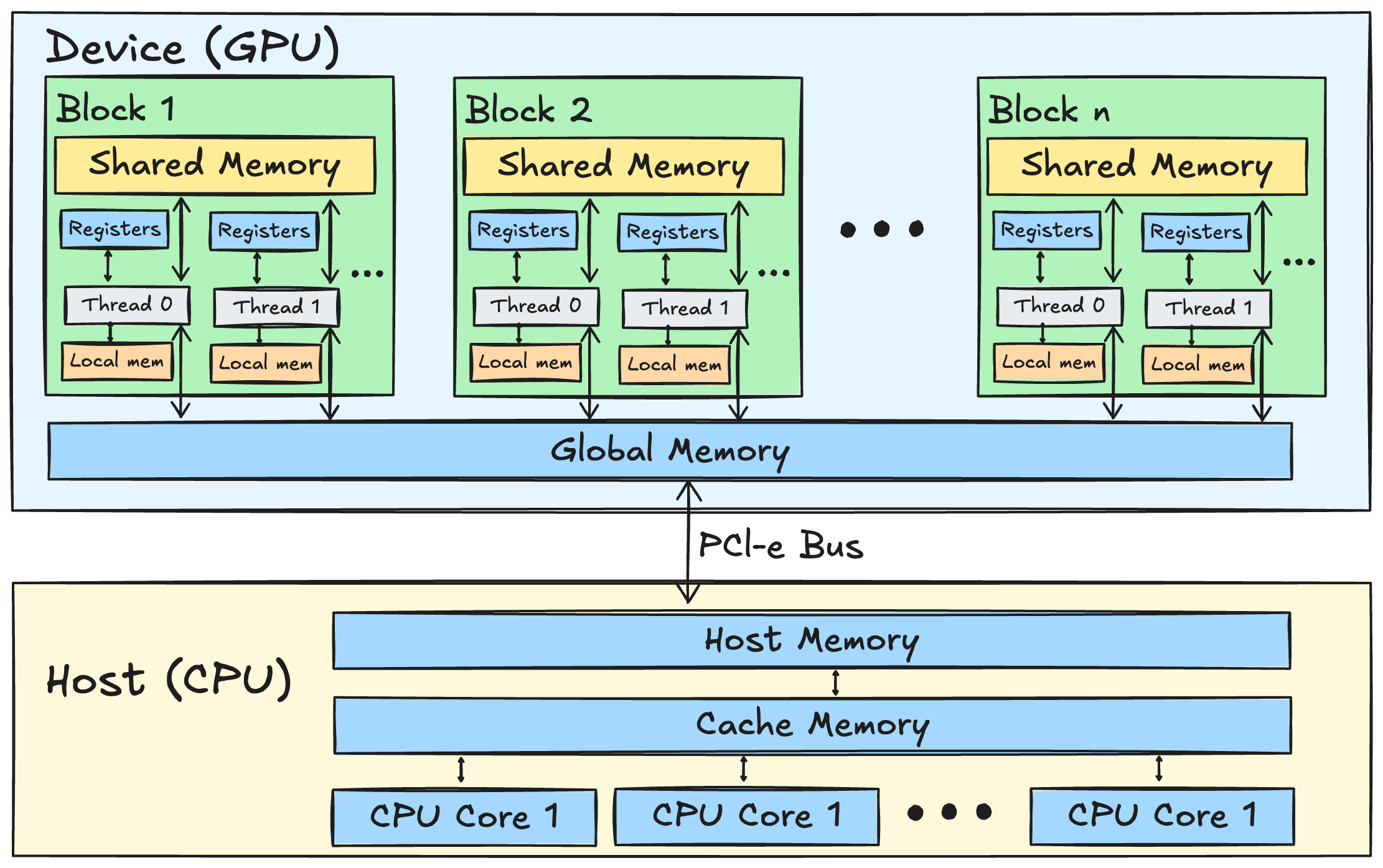

内核设计采用了GPU的层次结构,利用共享内存和寄存器来减少延迟,确保计算单元的高效利用。

-

通过软件流水线技术,TileLang能够隐藏内存访问的延迟,从而提高整体性能。

-

TileLang的实现使用了bfloat16和float混合精度,以最大化算术吞吐量,确保与硬件指令的最佳匹配。

延伸问答

TileLang的Flash Attention实现有什么优势?

TileLang的Flash Attention实现比FlashAttention-2快1.3倍,达到630 TFLOPS/s,主要通过优化内存访问和计算并行性来提升性能。

TileLang如何优化内存访问?

TileLang使用高效的内存分配策略,将数据从高延迟的HBM转移到快速的SRAM中,以提高计算速度。

TileLang的内核设计是怎样的?

TileLang的内核设计采用了GPU的层次结构,利用共享内存和寄存器来减少延迟,确保计算单元的高效利用。

TileLang如何提高计算吞吐量?

TileLang通过使用bfloat16和float混合精度,以最大化算术吞吐量,确保与硬件指令的最佳匹配。

TileLang的实现中使用了哪些技术来隐藏内存延迟?

TileLang通过软件流水线技术,能够隐藏内存访问的延迟,从而提高整体性能。

TileLang的性能测试结果如何?

TileLang在性能测试中显示出比Flash Attention 2更快的速度,具体表现为在相同问题规模下的更低延迟和更高TFLOPS。