💡

原文中文,约3400字,阅读约需8分钟。

📝

内容提要

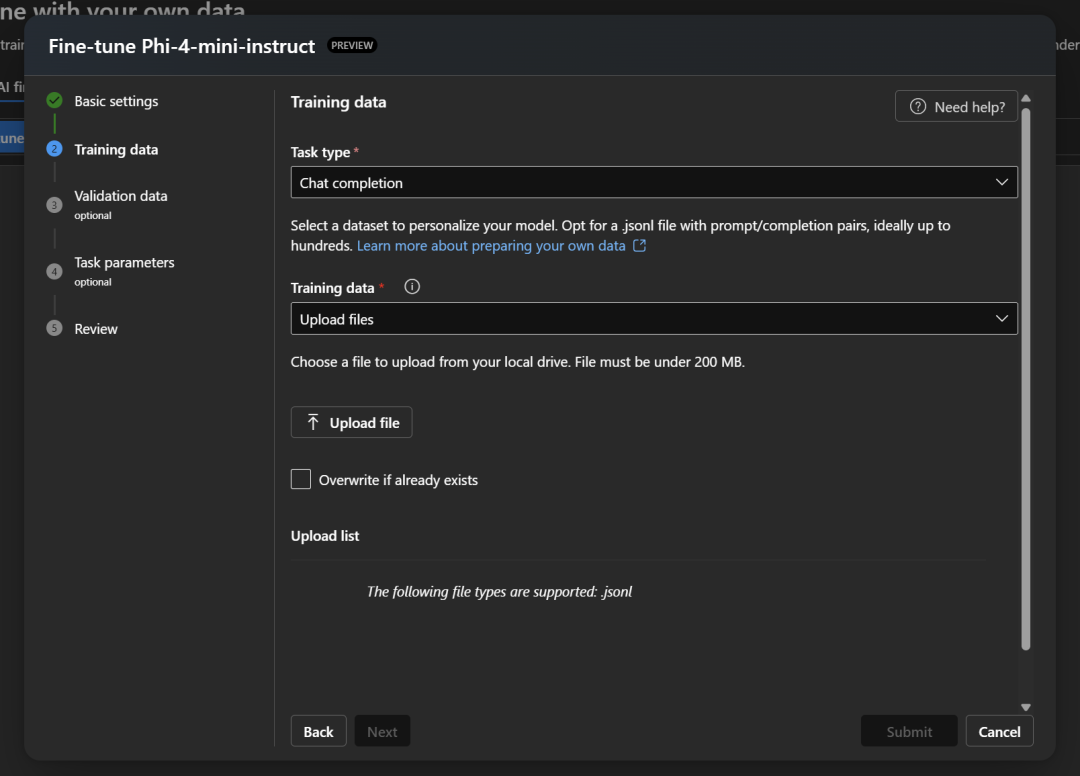

在工作中遇到RAG技术召回率不足的问题,导致LLM理解偏差。考虑通过微调小模型来处理特定领域问题,以固化知识和统一输出格式。使用AI Foundry进行微调,上传训练数据并调整参数,经过训练后模型能回答特定问题,但仍需多轮调整以优化效果。

🎯

关键要点

- 在工作中遇到RAG技术召回率不足的问题,导致LLM理解偏差。

- 考虑通过微调小模型来处理特定领域问题,以固化知识和统一输出格式。

- 微调是基于已训练好的模型,使用小规模、高质量数据继续训练。

- 微调的目标包括固化专有知识、统一输出格式、提升特定任务表现。

- 适用微调的场景包括领域知识长期有效和需要高一致性的输出格式。

- 不适用微调的场景包括知识更新快和样本太少。

- 微调与RAG的机制、适用场景和成本对比。

- 使用AI Foundry进行微调,创建项目并选择合适的模型进行微调。

- 上传训练数据并调整参数,训练后模型能回答特定问题。

- 微调是个循序渐进的过程,需要多轮调整才能达到理想效果。

❓

延伸问答

微调模型的主要目标是什么?

微调模型的主要目标是固化专有知识、统一输出格式和提升特定任务表现。

什么情况下不适合进行模型微调?

不适合微调的情况包括知识更新快和样本太少(少于20-30个)。

如何使用AI Foundry进行模型微调?

在AI Foundry中创建项目,选择合适的模型,上传训练数据并调整参数后进行训练。

微调与RAG技术有什么区别?

微调是修改模型参数以固化知识,而RAG是通过检索外部文本来增强模型的能力。

微调模型的训练过程需要多长时间?

微调模型的训练过程大约需要45分钟。

微调后模型的输出格式有什么要求?

微调后模型的输出格式应统一,如结构化JSON或特定报告模板。

➡️