💡

原文中文,约2600字,阅读约需7分钟。

📝

内容提要

阿里推出的FunAudio-ASR语音识别大模型解决了“幻觉”和“串语种”等问题,通过Context增强模块提升了识别准确率,尤其在高噪声环境和专业术语识别方面表现优异,适用于多种企业场景。

🎯

关键要点

- 阿里推出的FunAudio-ASR语音识别大模型旨在解决语音识别中的“幻觉”和“串语种”等问题。

- 该模型通过Context增强模块提升识别准确率,尤其在高噪声环境和专业术语识别方面表现优异。

- 当前语音大模型的主流架构存在幻觉、串语种、重复解码等问题,影响用户体验。

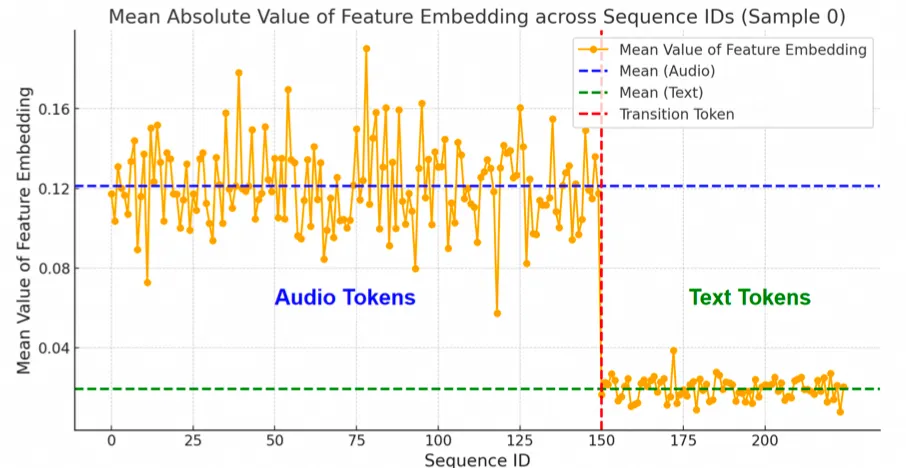

- Context增强模块通过CTC解码器生成初步转写文本,提供上下文信息以减少幻觉现象。

- 在高噪声场景中,幻觉问题更为突出,FunAudio-ASR通过训练数据优化将幻觉率降低至10.7%。

- “串语种”问题表现为输入英文音频却输出中文文本,FunAudio-ASR通过CTC解码器降低此类错误发生率。

- FunAudio-ASR在多种挑战性场景下的识别性能优于行业典型模型,适合资源敏感的部署环境。

- 定制化能力在ASR的工业落地中至关重要,FunAudio-ASR通过RAG机制提升定制化识别效果。

- FunAudio-ASR已在多个企业场景中应用,验证了其在复杂环境下的稳定性和高精度识别能力。

❓

延伸问答

FunAudio-ASR的主要功能是什么?

FunAudio-ASR主要用于解决语音识别中的“幻觉”和“串语种”等问题,提升识别准确率。

Context增强模块如何改善语音识别的准确性?

Context增强模块通过CTC解码器生成初步转写文本,提供上下文信息,减少幻觉现象。

在高噪声环境中,FunAudio-ASR的表现如何?

FunAudio-ASR在高噪声环境中表现优异,幻觉率从78.5%降低至10.7%。

什么是“串语种”问题,FunAudio-ASR如何解决?

“串语种”问题是指输入英文音频却输出中文文本,FunAudio-ASR通过CTC解码器降低此类错误发生率。

FunAudio-ASR的定制化能力如何提升?

FunAudio-ASR通过RAG机制构建知识库,动态检索相关词汇,精准注入LLM的Prompt中,提升定制化识别效果。

FunAudio-ASR适用于哪些企业场景?

FunAudio-ASR已在钉钉的“AI听记”、视频会议等多个场景中应用,验证了其在复杂环境下的稳定性和高精度识别能力。

➡️