内容提要

本文探讨了Transformer模型在序列建模中的重要性,解决了RNN和CNN在并行计算及长距离依赖方面的局限。通过多头注意力机制和位置编码,Transformer显著提升了语言建模和机器翻译的效果。

关键要点

-

Transformer模型旨在解决序列建模问题,主要应用于语言建模和机器翻译。

-

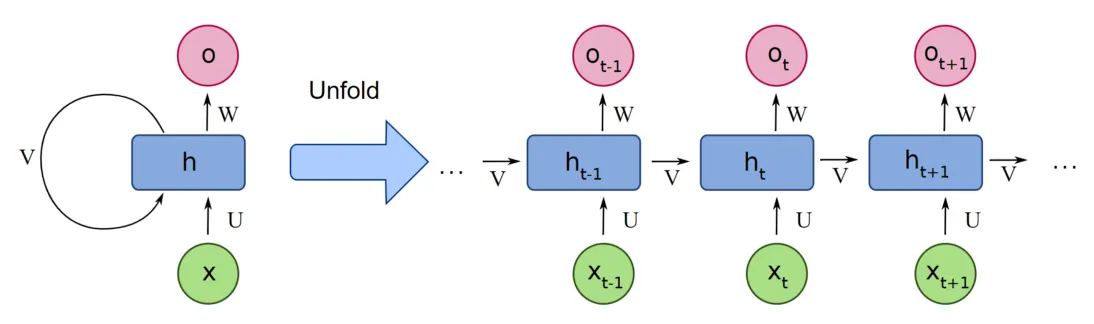

传统的RNN和CNN在并行计算和长距离依赖方面存在局限性。

-

序列建模可以用于预测下一个元素、判断序列合法性和序列转换。

-

RNN的主要问题是无法并行计算和长路径信息稀释。

-

CNN在序列建模中存在单层卷积视野有限和无法捕捉绝对位置信息的问题。

-

Transformer通过多头注意力机制和位置编码来解决前序方案的短板。

-

编码器-解码器结构用于处理序列到序列的问题,最初基于RNN。

-

自注意力机制解决了编码器解码器结构中的信息瓶颈问题。

-

Transformer的架构包括编码器和解码器,采用多头注意力和前馈网络。

-

注意力机制通过Q(查询)、K(键)和V(值)来捕捉token间的关系。

-

Transformer使用自注意力和交叉注意力来处理输入和输出序列的依赖关系。

-

位置编码用于提供token的位置信息,以捕捉因果关系。

-

Transformer的多层堆叠通过残差和归一化来提高训练稳定性。

延伸问答

Transformer模型的主要应用是什么?

Transformer模型主要应用于语言建模和机器翻译。

RNN和CNN在序列建模中存在哪些局限性?

RNN无法进行并行计算且长路径信息稀释,CNN视野有限且无法捕捉绝对位置信息。

Transformer是如何解决长距离依赖问题的?

Transformer通过自注意力机制捕捉序列中token间的关系,从而解决长距离依赖问题。

什么是多头注意力机制,它有什么作用?

多头注意力机制允许模型并行地从不同的子空间抽取特征,提高了模型的表达能力。

位置编码在Transformer中有什么重要性?

位置编码提供了token的位置信息,使得模型能够捕捉因果关系。

Transformer的编码器-解码器结构是如何工作的?

编码器将输入序列编码为上下文向量,解码器利用该向量生成输出序列。