💡

原文中文,约1700字,阅读约需4分钟。

📝

内容提要

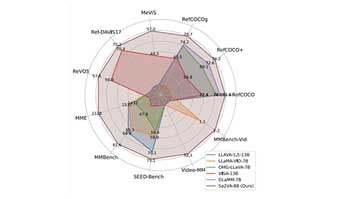

多模态大型语言模型Sa2VA结合视频分割与语言处理,提升图像和视频理解效率。该模型采用创新的解耦设计和特殊标记机制,支持多任务,表现优于以往系统,标志着多模态AI的重大进步。

🎯

关键要点

- 多模态大型语言模型Sa2VA结合视频分割与语言处理,提升图像和视频理解效率。

- Sa2VA采用创新的解耦设计和特殊标记机制,支持多任务。

- 该模型在细粒度视频内容理解方面表现优于以往系统。

- Sa2VA通过最少的一次性指令调整克服现有多模态大型语言模型的局限性。

- 模型集成了SAM-2与LLaVA,统一文本、图像和视频到共享的LLM标记空间中。

- 推出的Ref-SAV数据集包含复杂视频场景中的72K多个对象表达,确保强大的基准测试能力。

- Sa2VA在指涉分割任务上取得最佳结果,优于之前的系统。

- 在对话能力和视频基准测试中,Sa2VA表现出色,显示出其效率和有效性。

- Sa2VA代表了多模态理解的重大进步,解决了感知与语言理解结合的长期挑战。

❓

延伸问答

Sa2VA模型的主要功能是什么?

Sa2VA模型结合视频分割与语言处理,提升图像和视频理解效率。

Sa2VA是如何克服现有多模态大型语言模型的局限性的?

Sa2VA通过最少的一次性指令调整,支持广泛的图像和视频任务,从而克服了现有模型的局限性。

Sa2VA的创新设计有哪些特点?

Sa2VA采用创新的解耦设计和特殊标记机制,支持多任务处理。

Ref-SAV数据集的作用是什么?

Ref-SAV数据集包含复杂视频场景中的72K多个对象表达,确保强大的基准测试能力。

Sa2VA在视频基准测试中的表现如何?

Sa2VA在MeVIS、RefDAVIS17和ReVOS等视频基准测试中表现出色,远超之前的系统。

Sa2VA如何实现文本、图像和视频的统一处理?

Sa2VA通过将SAM-2与LLaVA集成,统一文本、图像和视频到共享的LLM标记空间中。

➡️