💡

原文中文,约3200字,阅读约需8分钟。

📝

内容提要

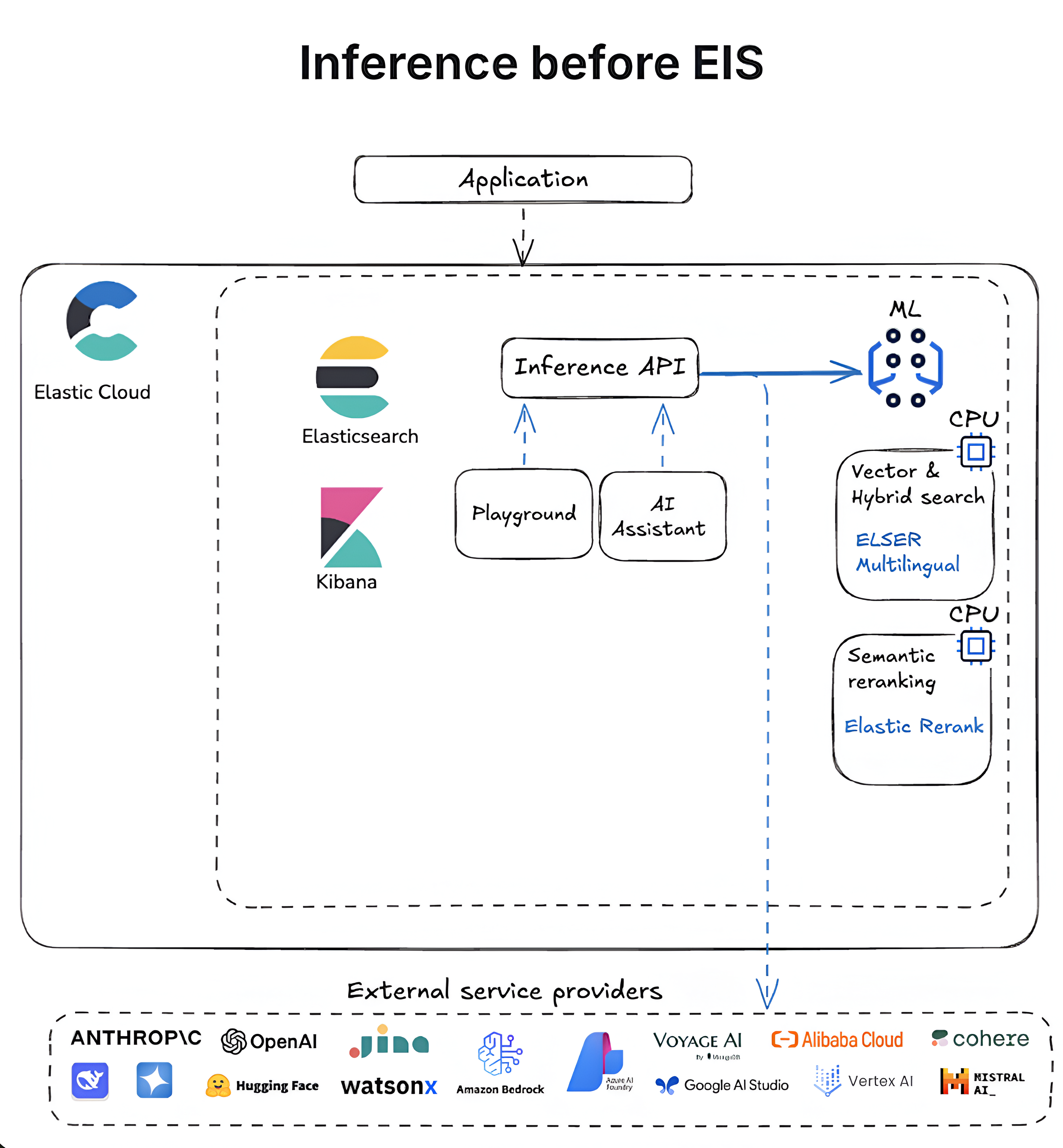

Elastic推出了Elastic Inference Service (EIS),为Elasticsearch提供GPU加速推理功能,支持多种语言模型和语义搜索,提升开发者体验。该服务利用NVIDIA GPU实现低延迟和高吞吐量,降低运营开销,未来将推出更多模型和扩展服务。

🎯

关键要点

-

Elastic推出Elastic Inference Service (EIS),为Elasticsearch提供GPU加速推理功能。

-

EIS支持多种语言模型和语义搜索,旨在提升开发者体验。

-

该服务利用NVIDIA GPU实现低延迟和高吞吐量,降低运营开销。

-

EIS提供对大型语言模型的访问,并支持多云服务提供商和多区域服务。

-

EIS简化了开发者体验,无需下载模型或手动配置,提供易于使用的推理API。

-

未来将推出更多模型,包括多语言嵌入模型和小型语言模型,以满足客户需求。

-

EIS的定价基于使用量,按每个模型每百万令牌收费,确保用户易于上手。

❓

延伸问答

Elastic Inference Service (EIS) 的主要功能是什么?

EIS 为 Elasticsearch 提供 GPU 加速推理功能,支持多种语言模型和语义搜索,旨在提升开发者体验。

EIS 如何降低运营开销?

EIS 利用 NVIDIA GPU 实现低延迟和高吞吐量,简化了开发者体验,无需下载模型或手动配置,从而降低运营开销。

EIS 支持哪些类型的模型?

EIS 支持大型语言模型、小型语言模型以及多语言嵌入模型等,未来还将推出更多模型。

EIS 的定价模式是怎样的?

EIS 提供基于使用量的定价,按每个模型每百万令牌收费,确保用户易于上手。

EIS 如何提升开发者体验?

EIS 提供易于使用的推理 API,简化了设置和工作流管理,开发者无需进行复杂的配置。

EIS 未来有哪些计划?

EIS 计划推出更多模型,包括多语言嵌入模型和小型语言模型,并扩大覆盖的云服务提供商和地区。

➡️