💡

原文英文,约1600词,阅读约需6分钟。

📝

内容提要

现有语言模型在任务解决上表现优异,但在长时间推理方面存在局限。文章提出“管理不善的天才”假设,认为通过优化任务分解和自我管理,可以更有效提升模型能力。未来应关注如何改善模型自我管理,以应对更复杂的问题。

🎯

关键要点

- 现有语言模型在任务解决上表现优异,但在长时间推理方面存在局限。

- 提出“管理不善的天才”假设,认为通过优化任务分解和自我管理,可以更有效提升模型能力。

- 当前的语言模型被认为是“天才”,但在处理长时间和迭代推理问题时表现不佳。

- 现有的语言模型调用方式未能充分利用其潜力,需关注模型自我管理能力的提升。

- 建议通过训练语言模型自我分解任务,来提高其解决复杂问题的能力。

- 现有的任务分解系统是限制模型能力的瓶颈,需定义模型可访问的分解空间。

- “协调者-子代理”系统能够有效管理任务分解,适用于人类工作流程。

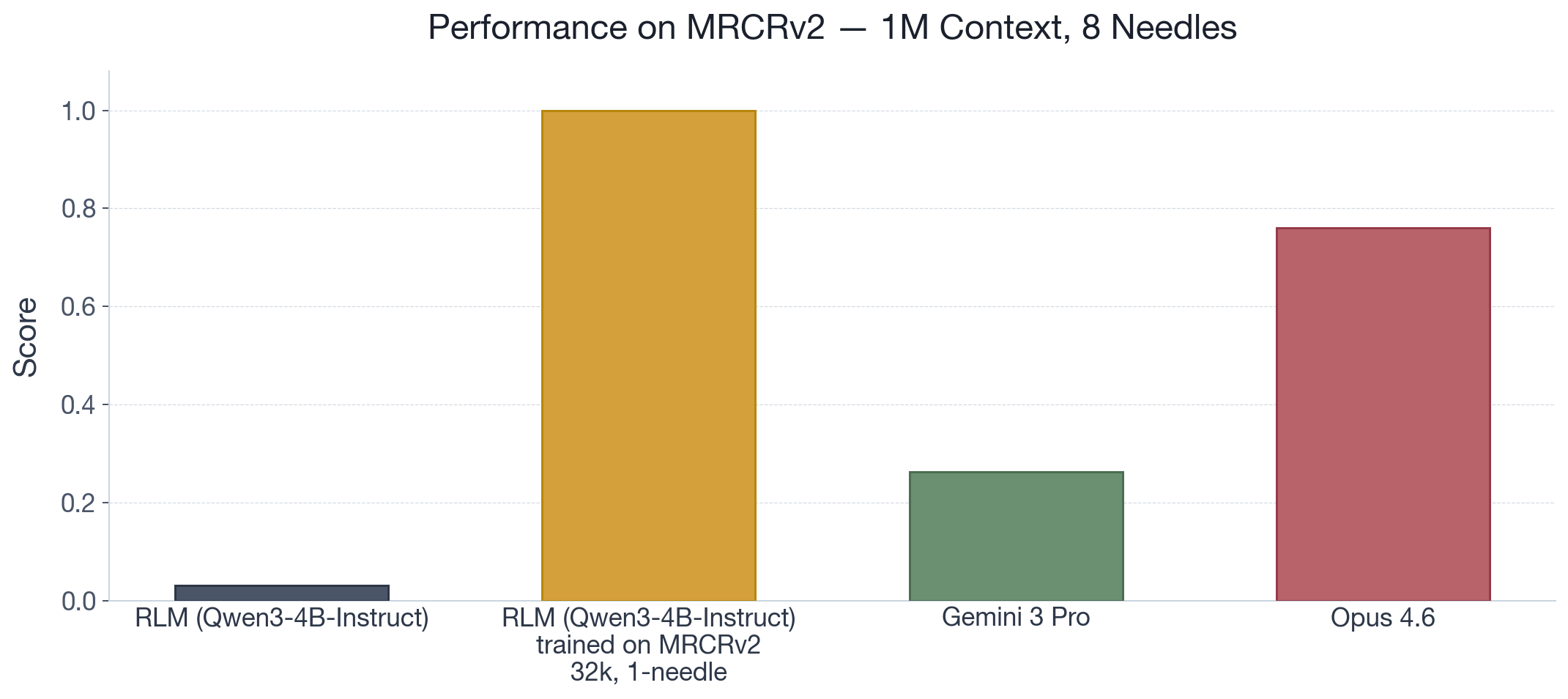

- 递归语言模型(RLMs)提供了一种更具表现力的机制来描述任务计划,支持完全递归的任务分解。

- 通过定义“分解”,确保语言模型调用保持在“分布内”,以提高解决任务的能力。

- 训练语言模型正确分解任务是提升其能力的关键,且正确的分解方式可能已在模型的生成分布内。

- 管理这些“天才”模型的能力是未来研究的方向,需设计良好的框架以支持任务分解。

❓

延伸问答

什么是“管理不善的天才”假设?

“管理不善的天才”假设认为现有语言模型未能充分利用其潜力,主要是因为任务分解和自我管理的方式不够优化。

现有语言模型在长时间推理方面存在哪些局限?

现有语言模型在处理长时间和迭代推理问题时表现不佳,尽管在其他任务上表现优异。

如何优化语言模型的任务分解能力?

通过定义模型可访问的分解空间,并训练模型自我分解任务,可以提高其解决复杂问题的能力。

递归语言模型(RLMs)有什么优势?

递归语言模型提供了一种更具表现力的机制来描述任务计划,支持完全递归的任务分解,能够处理更复杂的任务。

“协调者-子代理”系统是如何工作的?

“协调者-子代理”系统通过一个协调者模型输出解决任务的计划,然后利用子代理执行这些计划,有效管理任务分解。

未来研究的方向是什么?

未来应关注如何改善语言模型的自我管理能力,以应对更复杂的问题,并设计良好的框架支持任务分解。

➡️