💡

原文英文,约1500词,阅读约需6分钟。

📝

内容提要

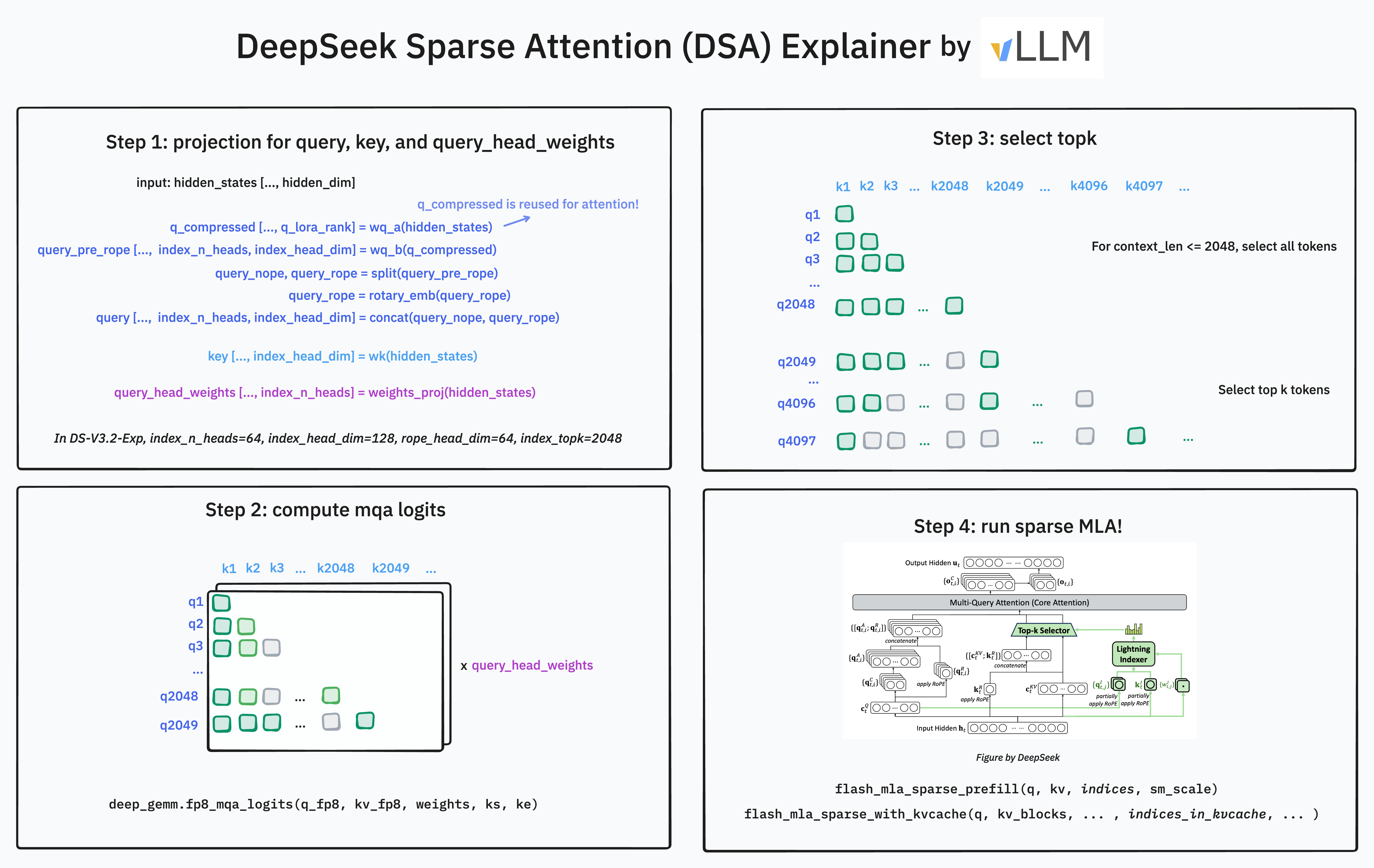

DeepSeek-V3.2-Exp模型现已支持,采用稀疏注意力机制,适用于长文本任务。vLLM集成了新的CUDA内核,优化了性能,用户可通过特定指令进行部署和测试,未来将扩展对更多硬件的支持。

🎯

关键要点

- DeepSeek-V3.2-Exp模型现已支持,采用稀疏注意力机制,适用于长文本任务。

- vLLM集成了新的CUDA内核,优化了性能,用户可通过特定指令进行部署和测试。

- DSA的闪电索引器和稀疏注意力在连续批处理和分页注意力方面存在挑战。

- 在性能方面,vLLM与DeepGEMM中的闪电索引器CUDA内核集成。

- 用户可以在16×H100、8×H200或8×B200上运行DeepSeek 3.2模型。

- 即将推出一键Kubernetes部署,使用NIXL进行PD分解。

- 新缓存条目和量化方案使得索引器K缓存与MLA K缓存分开。

- 新计算方法通过掩码处理每个新查询令牌,计算前2048个令牌的相关性。

- 优化过程中,Top-K可以通过融合内核实现更好的性能。

- 计划扩展对Hopper和Blackwell以外架构的支持,未来将支持AMD和TPU。

- 感谢vLLM社区的团队对该模型的支持和贡献。

❓

延伸问答

DeepSeek-V3.2-Exp模型的主要特点是什么?

DeepSeek-V3.2-Exp模型采用稀疏注意力机制,专为长文本任务设计。

如何在vLLM中部署DeepSeek-V3.2-Exp模型?

用户可以通过特定指令在16×H100、8×H200或8×B200上运行DeepSeek 3.2模型。

vLLM的性能优化是如何实现的?

vLLM集成了新的CUDA内核,优化了性能,并与DeepGEMM中的闪电索引器集成。

DeepSeek-V3.2-Exp模型支持哪些硬件?

该模型计划扩展对Hopper、Blackwell、AMD和TPU等硬件的支持。

DeepSeek-V3.2-Exp模型在处理长文本时面临哪些挑战?

模型在连续批处理和分页注意力方面面临挑战,需要分别处理预填充和解码。

未来对DeepSeek-V3.2-Exp模型的计划是什么?

未来将扩展对更多架构的支持,并计划推出一键Kubernetes部署。

➡️