💡

原文英文,约700词,阅读约需3分钟。

📝

内容提要

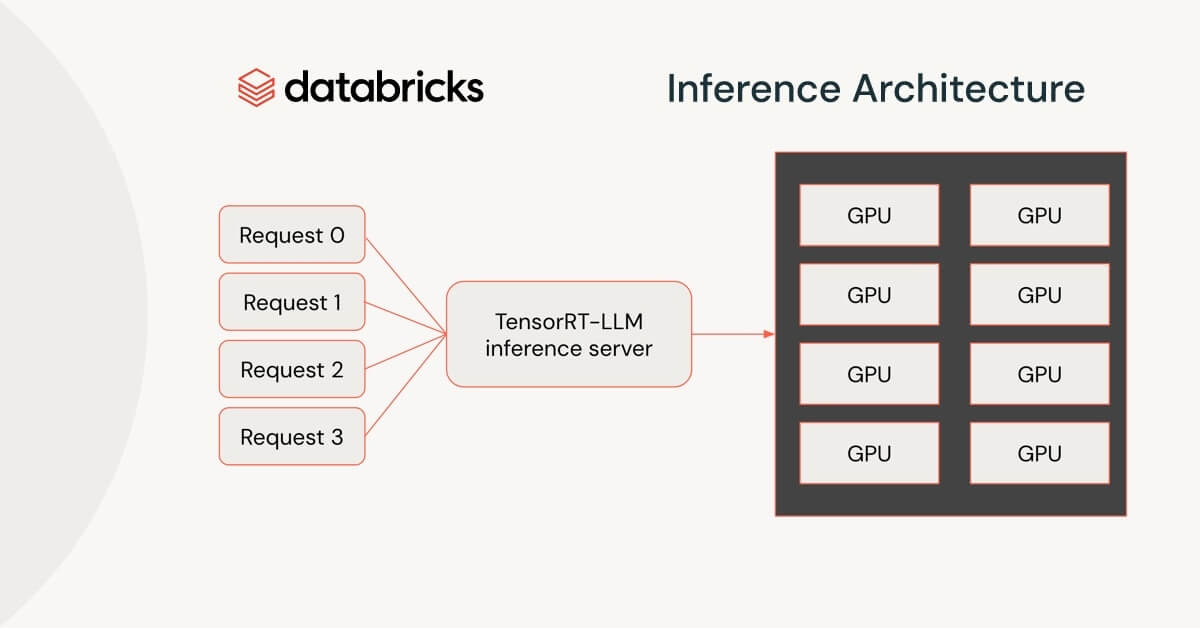

Databricks Mosaic R&D团队在7个月前推出了推理服务架构的第一个版本。2024年1月,他们将开始使用基于NVIDIA TensorRT-LLM构建的新推理引擎来提供大型语言模型(LLM)的服务。TensorRT-LLM是用于最先进的LLM推理的开源库,与NVIDIA的TensorRT深度学习编译器集成,优化内核用于关键操作,通信原语用于高效多GPU服务。他们与NVIDIA的合作使得从Hugging Face或使用MPT架构的自己的预训练或微调模型进行服务更快更容易。

🎯

关键要点

- Databricks Mosaic R&D团队在7个月前推出了推理服务架构的第一个版本。

- 2024年1月,Databricks将开始使用基于NVIDIA TensorRT-LLM的新推理引擎提供大型语言模型(LLM)服务。

- TensorRT-LLM是用于最先进的LLM推理的开源库,集成了NVIDIA的TensorRT深度学习编译器。

- TensorRT-LLM优化了语言模型中的关键操作和通信原语,以实现高效的多GPU服务。

- 与NVIDIA的合作使得从Hugging Face或使用MPT架构的模型进行服务更快更容易。

- 使用TensorRT-LLM,Databricks在首次令牌时间和每个输出令牌时间上取得了显著改善。

- Databricks团队为TensorRT-LLM项目贡献了MPT模型转换脚本,提升了服务效率。

- TensorRT-LLM的灵活性使得扩展新模型架构变得顺利,支持不同的优化插件。

- TensorRT-LLM的离线推理性能与原生的连续批处理支持结合使用时更强大。

- Databricks客户可以通过AI Playground使用推理服务器,当前处于公开预览阶段。

- Databricks将利用TensorRT-LLM在即将发布的推理产品中,并期待分享平台的性能改进。

➡️