💡

原文中文,约1500字,阅读约需4分钟。

📝

内容提要

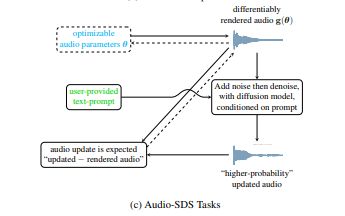

音频扩散模型已实现高质量音频合成,但参数优化不足。研究者提出Audio-SDS方法,结合预训练模型,优化音频表示,支持FM合成和源分离等任务,提升合成效果与文本提示的一致性,展示了数据蒸馏在音频领域的潜力。

🎯

关键要点

- 音频扩散模型已实现高质量音频合成,但参数优化不足。

- 研究者提出Audio-SDS方法,结合预训练模型,优化音频表示。

- Audio-SDS支持FM合成和源分离等任务,提升合成效果与文本提示的一致性。

- SDS通过预训练扩散先验进行反向传播,优化参数化音频表示。

- Audio-SDS框架结合数据驱动的先验与明确的参数控制,产生高质量音频。

- 关键改进包括基于稳定解码器的SDS、多步去噪和多尺度频谱图方法。

- Audio-SDS在FM合成、冲击声合成和源分离任务中表现出色。

- 实验使用主观和客观指标测试框架有效性,结果显示合成效果显著提升。

- Audio-SDS展示了基于数据蒸馏的方法在音频相关任务中的潜力。

❓

延伸问答

Audio-SDS方法的主要创新点是什么?

Audio-SDS结合了预训练模型和数据驱动的先验,优化音频表示,支持多种音频任务。

Audio-SDS如何提升音频合成的效果?

通过多步去噪和多尺度频谱图方法,Audio-SDS提高了高频细节和真实感。

Audio-SDS支持哪些音频任务?

Audio-SDS支持FM合成、冲击声合成和源分离等任务。

Audio-SDS的实验验证了什么?

实验显示Audio-SDS在音频合成和分离方面的效果显著提升,并与文本提示一致。

Audio-SDS如何处理参数优化问题?

Audio-SDS通过反向传播优化参数化音频表示,避免了构建大型特定任务数据集的需求。

Audio-SDS在音频领域的潜力是什么?

Audio-SDS展示了基于数据蒸馏的方法在音频合成和源分离等任务中的潜力。

➡️